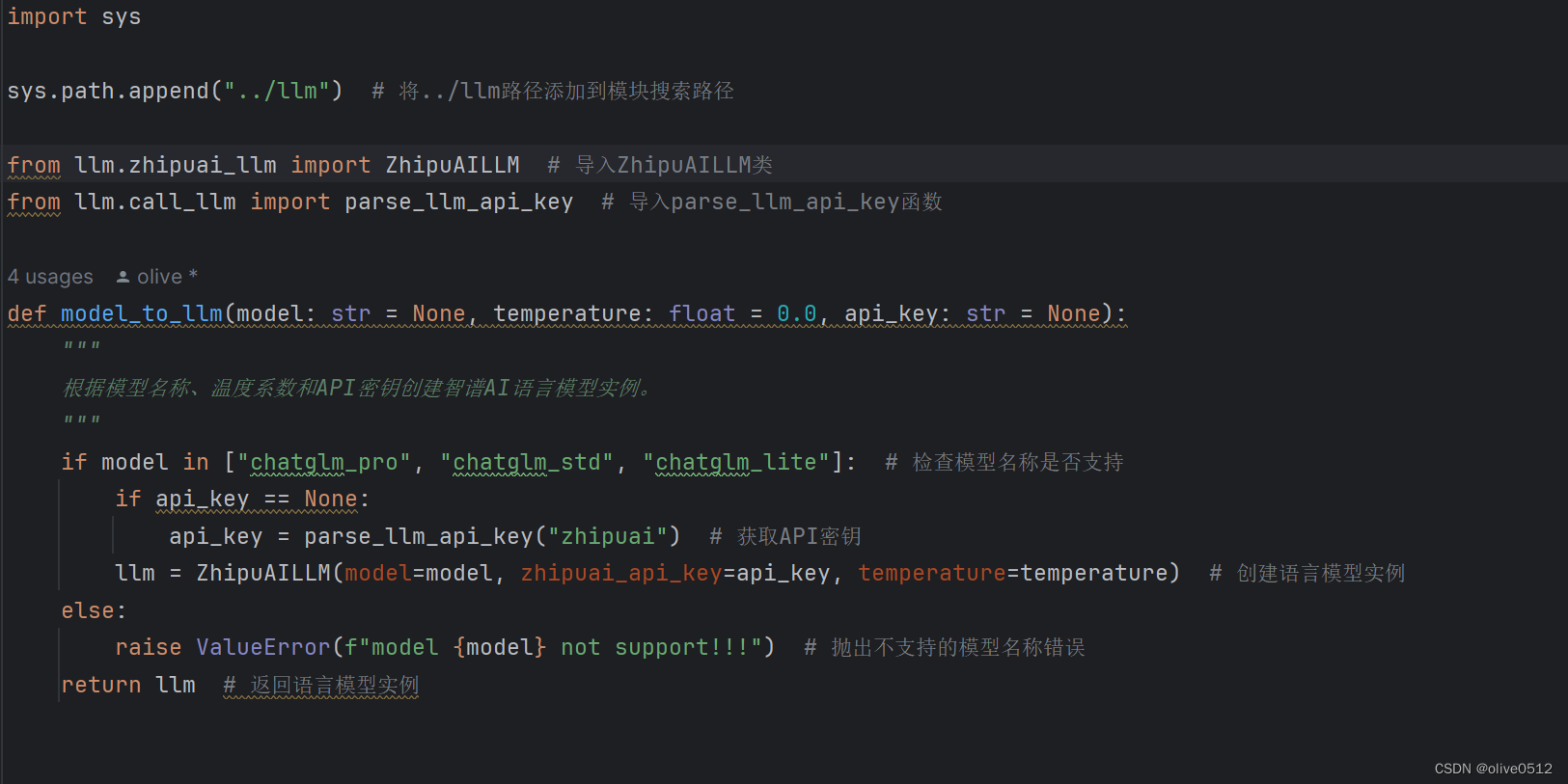

此处进行封装方便后端方法调用

model_to_llm

这段代码主要用于创建和配置智谱 AI 的语言模型实例,确保在调用时传入正确的模型名称和相关参数。如果模型名称不在支持的列表中,代码会及时抛出错误,提醒用户。

- 参数:

api_key: API 密钥,默认值为None。temperature: 温度系数,控制生成的随机性,默认值为 0.0。model: 模型名称,默认值为None。

- 逻辑:

- 如果

model不在支持的列表中,抛出一个ValueError错误,提示不支持该模型。 - 如果

model在支持的列表中:- 如果

api_key为None,则调用parse_llm_api_key(call_llm实现)获取 API 密钥。 - 创建一个

ZhipuAILLM实例,传入model、zhipuai_api_key和temperature参数。

- 如果

- 判断传入的

model是否在支持的模型列表["chatglm_pro", "chatglm_std", "chatglm_lite"]中。

- 如果

-

返回:

- 返回创建的

ZhipuAILLM实例。

- 返回创建的

216

216

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?