解压Spark安装包

tar -zxf /opt/spark-3.2.1-bin-hadoop2.7.tgz -C /usr/local/

进入Spark安装目录的/bin目录,使用SparkPi计算Pi的值

cd /usr/local/spark-3.2.1-bin-hadoop2.7/bin/

./run-example SparkPi 2

如果执行时输出非常多的运行日志信息,输出结果找不到,就使用grep命令进行过滤(命令中的 2>&1 可以将所有的信息都输出到 stdout 中,否则由于输出日志的性质,还是会输出到屏幕中)

./bin/run-example SparkPi 2>&1 | grep "Pi is"

搭建单机伪分布式集群

将Spark安装包解压至Linux的/usr/local目录下

进入解压后的Spark安装目录的/conf目录下,复制spark-env.sh.template文件并重命名为spark-env.sh

cd /usr/local/spark-3.2.1-bin-hadoop2.7/conf/

cp spark-env.sh.template spark-env.sh

准备好java环境

设置 JAVA 环境变量

进入vi /etc/profile文件

source一下使生效,检查是否可用

打开spark-env.sh文件,在文件末尾添加代码:

export JAVA_HOME=/usr/local/src/jdk1.8.0_152

export HADOOP_HOME=/opt/software/hadoop

export HADOOP_CONF_DIR=/opt/software/hadoop/etc/hadoop

export SPARK_MASTER_IP=master

export SPARK_LOCAL_IP=master

启动Spark集群

cd /usr/local/spark-3.2.1-bin-hadoop2.7/sbin/

./start-all.sh

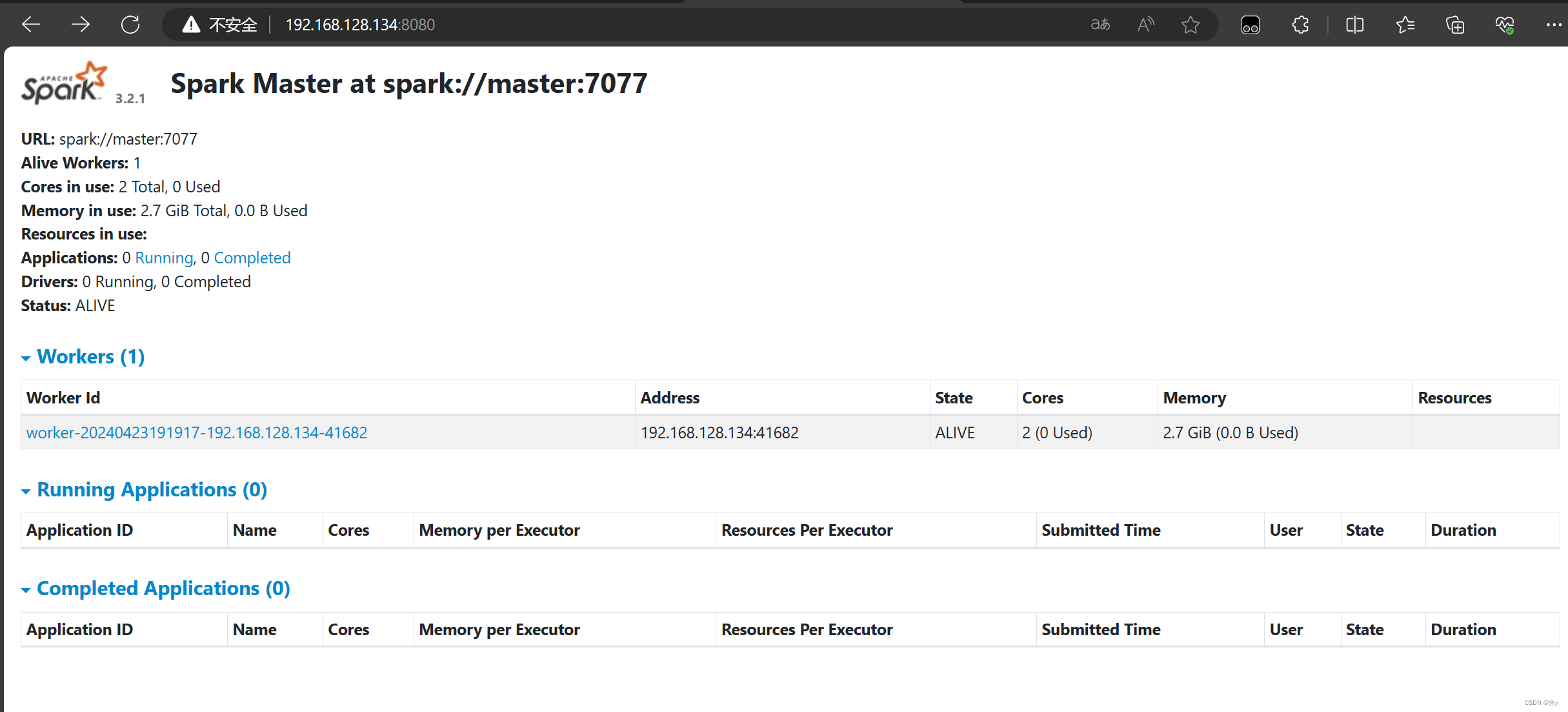

通过命令“jps”查看进程,如果既有Master进程又有Worker进程,那么说明Spark集群启动成功

输入IP进入网页浏览

192.168.128.134:50070

192.168.128.134:8080

切换至Spark安装包的/bin目录下,使用"SparkPi"计算Pi的值,运行结果如下:

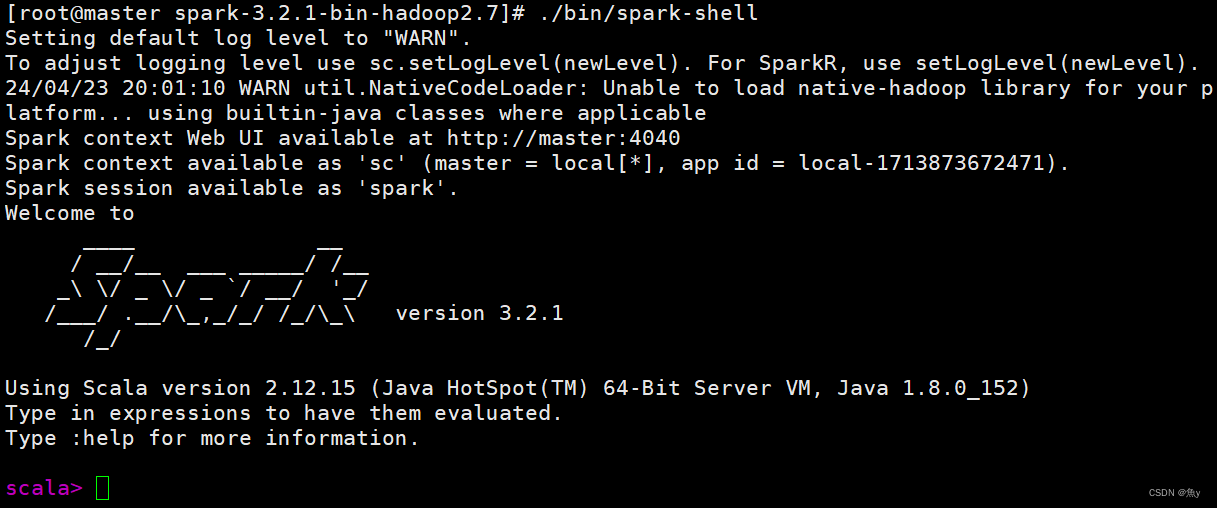

启动spark-shell

cd /usr/local/spark-3.2.1-bin-hadoop2.7/

./bin/spark-shell

Scala组件的配置

首先从Scala官网下载Scala安装包,安装包名称为"scala-2.11.8.tgz",将其上传至/opt目录。解压安装包至/usr/local目录下,代码如下:

tar -zxf scala-2.11.8.tgz -C /usr/local/

为了方便使用Scala编程,使用命令"vim /etc/profile"打开配置文件/etc/profile,配置Scala变量,在文件末尾添加如下代码。保存并退出后,使用命令"source /etc/profile" 重新加载/etc/profile配置文件。

vim /etc/profile

export SCALA_HOME=/usr/local/scala-2.11.8

export PATH=$PATH:SCALA_HOME/bin

source /etc/profile

Scala的验证

scala

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?