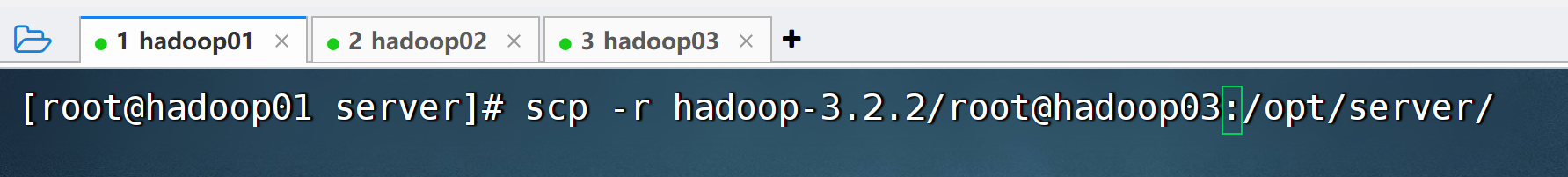

(一)、拷贝Hadoop所有文件。

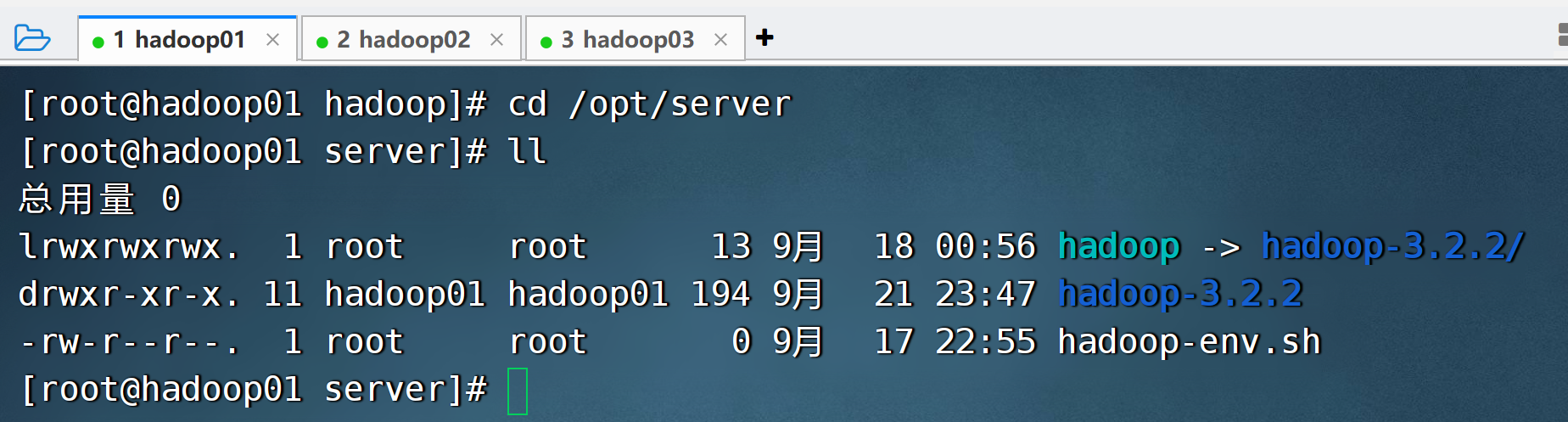

1、切换server文件目录中。

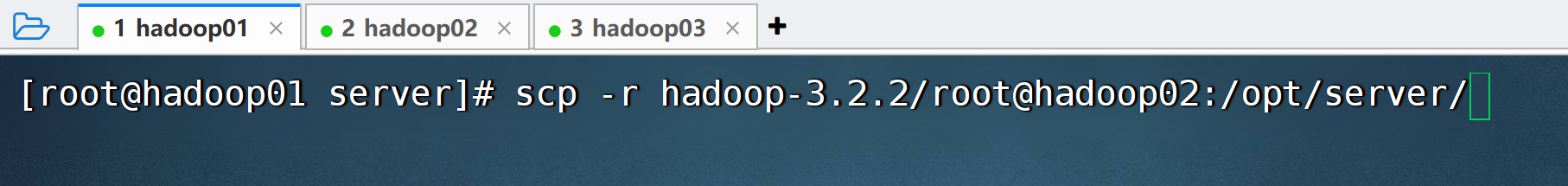

2、拷贝Hadoop01所有配置文件到hadoop02。

scp -r hadoop-3.2.2/ root@hadoop02:/opt/server/hadoop-3.2.2/

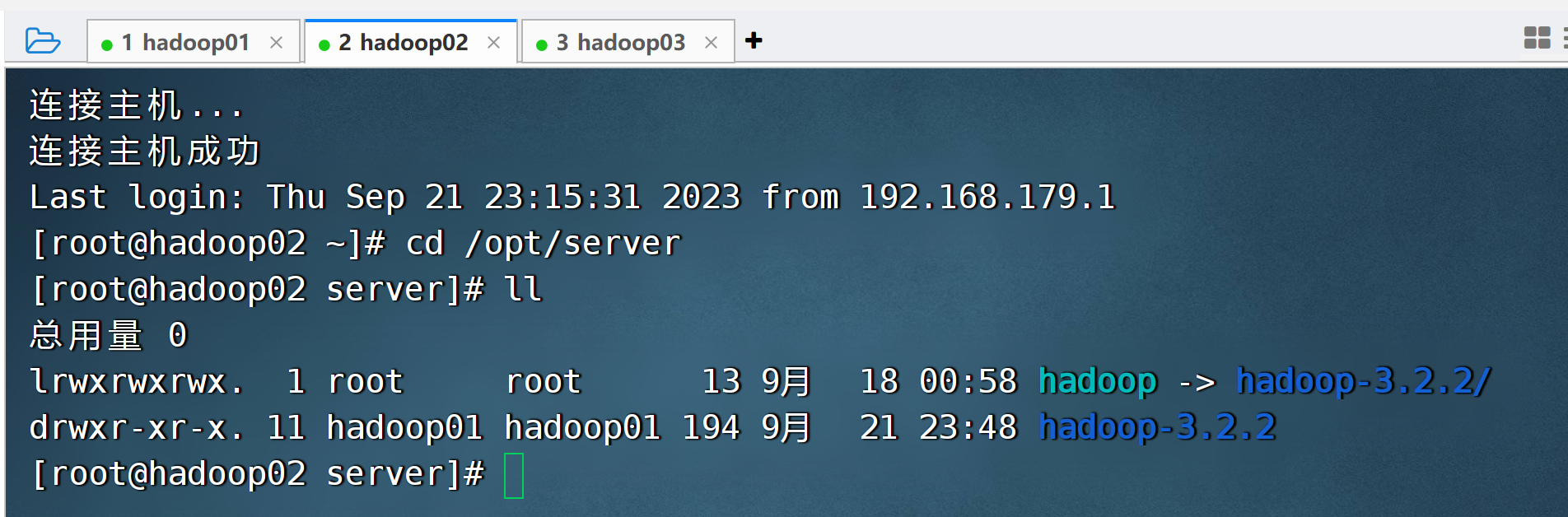

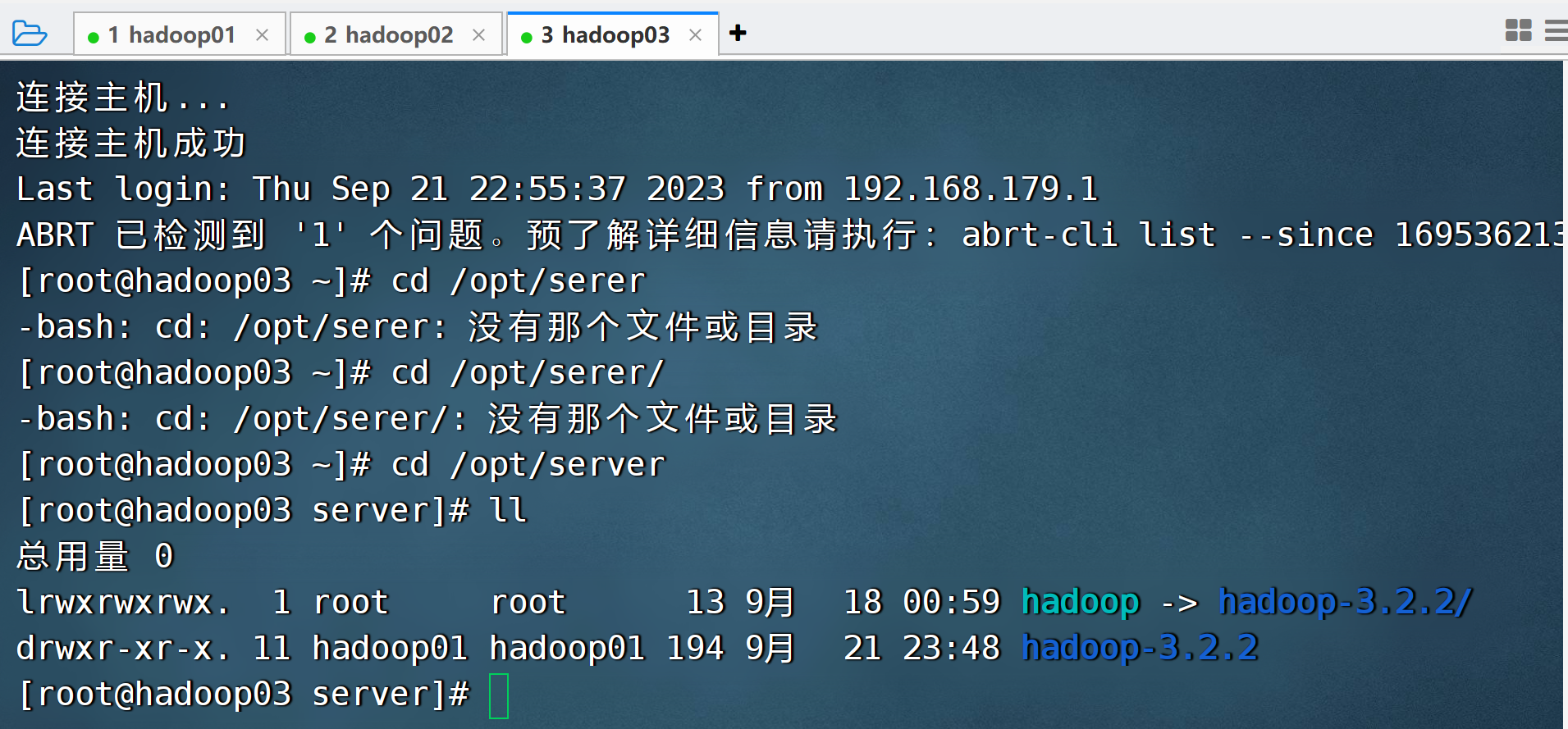

3、hadoop03拷贝完成

3、hadoop03拷贝完成

执行结果

执行结果

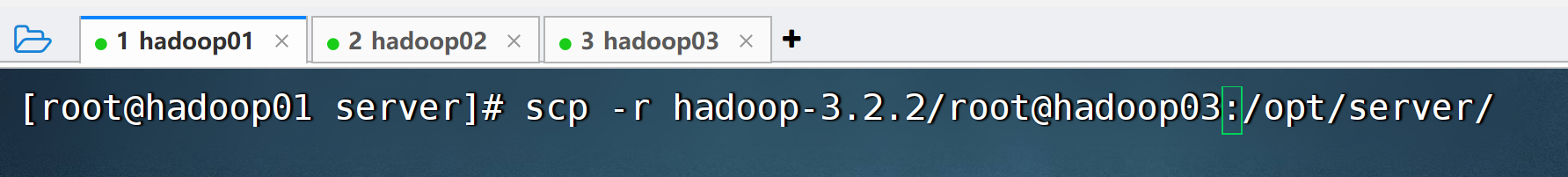

4、拷贝hadoop所有配置文件到hadoop03

4、拷贝hadoop所有配置文件到hadoop03

5、hadoop03拷贝完成

5、hadoop03拷贝完成

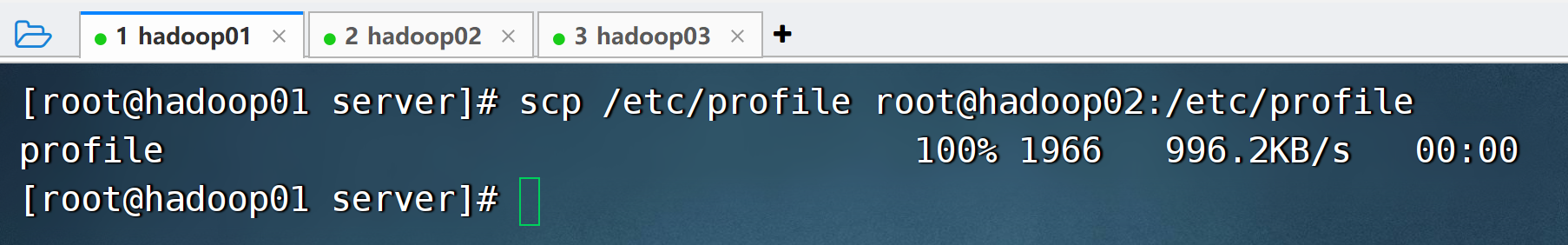

6、拷贝环境变量配置文件到hadoop02。

6、拷贝环境变量配置文件到hadoop02。

执行代码

scp /etc/profile root@hadoop02:/etc/profile

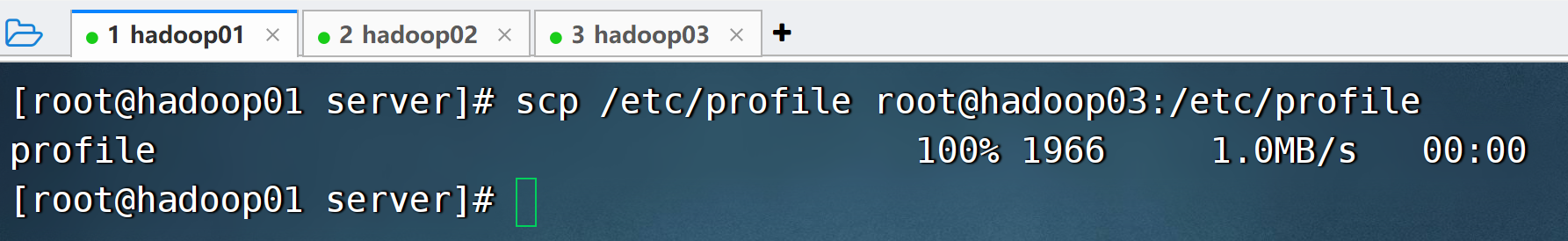

7、拷贝环境变量文件到hadoop03。

7、拷贝环境变量文件到hadoop03。

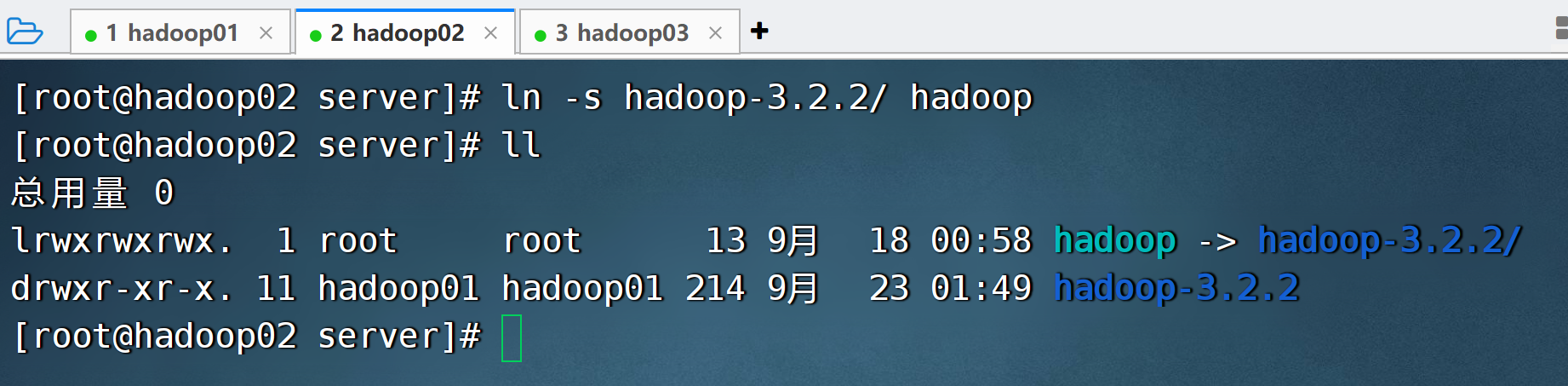

8、在hadoop02上创建软连接。

8、在hadoop02上创建软连接。

执行代码

ln -s hadoop-3.2.2/ hadoop

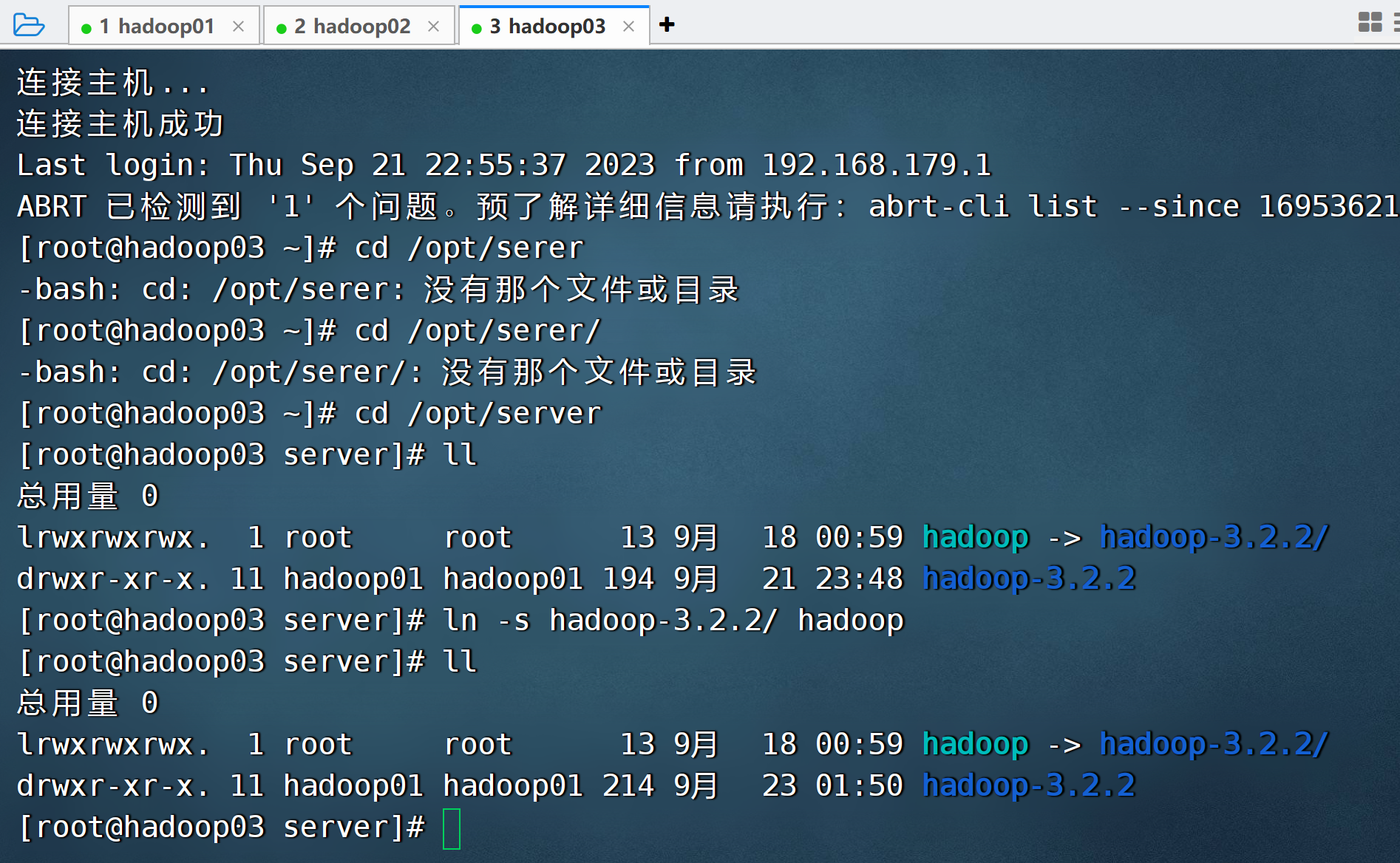

9、在hadoop03上创建软连接。

9、在hadoop03上创建软连接。

(二)修改脚本文件

(二)修改脚本文件

1、切换到Hadoop是sbin的目录下,

执行代码

cd /opt/server/hadoop/sbin

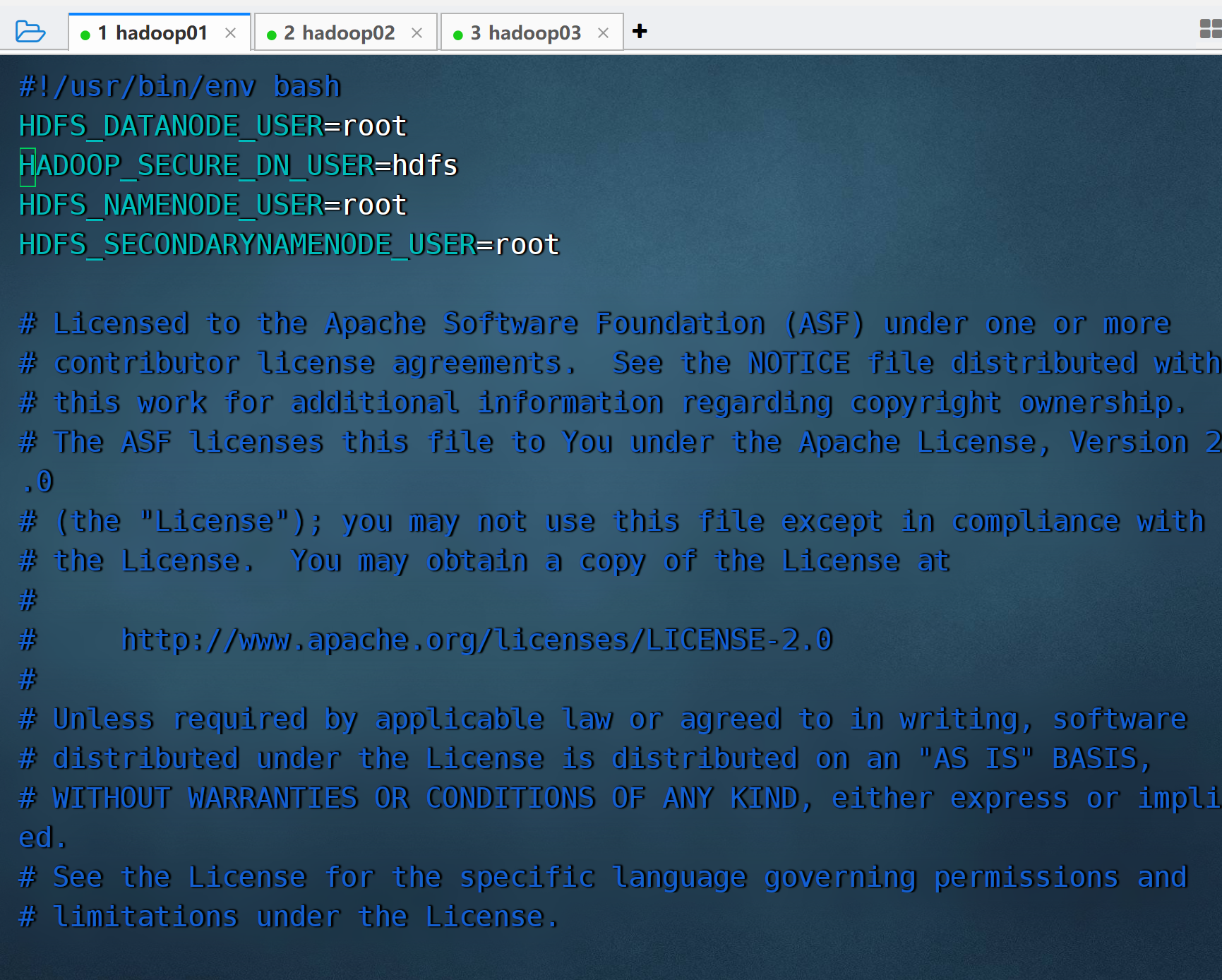

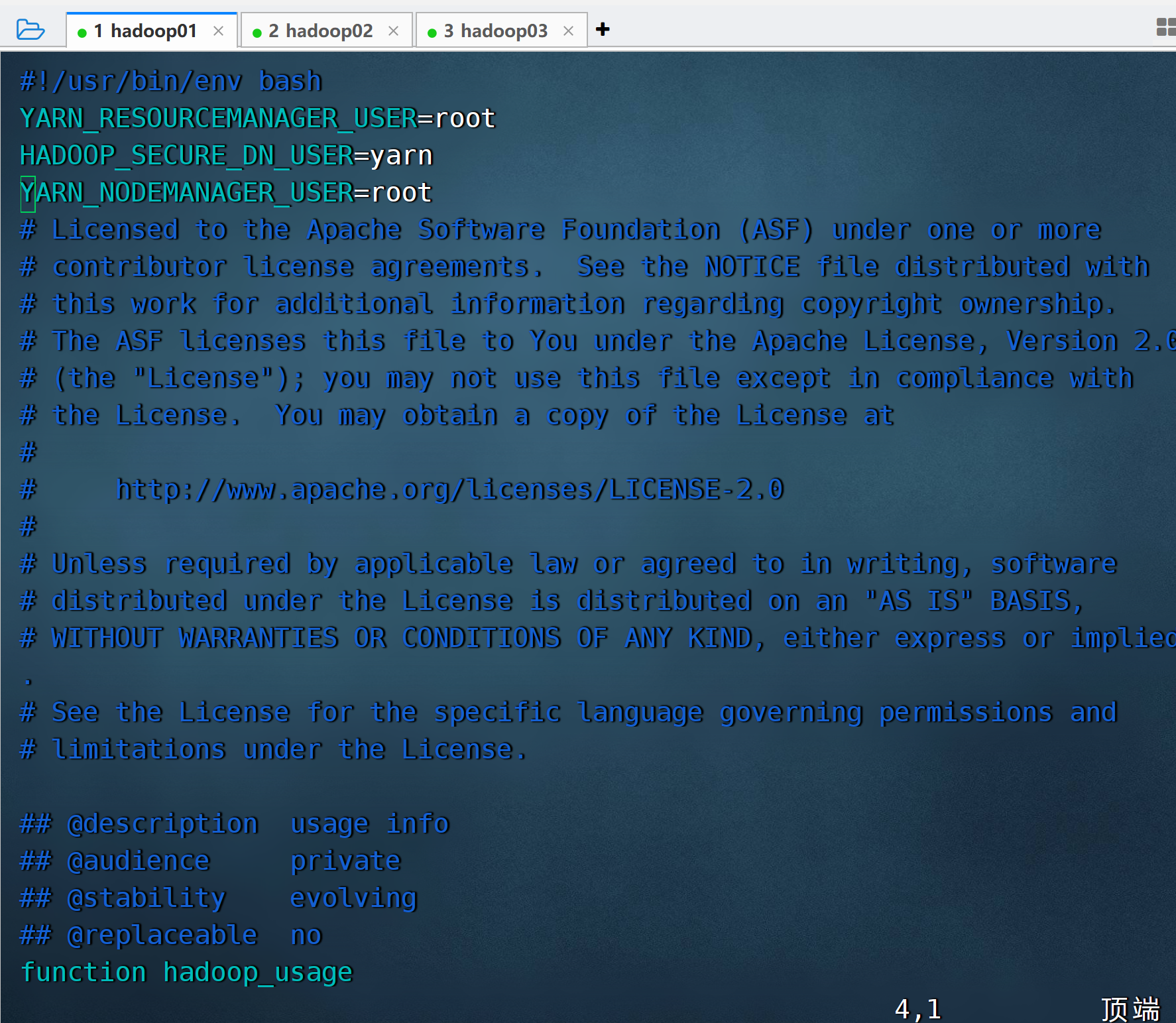

2、修改start-dfs.sh脚本文件。

执行代码

vim /start-dfs.sh

参数修改

核心代码

- HDFS_DATANODE_USER=root

- HADOOP_SECURE-DU_USER=hdfs

- HDFS_NAMENODE_USER=root

- HDFS_SECONDARYNAMENODE_USER=root

4、修改stop-dfs.sh脚本文件

4、修改stop-dfs.sh脚本文件

核心代码

vim stop-dfs.sh

参数修改。

参数修改。

核心代码

- HDFS_DATANODE_USER=root

- HADOOP_SECURE-DU_USER=hdfs

- HDFS_NAMENODE_USER=root

- HDFS_SECONDARYNAMENODE_USER=root

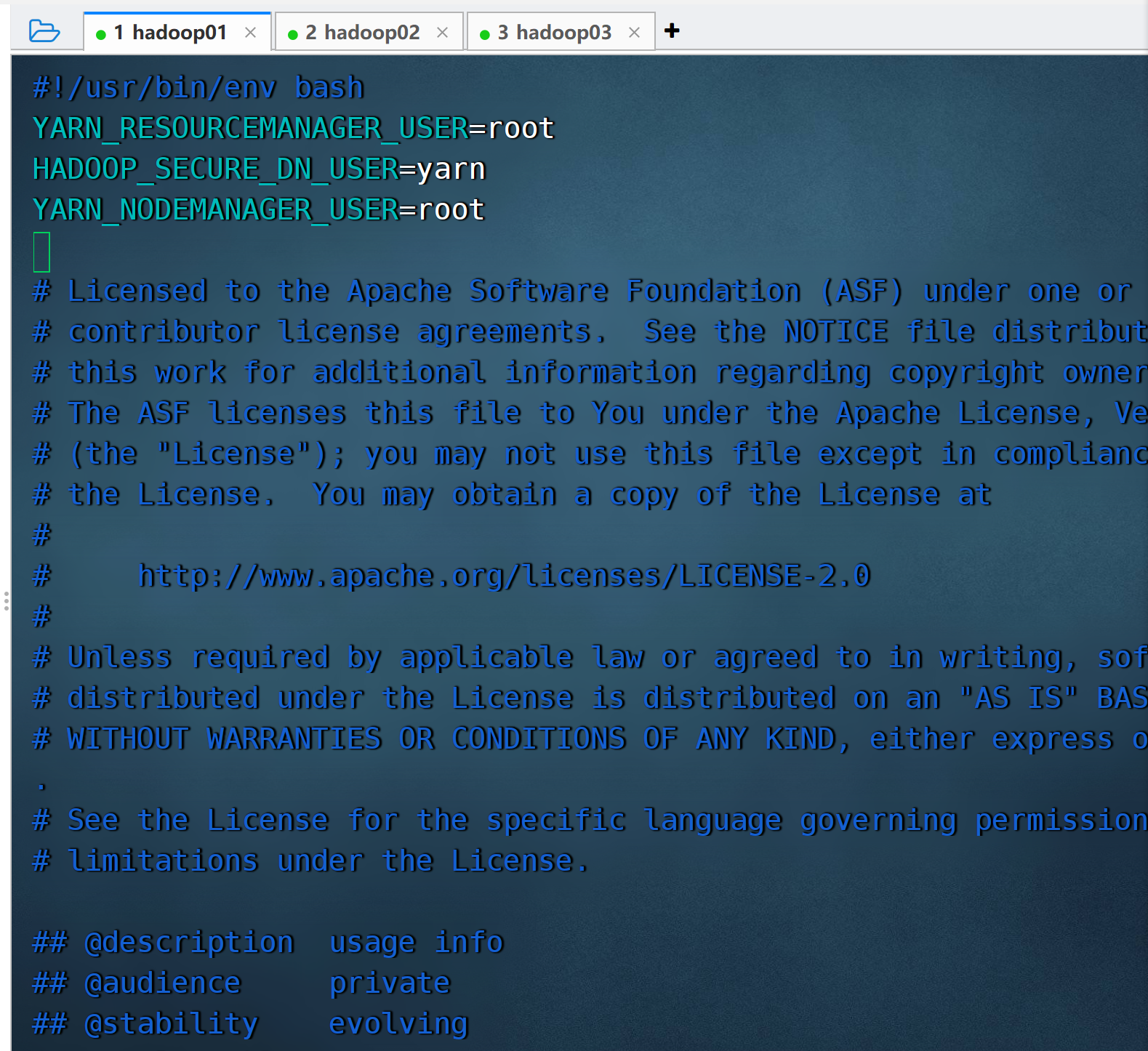

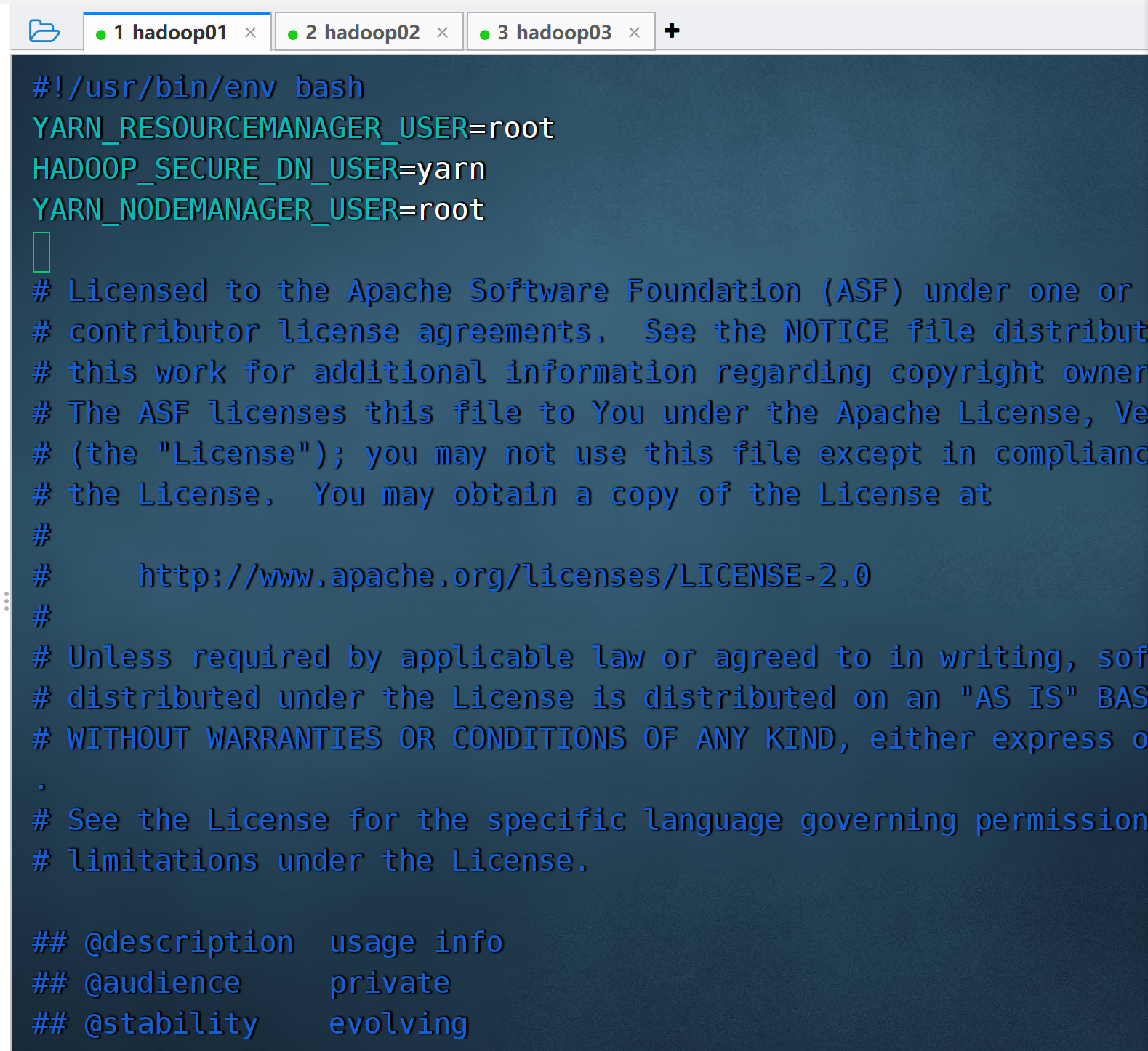

6、修改start-dfs.sh 脚本文件

6、修改start-dfs.sh 脚本文件

核心代码

vim start-dfs.sh

参数修改

参数修改

核心代码

- HDFS_DATANODE_USER=root

- HADOOP_SECURE-DU_USER=hdfs

- HDFS_NAMENODE_USER=root

- HDFS_SECONDARYNAMENODE_USER=root

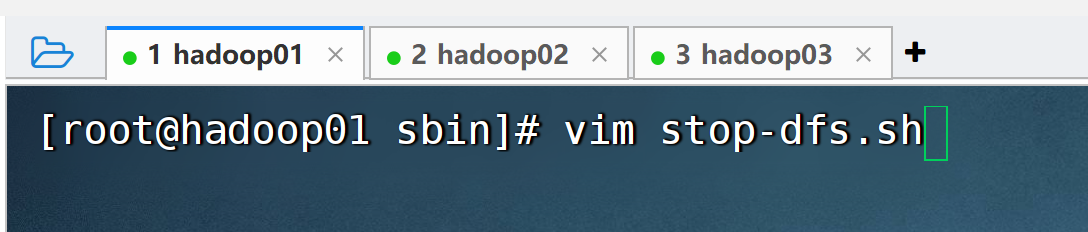

8、修改stop-dfs.sh 脚本文件

8、修改stop-dfs.sh 脚本文件

核心代码

vim stop-dfs.sh

修改参数

修改参数

核心代码

- HDFS_DATANODE_USER=root

- HADOOP_SECURE-DU_USER=hdfs

- HDFS_NAMENODE_USER=root

- HDFS_SECONDARYNAMENODE_USER=root

376

376

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?