Hadoop平台都是基于Linux系统下的,今天我们来讲解Hadoop的安装教程

一.先安装JDK,详情安装清查看我的另一篇文章:点击打开链接

二.安装Hadoop

(1)先上传hadoop的安装包到服务器上去/usr/local/src

(2)解压到指定目录

[hadoop@hadoop02 src]$ tar -zxvf hadoop-2.4.1.tar.gz -C ~/app(3)重命名,解决繁杂的版本标识

[hadoop@hadoop02 app]$ mv hadoop-2.4.1 hadoop

(4)配置系统变量

[hadoop@hadoop02 app]$ sudo vi /etc/profile#Jdk #Hadoop

export JAVA_HOME=/home/hadoop/app/jdk

export HADOOP_HOME=/home/hadoop/app/hadoop

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

(5)伪分布式需要修改5个配置文件

首先进入hadoop/etc/hadoop目录下面

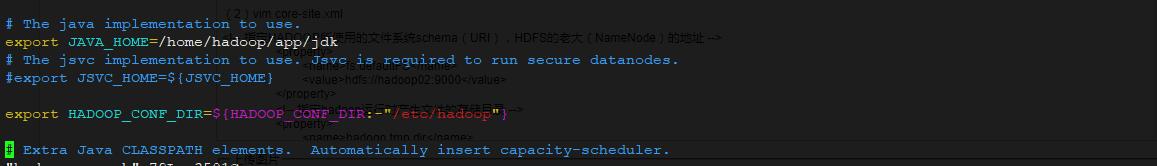

第一个:hadoop-env.sh

vim hadoop-env.sh

#第27行

export JAVA_HOME=/home/hadoop/app/jdk

(1)首先创建tmp文件夹

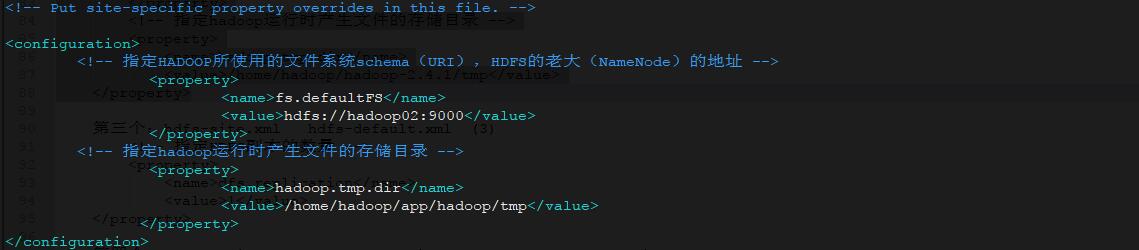

[hadoop@hadoop02 hadoop]$ mkdir ~/app/hadoop/tmp(2)vim core-site.xml

<!-- 指定HADOOP所使用的文件系统schema(URI),HDFS的老大(NameNode)的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop02:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/app/hadoop/tmp</value>

</property>

(3)第三个:hdfs-site.xml

<!-- 指定HDFS副本的数量 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>首先重命名一下这个文件

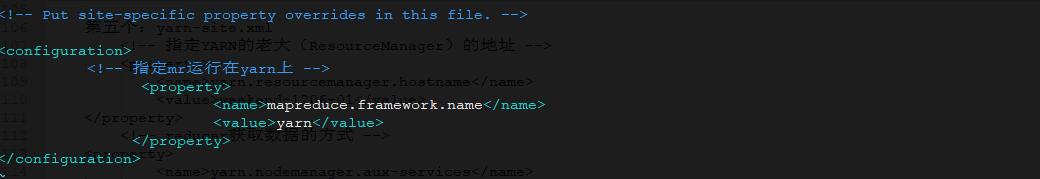

[hadoop@hadoop02 hadoop]$ mv mapred-site.xml.template mapred-site.xml<!-- 指定mr运行在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

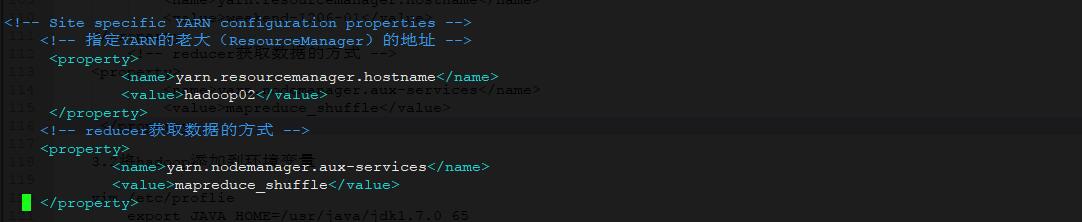

(5)第五个:yarn-site.xml

<!-- 指定YARN的老大(ResourceManager)的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop02</value>

</property>

<!-- reducer获取数据的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

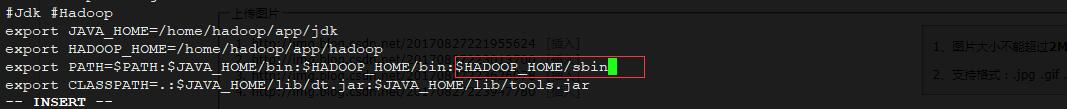

(6)在次配置haddop环境变量

添加

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

重置改资源状态source /etc/profile

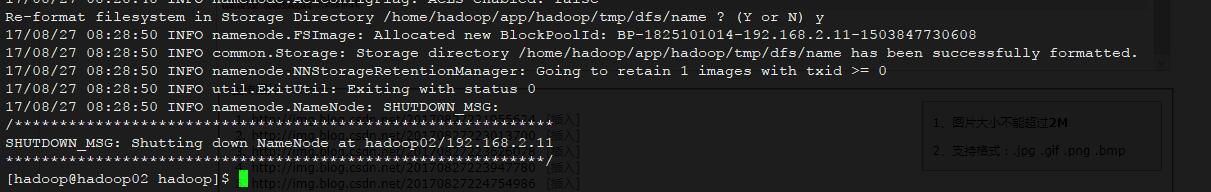

(7)格式化namenode(是对namenode进行初始化)

hadoop namenode -formathdfs namenode -format

(8) 1.启动hadoop

2.先启动HDFS

sbin/start-dfs.sh

3.再启动YARN

sbin/start-yarn.sh

4.验证是否启动成功

使用jps命令验证

27408 NameNode

28218 Jps

27643 SecondaryNameNode

28066 NodeManager

27803 ResourceManager

27512 DataNode

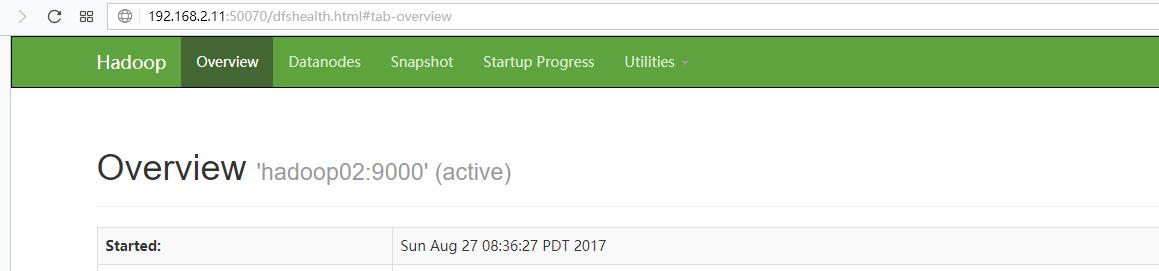

http://192.168.2.11:50070 (HDFS管理界面)

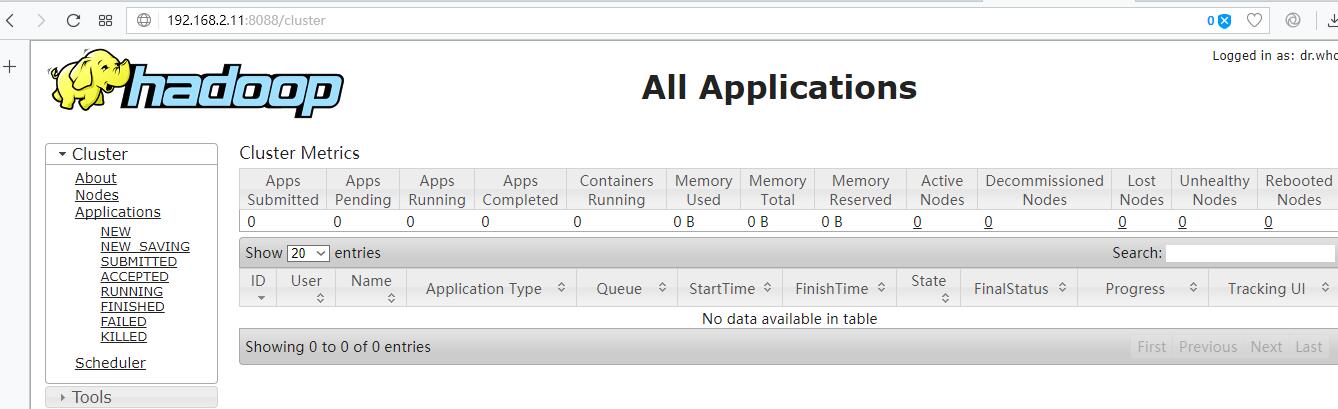

http://192.168.2.11:8088 (MR管理界面)

待续...

1759

1759

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?