HashMap实现Map接口,是Collection的一种链表散列数据结构,以key-value形式存在。key-value被当做一个整体来处理,JVM会根据key的hash值确定value的存放位置,我们也可以根据key快速的存取value。HashMap底层实质上也是数组实现。

一、定义

HashMap实现了Map接口,继承AbstractMap。其中Map接口定义了键到值映射的规则,而AbstractMap提供了Map接口的骨干实现,以最大限度地减少实现此接口所需的工作。

public class HashMap<K,V>

extends AbstractMap<K,V>

implements Map<K,V>, Cloneable, Serializable二、构造函数

HashMap提供了3种构造函数:

public HashMap() {

this(DEFAULT_INITIAL_CAPACITY, DEFAULT_LOAD_FACTOR);

}

public HashMap(int initialCapacity) {

this(initialCapacity, DEFAULT_LOAD_FACTOR);

}

public HashMap(int initialCapacity, float loadFactor) {

//此处省略部分代码

this.loadFactor = loadFactor;

threshold = initialCapacity;

init();

}其中:

1. HashMap()构造一个默认初始容量16,加载因子为0.75的空HashMap。

2. HashMap(int initialCapacity):构造一个带指定初始容量和默认加载因子 (0.75) 的空 HashMap。

3. HashMap(int initialCapacity, float loadFactor):构造一个带指定初始容量和加载因子的空 HashMap。

这里提到的两个参数非常重要:初始容量和加载因子。这两个参数也是影响HashMap性能的重要参数,其中容量表示哈希表中桶的数量,初始容量是创建哈希表时的容量,加载因子是哈希表在其容量自动扩容之前可以到达多慢的尺度,它衡量一个散列表使用空间的程度,负载因子越大表示散列表的装载程度越高,反之越小。因此如果加载因子越大,空间利用率越高,但由于装载越多元素碰撞的概率就变高,就会出现单个桶装载多个元素,形成链表,那么查询的效率就会降低。如果加载因子过小,散列表的数据就会过于分散,造成空间上的浪费。系统默认加载因子是0.75,这是前辈们科学实验的经验值,一般情况下我们无需修改它。

三、数据结构

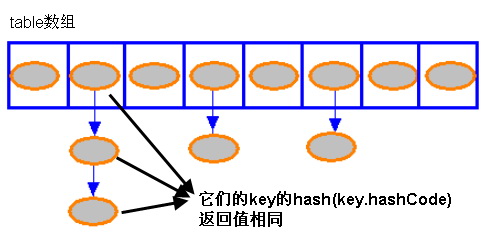

HashMap数据结构如下:

从上图我们可以看出,HashMap底层实现还是数组,只是数组的每一项是链表。其中参数initialCapacity就代表了该数组的长度。下面为HashMap构造函数的源码:

public HashMap(int initialCapacity, float loadFactor) {

//初始容量不能为0

if (initialCapacity < 0)

throw new IllegalArgumentException("Illegal initial capacity: " +

initialCapacity);

//初始容量不能大于最大容量值,HashMap的最大容量值为2^30

if (initialCapacity > MAXIMUM_CAPACITY)

initialCapacity = MAXIMUM_CAPACITY;

//加载因子不能小于0

if (loadFactor <= 0 || Float.isNaN(loadFactor))

throw new IllegalArgumentException("Illegal load factor: " +

loadFactor);

this.loadFactor = loadFactor;

threshold = initialCapacity;

init();

}从源码中看处,这时还没有做初始化操作,初始化操作在put时判断table为空时执行。(Java1.7的源码)

四、存储实现: put(K key, V value)

先上源码

public V put(K key, V value) {

//检查hash表有无初始化,如果没有就先初始化

if (table == EMPTY_TABLE) {

inflateTable(threshold);

}

//如果key为null,调用putForNullKey方法,保存null在table的第一个位置中,这是HashMap允许为null的原因

if (key == null)

return putForNullKey(value);

//计算key的hash值 -----(1)

int hash = hash(key);

//计算key hash值在table数组中的位置 -----(2)

int i = indexFor(hash, table.length);

//从i处开始迭代e,找到key保存的位置

for (Entry<K,V> e = table[i]; e != null; e = e.next) {

Object k;

//判断该链条上是否有hash值相同的key

//若存在相同,则直接覆盖value,返回旧value

if (e.hash == hash && ((k = e.key) == key || key.equals(k))) {

V oldValue = e.value;

e.value = value;

e.recordAccess(this);

return oldValue;

}

}

//修改次数加1

modCount++;

//将key、value添加至i位置

addEntry(hash, key, value, i);

return null;

}通过源码我们可以看到HashMap保存数据的过程为:首先判断key是否为null,若为null,则直接调用putForNullKey方法,保存null到table[0]。若不为空则先计算key的hash值,然后根据hash值搜索在table数组中的索引位置,如果table数组在该位置处有元素,则通过比较是否存在相同的key,若存在则覆盖原来key的value,否则将该元素保存在链头(最先保存的元素放在链尾)。若table在该处没有元素,则直接保存;

让我们来看添加key、value的源码addEntry(hash, key, value, i)

void addEntry(int hash, K key, V value, int bucketIndex) {

//首先判断有无超过阈值,有则先扩容

if ((size >= threshold) && (null != table[bucketIndex])) {

resize(2 * table.length);

hash = (null != key) ? hash(key) : 0;

bucketIndex = indexFor(hash, table.length);

}

createEntry(hash, key, value, bucketIndex);

}这个方法中有两点需要注意:

一是链的产生。这是一个非常优雅的设计。系统总是将新的Entry对象添加到bucketIndex处。如果bucketIndex处已经有了对象,那么新添加的Entry对象将指向原有的Entry对象,形成一条Entry链,但是若bucketIndex处没有Entry对象,也就是e==null,那么新添加的Entry对象指向null,也就不会产生Entry链了。

二、扩容问题。

随着HashMap中元素的数量越来越多,发生碰撞的概率就越来越大,所产生的链表长度就会越来越长,这样势必会影响HashMap的速度,为了保证HashMap的效率,系统必须要在某个临界点进行扩容处理。该临界点在当HashMap中元素的数量等于table数组长度*加载因子。但是扩容是一个非常耗时的过程,因为它需要重新计算这些数据在新table数组中的位置并进行复制处理。所以如果我们已经预知HashMap中元素的个数,那么预设元素的个数能够有效的提高HashMap的性能

再来看创建Entry的源码:

void createEntry(int hash, K key, V value, int bucketIndex) {

//将之前的链表赋给e

Entry<K,V> e = table[bucketIndex];

//再把新创建的Entry赋给table[i],e赋给next

table[bucketIndex] = new Entry<>(hash, key, value, e);

//长度加1

size++;

}现在回过头来看put方法中标注的(1)、(2)处:这是HashMap的精华所在。首先是hash方法,该方法时一个纯粹的数学计算,就是计算h的hash值:

final int hash(Object k) {

int h = hashSeed;

if (0 != h && k instanceof String) {

return sun.misc.Hashing.stringHash32((String) k);

}

h ^= k.hashCode();

// This function ensures that hashCodes that differ only by

// constant multiples at each bit position have a bounded

// number of collisions (approximately 8 at default load factor).

h ^= (h >>> 20) ^ (h >>> 12);

return h ^ (h >>> 7) ^ (h >>> 4);

}我们知道对于HashMap的table而言,数据分布需要均匀(最好每项都只有一个元素,这样就可以直接找到),不能太紧也不能太松,太紧会导致查询速度慢,太松则浪费空间。计算hash值后,怎么才能保证table元素分布均与呢?我们会想到取模,但是由于取模的消耗较大,HashMap是这样处理的:调用indexFor方法。

static int indexFor(int h, int length) {

// assert Integer.bitCount(length) == 1 : "length must be a non-zero power of 2";

return h & (length-1);

}HashMap的底层数组长度总是2的n次方,在构造函数中存在:inflateTable方法中可以找到; 这样做总是能够保证HashMap的底层数组长度为2的n次方。当length为2的n次方时,h&(length - 1)就相当于对length取模,而且速度比直接取模快得多,这是HashMap在速度上的一个优化。至于为什么是2的n次方下面解释。

private void inflateTable(int toSize) {

// Find a power of 2 >= toSize

int capacity = roundUpToPowerOf2(toSize);

threshold = (int) Math.min(capacity * loadFactor, MAXIMUM_CAPACITY + 1);

table = new Entry[capacity];

initHashSeedAsNeeded(capacity);

}我们回到indexFor方法,该方法仅有一条语句:h&(length - 1),这句话除了上面的取模运算外还有一个非常重要的责任:均匀分布table数据和充分利用空间。

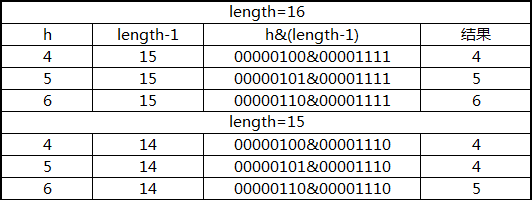

这里我们假设length为16(2^n)和15,h为5、6、7。

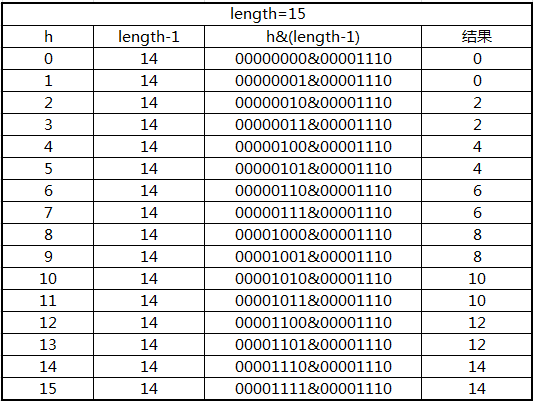

当n=15时,6和7的结果一样,这样表示他们在table存储的位置是相同的,也就是产生了碰撞,6、7就会在一个位置形成链表,这样就会导致查询速度降低。诚然这里只分析三个数字不是很多,那么我们就看0-15。

从上面的图表中我们看到总共发生了8此碰撞,同时发现浪费的空间非常大,有1、3、5、7、9、11、13、15处没有记录,也就是没有存放数据。这是因为他们在与14进行&运算时,得到的结果最后一位永远都是0,即0001、0011、0101、0111、1001、1011、1101、1111位置处是不可能存储数据的,空间减少,进一步增加碰撞几率,这样就会导致查询速度慢。而当length = 16时,length – 1 = 15 即1111,那么进行低位&运算时,值总是与原来hash值相同,而进行高位运算时,其值等于其低位值。所以说当length = 2^n时,不同的hash值发生碰撞的概率比较小,这样就会使得数据在table数组中分布较均匀,查询速度也较快。

261

261

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?