目录

3,过拟合overfitting、欠拟合underfitting

一,回归 Regression

Regression 就是求解一个函数 function ,通过输入特征 x,输出一个数值 Scalar。

这个求解的过程,本质上是解超定方程,非退化情况下超定方程是无解的,所以需要定义一个损失函数,描述一个近似解的近似程度。

所以回归就是针对损失函数进行的最优化问题。

如:股市预测、自动驾驶、商品推荐。

模型步骤:

- step1:模型假设,选择模型框架(线性模型)

- step2:模型评估,如何判断众多模型的好坏(损失函数)

- step3:模型优化,如何筛选最优的模型(梯度下降)

二,一次线性模型

1,一元线性模型

![]()

其中x是单个特征

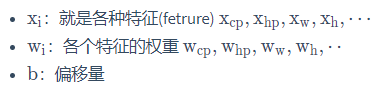

2,多元线性模型

![]()

三,损失函数

使用损失函数(Loss function) 来衡量模型的好坏,根据每组数据的预测值和实际值,得到整个模型的损失值。

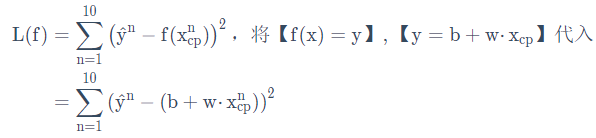

1,单个特征的损失函数

最终定义损失函数 Loss function:

![]()

这是关于w和b的二元函数

2,多个特征的损失函数

m个特征的损失函数是关于w1、w2...wm和b的m+1元函数

四,模型筛选、梯度下降

1,模型筛选

模型筛选要做的就是根据损失函数,找到损失最小的值,对应的参数值就是最优模型。

实际上没法保证找到损失函数的最小值,只能尽量找到较小的值,其中最常用的就是梯度下降法。

2,梯度下降、学习率

梯度下降、学习率

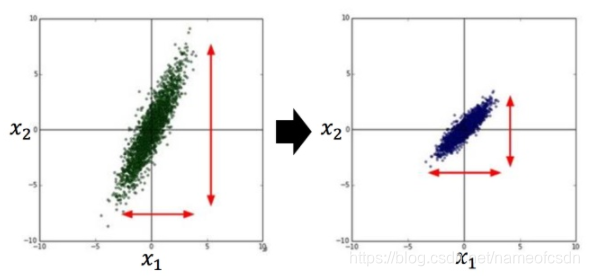

3,特征缩放

特征缩放之后,更便于梯度下降。

五,n次线性模型

1,一元2次线性模型

![]()

那么损失函数就是关于w1、w2、b的三元函数。

2,多元n次线性模型

同理,根据实际情况,我们还可以构造一元n次模型,甚至多元n次模型。

注意,多元n次模型仍然是线性模型,因为模型的预测函数是关于参数的线性函数。

相关、线性回归、最小二乘_nameofcsdn的博客-CSDN博客

3,过拟合overfitting、欠拟合underfitting

如果4次模型是最优模型,那么5次模型就会过拟合,3次模型就会欠拟合

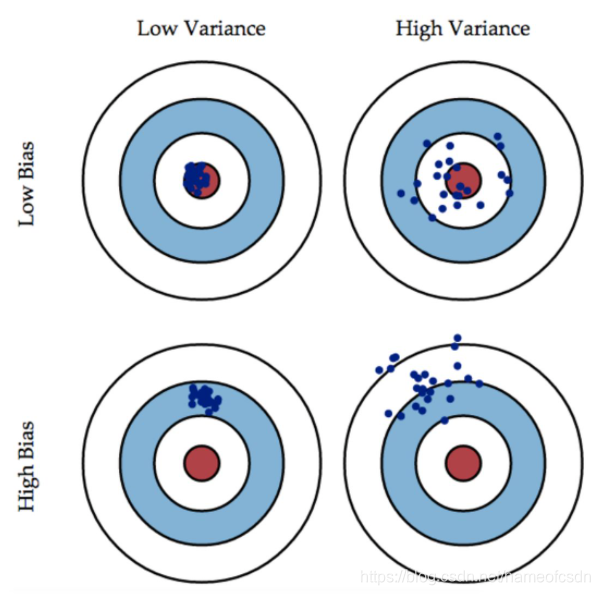

六,误差

误差Error = 偏差Bias + 方差Variance

过拟合:偏差小,方差大。

欠拟合:偏差大,方差小。

七,交叉验证

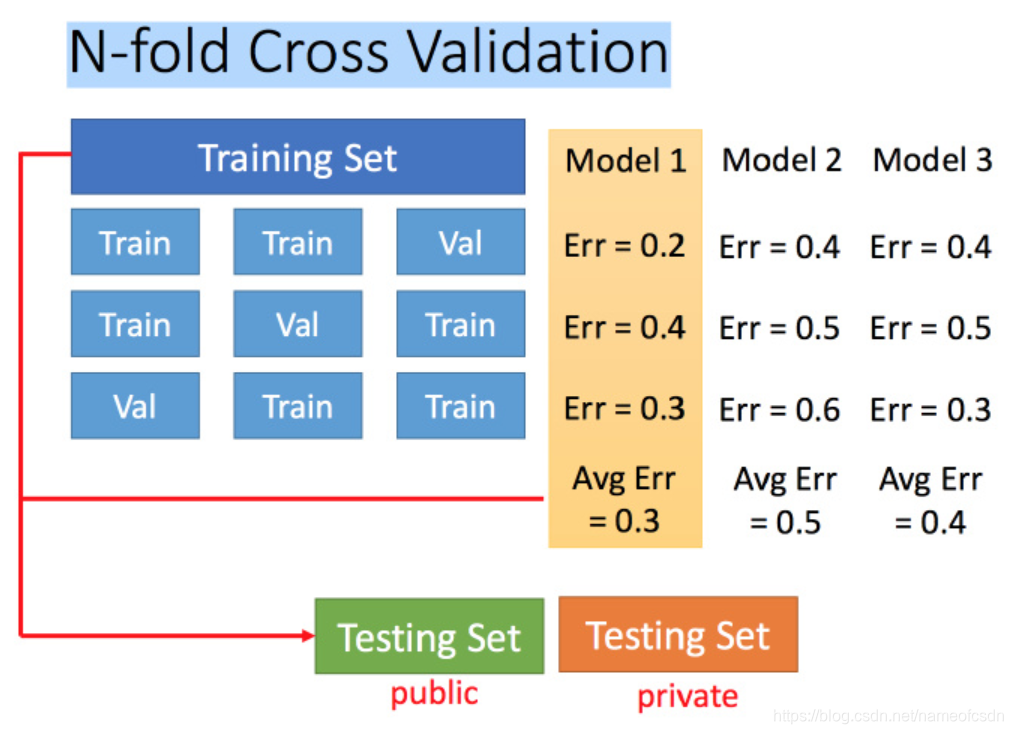

交叉验证就是将训练集再分为两部分,一部分作为训练集,一部分作为验证集。用训练集训练模型,然后再验证集上比较,确定出最好的模型之后,再用全部的训练集训练这个模型,然后再用public的测试集进行测试。

N-拆交叉验证就是将训练集分成N份,如拆成3份:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?