最近同事项目想使用celery与rabbitmq来做任务调度,让我做一次这方面的使用分享。工作之余大致整理了一下。

一、先介绍一下rabbitmq消息队列

1、queue、channel

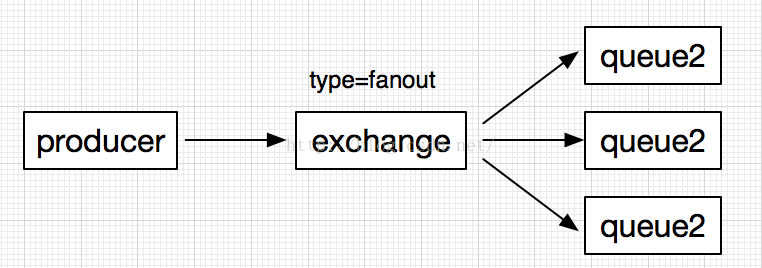

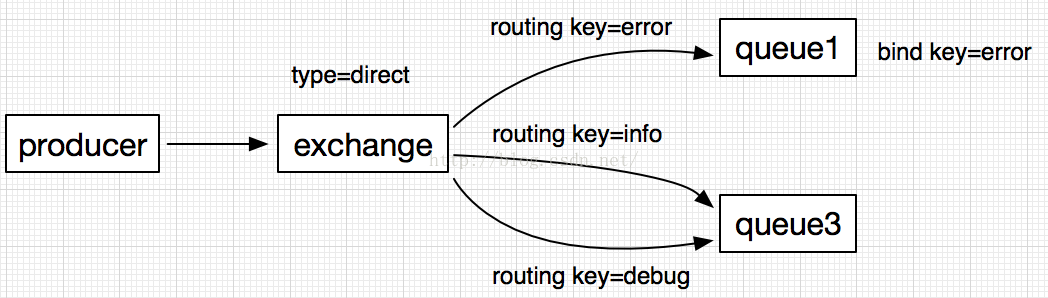

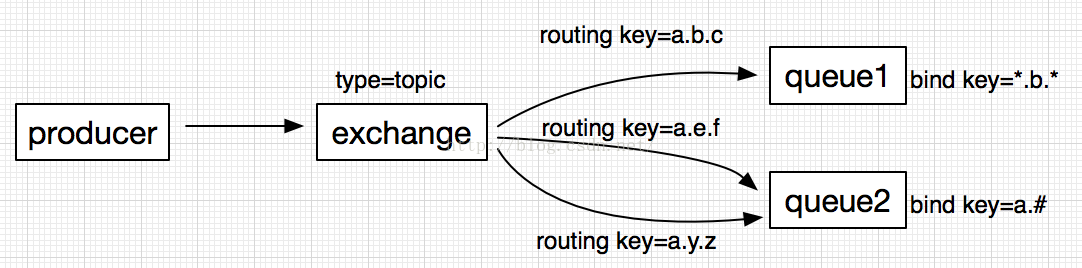

2、exchange

(1)routing key为一个句点号“.”分隔的字符串(我们将被句点号 “. ”分隔开的每一段独立的字符串称为一个单词),如“stock.usd.nyse”、“nyse.vmw”、“quick.orange.rabbit”

(2)binding key与routingkey一样也是句点号“.”分隔的字符串

(3)binding key中可以存在两种特殊字符“*”与“#”,用于做模糊匹配, 其中“*”用于匹配一个单词,“#”用于匹配多个单词(可以是零个)

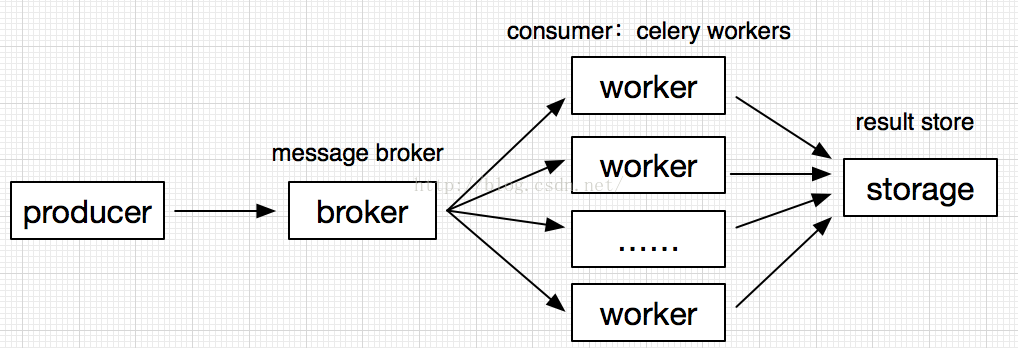

二、下面介绍一下celery及使用:

Celery是基于Python开发的分布式任务队列。它支持使用任务队列的方式在分布的机器/进程/线程上执行任务调度。

1、 celery工作流程:

消息中间件(message broker):Celery本身不提供消息服务,但是可以方便的和第三方提供的消息中间件集成。包括,RabbitMQ, Redis, MongoDB ,SQLAlchemy等,其中rabbitm与redis比较稳定,其他处于测试阶段。

任务执行单元(worker):Worker是Celery提供的任务执行的单元,worker并发的运行在分布式的系统节点中。

任务结果存储(result store):result store用来存储Worker执行的任务的结果,支持AMQP,redis,mongodb,mysql等主流数据库。

2、并发、序列化、压缩:

celery任务并发执行支持prefork、eventlet、gevent、threads的方式;

序列化支持pickle,json,yaml,msgpack等;

压缩支持zlib, bzip2 。

3、celery使用中的一些建议和优化

这里主要说一下celery使用中的一些优化,关于app、task、worker、queue、router等等大家可以参照官方文档:http://docs.celeryproject.org/en/latest/

(1)、如果你的broker使用的是rabbitmq,可安装一个C语言版的客户端librabbitmq来提升性能, pip install librabbitmq;

(2)、通过 BROKER_POOL_LIMIT 参数配置消息中间件的连接池;

(3)、通过CELERYD_PREFETCH_MULTIPLIER 参数配置消息预取的数量,如果消息队列中有很多消息,这个值建议设为1,以达到各个worker的最大化利用;

(4)、指定worker消费的队列,如果你根据业务配置了多个不同的消息队列,各个队列的任务量大小不同,可以在worker启动时指定消费队列 celery -A app_name -l INFO -Q queue1,queue2

(5)、worke(prefork)默认启动cpu核数个子进程,进程管理可以使用supervisor,supervisor是用Python开发的一套通用的进程管理程序,能将一个普通的命令行进程变为后台daemon,并监控进程状态,异常退出时能自动重启

1451

1451

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?