记一次线上应用dubbo-claim连接池满的处理

首先看到dubbo-claim应用突然大面积报错,基本反馈是冻结预算出问题了,看了看冻结预算的代码,发现写的非常复杂,果断放弃看代码来排查问题。

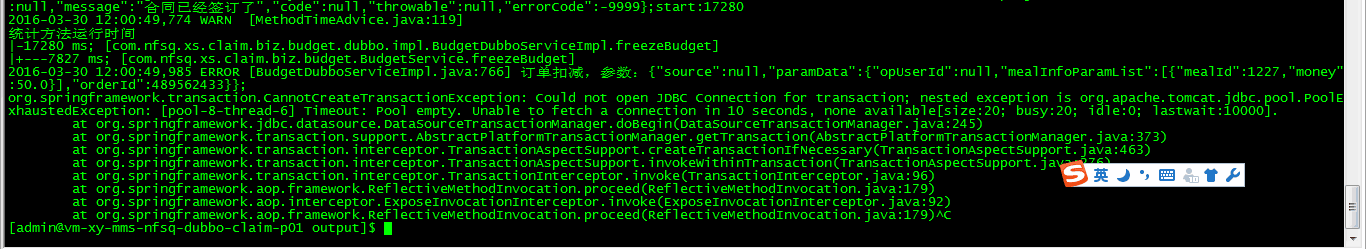

Could not open jdbc connection for transaction: Pool empty. Unable to fetch a connection in 10 seconds, none available[size:20,busy:20; idle:0, lastwait:10000]报错中能获得的信息是数据库的连接池满了。因为是突然报错,所以排查的主要两个方向:

1. 调用量增大导致响应慢

2. 数据库数据量增大导致响应慢

其他可能的小概率事件:

1. 数据库连接未正常关闭

2. 新上的功能比较耗时拖慢数据库

3. 数据库有异常,或者机器网络等硬件问题(概率极小,不到最后不要想)

4. 数据库连接是否配置小了?(20*4台一共80。假设平均处理时间在200ms,能够支撑400qps,足够了)

接下来就需要验证猜测,第一反应想看看jvm里的线程都干嘛呢,到底是谁在拖后腿,用 jstack 来打印出线程的活动状态,我是用jvisualVM来直接 dump 线程。

接下来就是看日志中的线程都干嘛呢,首先看状态为 BLOCK,和 WAITING 状态的线程,看他们是因为什么导致不执行。

"DubboServerHandler-10.3.0.87:20888-thread-152" - Thread t@229

java.lang.Thread.State: BLOCKED

at com.nfsq.xs.claim.biz.budget.BudgetService.freezeBudget(BudgetService.java:85)

- waiting to lock <7153f861> (a com.nfsq.xs.claim.biz.budget.BudgetService) owned by "DubboServerHandler-10.3.0.87:20888-thread-176" t@253

at com.nfsq.xs.claim.biz.budget.BudgetService$$FastClassBySpringCGLIB$$8dee689c.invoke(<generated>)

at org.springframework.cglib.proxy.MethodProxy.invoke(MethodProxy.java:204)接下来发现日志里一个非常重要信息线程152在等线程176的一个锁(7153f861),且其他很多线程也是在等待这把锁

接下来看线程176这家伙拿着这把锁干嘛呢

"

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4509

4509

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?