1.梯度下降

梯度下降是一个用来求函数最小值的算法,我们将使用梯度下降算法来求出代价函数 J(θ0, θ1) 的最小值。

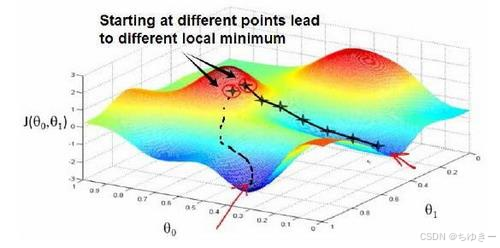

梯度下降背后的思想是:开始时我们随机选择一个参数的组合(θ0, θ1, . . . . . . , θn ),计算代价函数,然后我们寻找下一个能让代价函数值下降最多的参数组合。

我们持续这么做直到到一个局部最小值(local minimum),因为我们并没有尝试完所有的参数组合,所以不能确定我们得到的局部最小值是否便是全局最小值(global minimum),选择不同的初始参数组合,可能会找到不同的局部最小值。

想象一下你正站立在山的这一点上,站立在你想象的公园这座红色山上,在梯度下降算法中,我们要做的就是旋转360度,看看我们的周围,并问自己要在某个方向上,用小碎步尽快下山。

这些小碎步需要朝什么方向?如果我们站在山坡上的这一点,你看一下周围,你会发现最佳的下山方向,走一步到达一个低一点的点,你再看看周围,然后再一次想想,我应该从什么方向迈着小碎步下山?然后你按照自己的判断又迈出一步,重复上面的步骤,从这个新的点,你环顾四周,并决定从什么方向将会最快下山,然后又迈进了一小步,并依此类推,直到你接近局部最低点的位置。

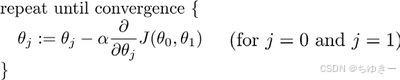

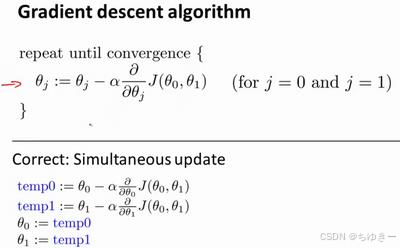

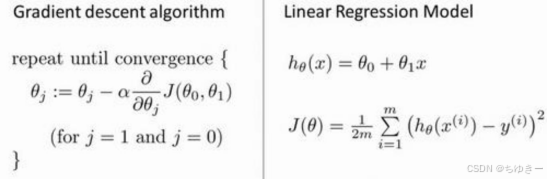

批量梯度下降(batch gradient descent)算法的公式为:

其中a是学习率(learningrate),它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大,在批量梯度下降中,我们每一次都同时让所有的参数减去学习率乘以代价函数的导数。

在梯度下降算法中,还有一个更微妙的问题,梯度下降中,我们要更新θ0和θ1,当j=0和j=1时,会产生更新,所以你将更新J(θ0)和J(θ1)。

实现梯度下降算法的微妙之处是,在这个表达式中,如果你要更新这个等式,你需要同时更新θ0和θ1,意思是在这个等式中,我们要这样更新:

先计算出右边的值,然后同时更新θ0和θ1

在梯度下降算法中,这是正确实现同时更新的方法。不用纠结为什么需要同时更新,同时更新是梯度下降中的一种常用方法。

2.直观理解

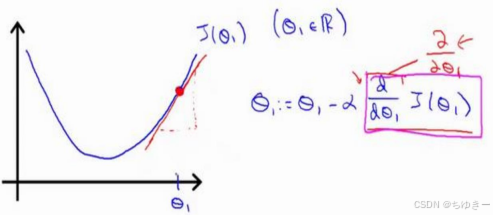

梯度下降算法如下:

描述:对θ赋值,使得J(θ)按梯度下降最快方向进行,一直迭代下去,最终得到局部最小值。

其中a是学习率(learning rate),它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大。

对于这个问题,求导基本上可以说取这个红点的切线,就是这样一条红色的直线,刚好与函数相切于这一点,看看这条红色直线的斜率正好是这个三角形的高度除以这个水平长度,现在,这条线有一个正斜率,也就是说它有正导数,因此,我得到的新的θ1,θ1 更新后等于θ1减去一个正数乘以a。

如果a太小或a太大会出现什么情况呢:

如果a太小了,即我的学习速率太小,结果就是只能这样像小宝宝一样一点点地挪动, 去努力接近最低点,这样就需要很多步才能到达最低点,所以如果a太小的话,可能会很慢, 因为它会一点点挪动,它会需要很多步才能到达全局最低点。

如果a太大,那么梯度下降法可能会越过最低点,甚至可能无法收敛,下一次迭代又移 动了一大步,越过一次,又越过一次,一次次越过最低点,直到你发现实际上离最低点越来越远,所以,如果a太大,它会导致无法收敛,甚至发散。

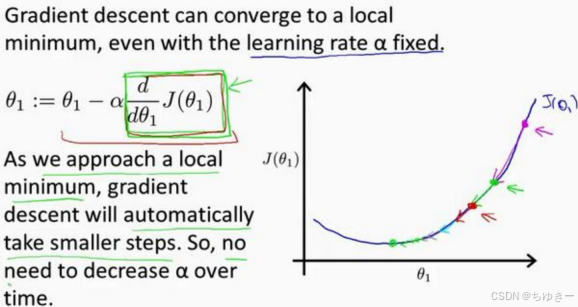

假设将θ1初始化在局部最低点,在这儿,它已经在一个局部的最优处。 结果是局部最优点的导数将等于零。这意味着你已经在局部最优点,它使得θ1 不再改变,也就是新的θ1等于原来的θ1 ,因此,如果你的参数已经处于局部最低点,那么梯度下降法更新其实什么都没做,它不会改变参数的值。这也解释了为什么即使 学习速率a保持不变时,梯度下降也可以收敛到局部最低点。

看一个例子:

想找到它的最小值,首先初始化梯度下降算法,在那个品红色的点初始化,如果更新一步梯度下降,也许它会带我到这个绿点,因为这个点的导数是相当陡的。现在,在这个绿色的点,如果我再更新一步,你会发现我的导数,也即斜率,是没那么陡的。随着我接近最低点,我的导数越来越接近零,所以,梯度下降一步后,新的导数会变小一点点。然后我想再梯度下降一步,在这个绿点,我自然会用一个稍微跟刚才在那个品红点时比,再小一 点的一步,到了新的红色点,更接近全局最低点了,因此这点的导数会比在绿点时更小。所以,我再进行一步梯度下降时,我的导数项是更小的,θ1 更新的幅度就会更小。所以随着梯度下降法的运行,你移动的幅度会自动变得越来越小,直到最终移动幅度非常小,你会发现, 已经收敛到局部极小值。

所以当我们接 近局部最低时,导数值会自动变得越来越小,所以梯度下降将自动采取较小的幅度,这就是梯度下降的做法。所以实际上没有必要再另外减小a。

3.梯度下降的线性回归

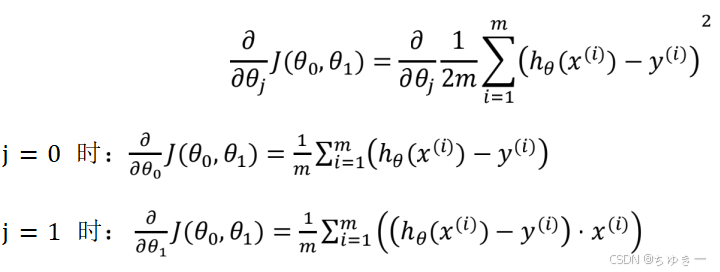

梯度下降算法和线性回归算法比较如图: 对我们之前的线性回归问题运用梯度下降法,关键在于求出代价函数的导数,即:

对我们之前的线性回归问题运用梯度下降法,关键在于求出代价函数的导数,即:

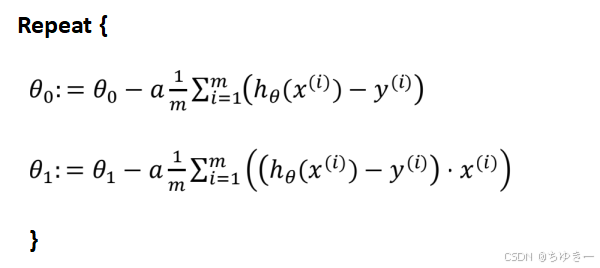

算法改写成:

刚刚使用的算法,有时也称为批量梯度下降。实际上,在机器学习中,通常不太会给算法起名字,但这个名字”批量梯度下降”,指的是在梯度下降的每一步中,我们都用到了所有的训练样本,在梯度下降中,在计算微分求导项时,我们需要进行求和运算,所以,在每一个单独的梯度下降中,我们最终都要计算这样一个东西,这个项需要对所有训练样本求和。因此,批量梯度下降法这个名字说明了我们需要考虑所有这一"批"训练样本,而事实上,有时也有其他类型的梯度下降法,不是这种"批量"型的,不考虑整个的训练集,而是每次只关注训练集中的一些小的子集。

应用刚刚学到的算法,你应该已经掌握了批量梯度算法,并且能把它应用到线性回归中了,这就是用于线性回归的梯度下降法。

2195

2195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?