最新的Llama🦙(Large Language Model Meta AI) 3.1是由Meta AI开发的一个强大的人工智能模型,在自然语言处理(NLP)社区中引起了广泛关注。它是迄今为止最强大的开源大语言模型。在这篇博客中,我将指导您如何从Hugging Face🤗克隆Llama 3.1模型,并使用Python在本地机器上运行它。之后,您就可以将其集成到任何AI项目中。

前提条件

- 本地机器上安装了Python 3.8或更高版本

- 安装了Hugging Face Transformers库(

pip install transformers) - 本地机器上安装了Git

- 拥有一个Hugging Face账户

步骤1:获取模型访问权限

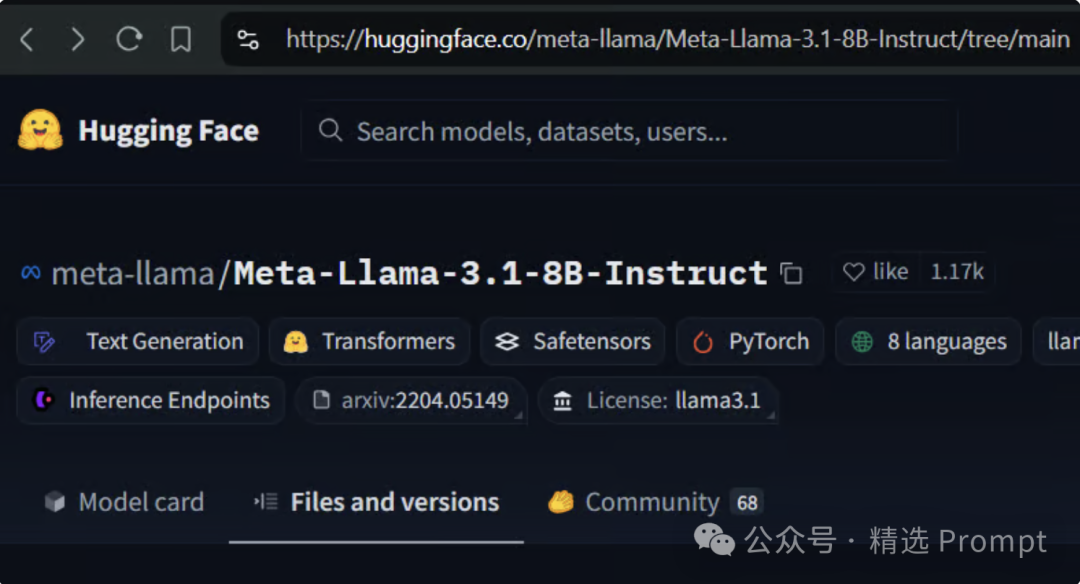

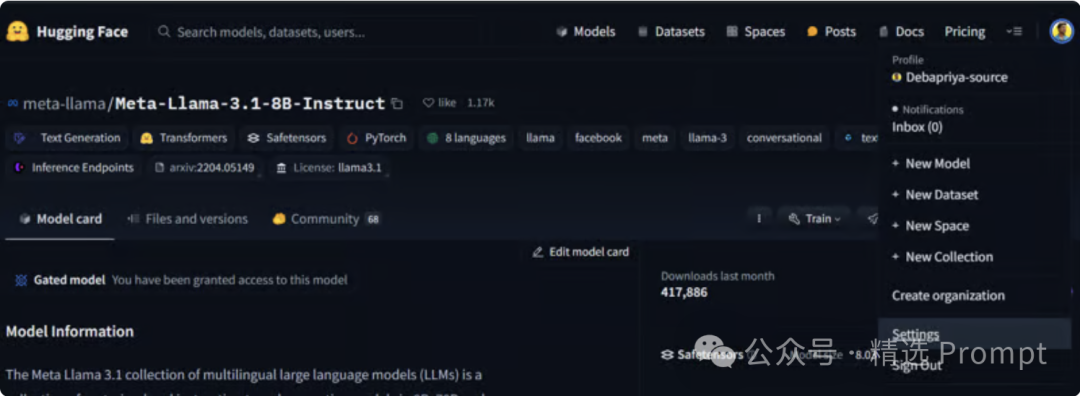

- 点击此链接打开Meta的Llama-3.1-8B-Instruct模型在Hugging Face上的官方仓库(您可以用同样的方式使用其他llama 3.1模型)。

Meta-llama-3.1-8b-Instruct hugging face模型

Meta-llama-3.1-8b-Instruct hugging face模型

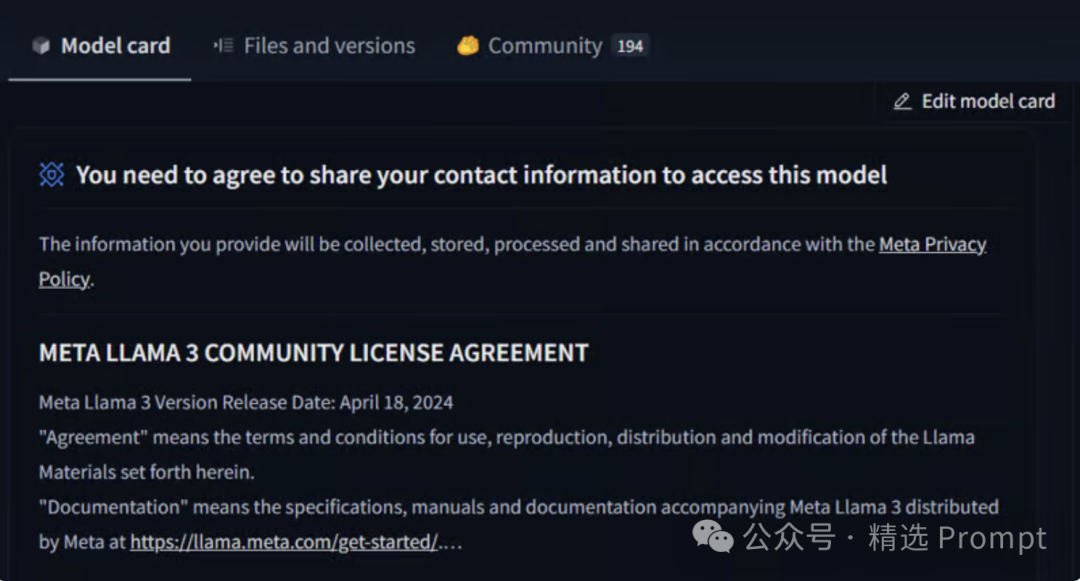

- 一开始您应该看到这个:

Meta-llama-3.1-8b-Instruct模型

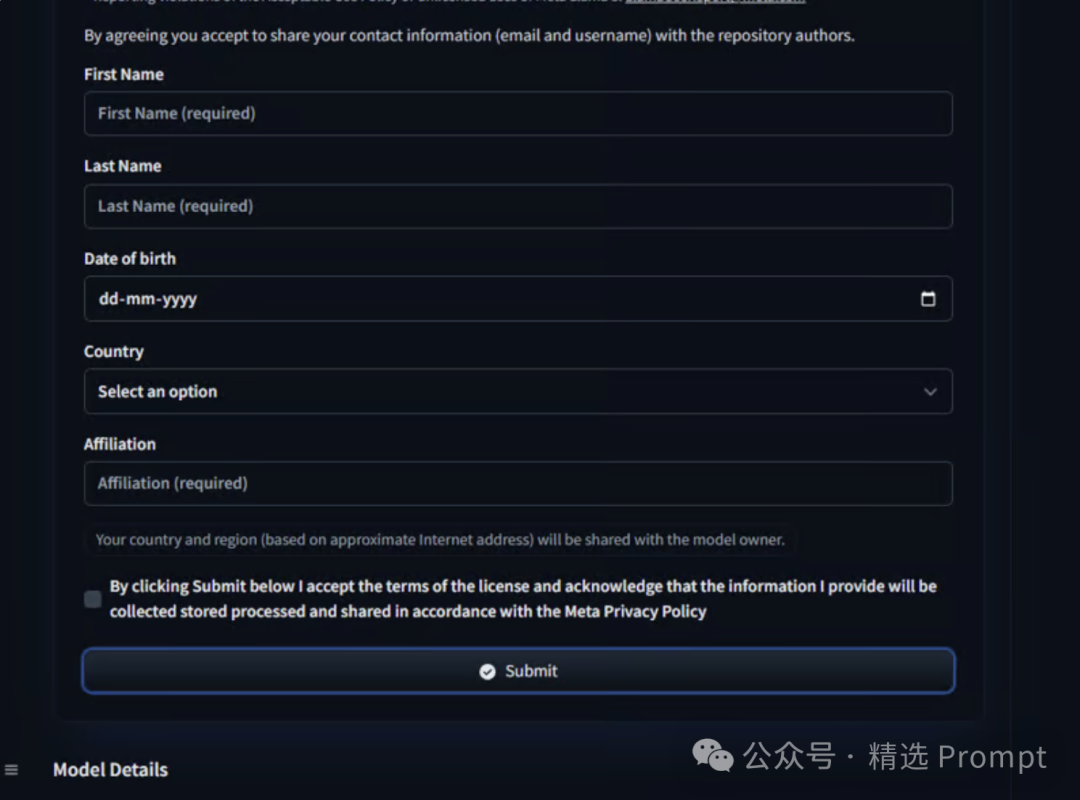

- 提交下面的表单以获得模型的访问权限

访问meta llama 3.1模型

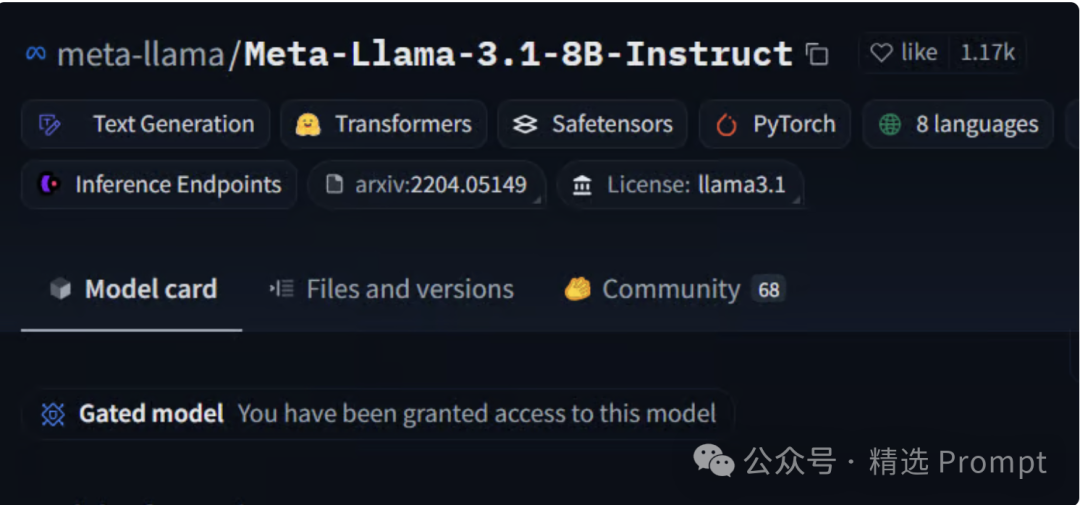

- 一旦您看到 “You have been granted access to this model”,就说明您已经可以开始了…

hugging face中的受限模型

步骤2:创建ACCESS_TOKEN

- 进入 “Settings” (下图右下角):

hugging face设置

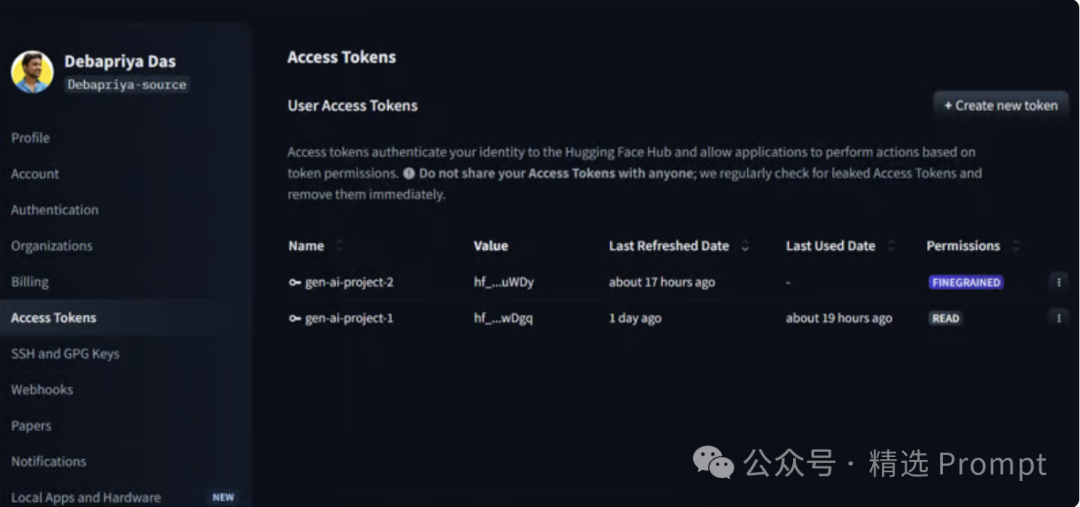

- 进入 “Access Tokens” 点击 “Create new token”(图片右上角):

创建hugging face令牌

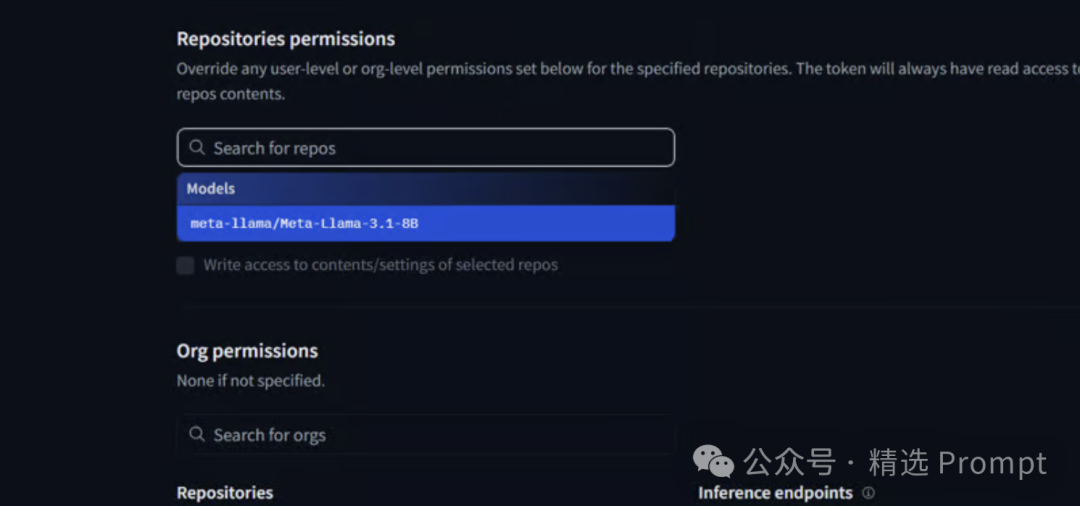

- 给予读写权限并选择仓库,如图所示:

创建hugging face令牌

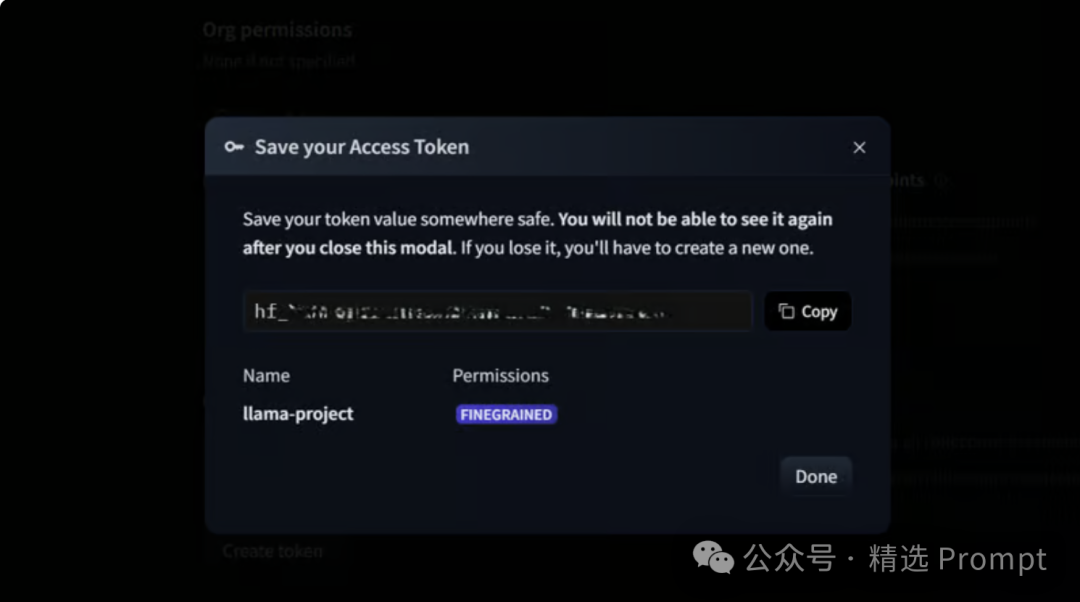

- 复制令牌并将其保存在安全的地方,因为将来会需要它。(注意: 一旦您复制了它,就无法再次复制,所以如果您忘记了密钥,就必须重新创建一个:))

huggingface令牌

步骤3:克隆LLaMA 3.1模型

现在在您喜欢的终端上运行以下命令。

ACCESS_TOKEN是您复制的令牌,``是您Hugging Face账户的用户名。

git clone https://<huggingface-user-name>:<ACCESS_TOKEN>@huggingface.co/meta-llama/Meta-Llama-3.1-8B-Instruct

这可能需要很长时间,取决于您的网络速度。

步骤4:安装所需的库

克隆完成后,进入克隆的文件夹并从requirements.txt安装所有依赖项。(您可以使用conda(推荐)或virtualenv创建虚拟环境) 您可以在下面资源部分提供的我的GitHub中找到requirements文件。

使用conda:

cd Meta-Llama-3.1-8B-Instruct

conda install --yes --file requirements.txt

使用pip:

cd Meta-Llama-3.1-8B-Instruct

pip install -r requirements.txt

步骤5:运行Llama 3.1模型

创建一个新的Python文件(例如,test.py),并将您刚刚克隆的模型仓库的位置粘贴为model_id(例如,"D:\\Codes\\NLP\\Meta-Llama-3.1-8B-Instruct")。这里是一个例子:

import transformers

import torch

## 在这里粘贴您克隆的仓库位置

model_id = "D:\\Codes\\NLP\\Meta-Llama-3.1-8B-Instruct"

pipeline = transformers.pipeline(

"text-generation",

model=model_id,

model_kwargs={"torch_dtype": torch.bfloat16},

device_map="auto",

)

messages = [

{"role": "user", "content": "Who are you?"},

]

outputs = pipeline(

messages,

max_new_tokens=256,

)

print(outputs[0]["generated_text"][-1])

如果您想使用GPU,可以设置device_map=cuda。

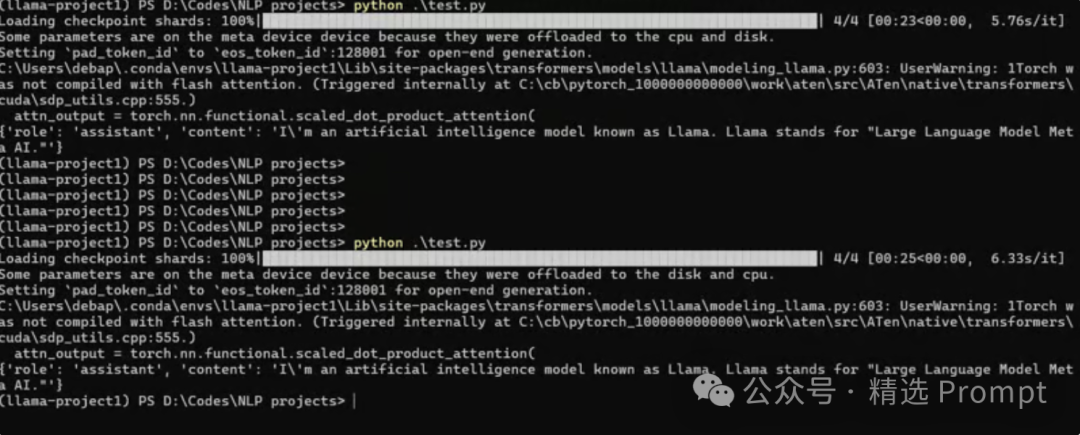

步骤6:运行Python脚本

python test.py

输出

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么我作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,希望可以帮助到更多学习大模型的人!至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

👉 福利来袭CSDN大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

全套AGI大模型学习大纲+路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉 福利来袭CSDN大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?