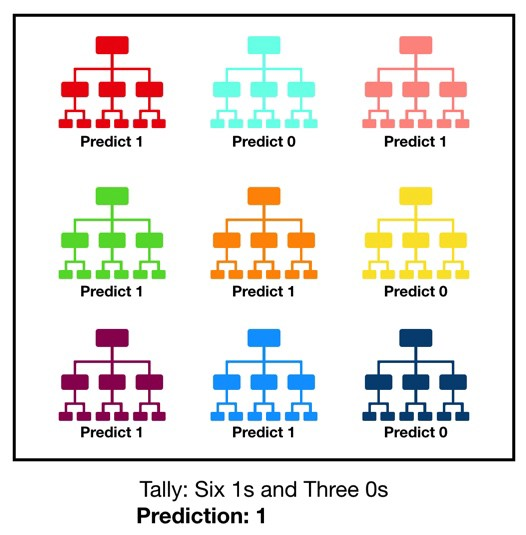

随机森林是一个非常直观,理解起来也比较容易的Bagging算法。前面我们介绍过决策树,其最大的一个缺点就是容易过拟合。随机森林则是由若干决策树组成的模型,其思想就是“三个臭皮匠顶个诸葛亮”。比如下图,就是由9个决策树组成的一个随机森林,其中6个决策树预测值为1,三个预测为0 ,所以最终预测值取多数方:1。如果是回归问题,一般取所有决策树预测结果的均值。

理解随机森林的关键点在于理解“ 相关度低甚至不相关的多个决策树组合在一起的效果好于其中任何一个决策树 ”。这里拿一个例子做论证(注:此例来自第一个参考文章),做一个游戏:使用一个均匀分布的随机数产生器产生一个数字,如果这个数字大于等于40,则算你赢,可以获得一些钱;如果小于40,则算你输,你需要给对方同样数额的钱。现在有三种玩法供选择:

- 玩法1(Game1):玩100次,每次的筹码是1元。

- 玩法2(Game2):玩10次,每次筹码是10元。

- 玩法3(Game3):玩1次,筹码是100.

你会怎么选哪一个?我们计算一下赢钱的期望值:

- $E_1 = (0.6*1+0.4*(-1))*100=20$

- $E_2=(0.6*10+0.4*(-10))*100=20$

- $E_3=(0.

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

286

286

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?