GIT统计代码量

-

Git统计个人提交代码行数

git log --format='%aN' | sort -u | while read name; do echo -en "$name\t"; git log --author="$name" --pretty=tformat: --numstat | awk '{ add += $1; subs += $2; loc += $1 - $2 } END { printf "added lines: %s, removed lines: %s, total lines: %s\n", add, subs, loc }' -; done

-

Git统计项目总行数

git log --pretty=tformat: --numstat | awk '{ add += $1; subs += $2; loc += $1 - $2 } END { printf "added lines: %s, removed lines: %s, total lines: %s\n", add, subs, loc }' -

-

查看git上个人代码量(需要修改username!!!)

git log --author="username" --pretty=tformat: --numstat | awk '{ add += $1; subs += $2; loc += $1 - $2 } END { printf "added lines: %s, removed lines: %s, total lines: %s\n", add, subs, loc }' -

-

查看时间范围内,个人代码量统计

git log --since="2021-01-08" --before="2021-01-14" --author="liuwei" \

--pretty=tformat: --numstat | awk '{ add += $1; subs += $2; loc += $1 - $2 } END { printf "新增行数: %s, 移除行数: %s, 总行数: %s\n", add, subs, loc }'

-

查看仓库提交者排名前 5

git log --pretty='%aN' | sort | uniq -c | sort -k1 -n -r | head -n 5

-

贡献者统计

git log --pretty='%aN' | sort -u | wc -l

-

提交数统计

git log --oneline | wc -l

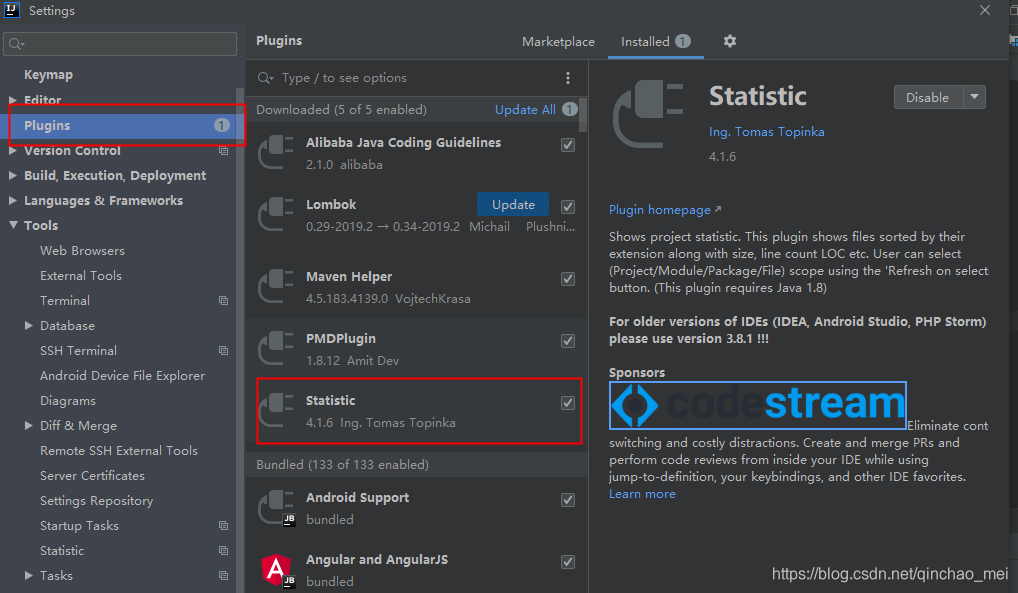

Statistic统计

- idea按照Statistic插件

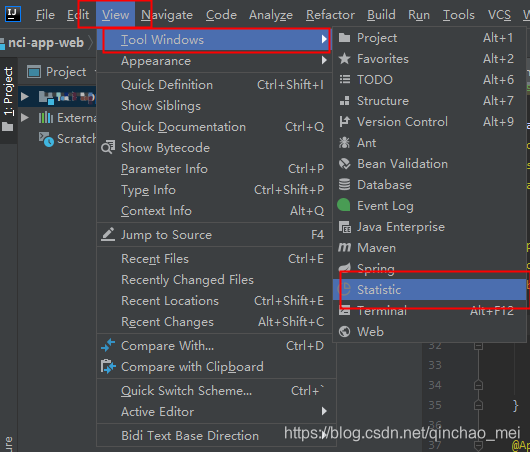

- 重启后执行statistic

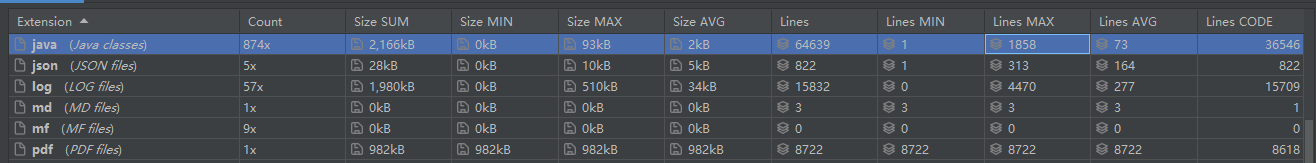

- idea下方会显示Statistic以下列表统计框

- Extension:文件扩展后缀名

- Count:文件数量

- Size SUM:文件大小

- Size MIN:同类文件中最小文件的大小

- Size MAX:同类文件中最大文件的大小

- Size AVG:文件平均大小

- Lines: 同类文件所有行数

- Lines MIN:同类文件中行数最小

- Lines MAX:同类文件中行数量大

- Lines AVG:同类文件的平均行数

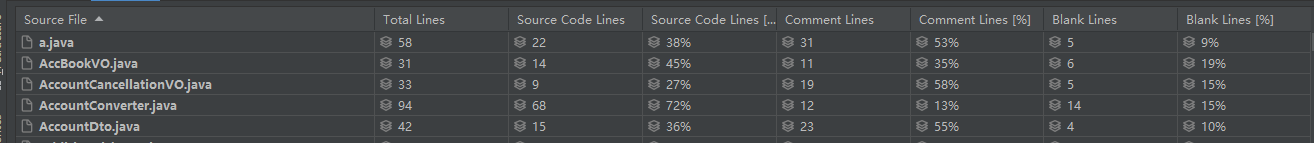

- Total Lines :代码总行数(包括注释,空行)

- Source Code Lines :源代码行数(不包括注释,空行)

- Source Code Lines(%) :源代码行数百分比(Source Code Lines/Total Lines)

- Comment Lines :注释行数

- Comment Lines(%) : 注释行数百分比(Comment Lines/Total Lines)

- Blank Lines : 空行数

- Blank Lines(%) : 空行百分比(Blank Lines/Total Lines)

2413

2413

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?