-

机器学习的可行性

假设有如下学习问题:

训练数据D包含了6张3*3的黑白图片,并给出了对应的输出,根据这些信息确定一个近似目标函数g,并用g计算最下方图片的输出。

甲认真看了下发现第一行三张图片左上角都是黑色色块,第二行三张图片左上角都是白色色块,最下面那张左上角是黑色,所以g(x)=-1;乙发现第一行三张图片都不是对称的,第二行三张图片总能找到一个对称轴,而最下面那张图也有一个对称轴,所以g(x)=+1。在这个例子中,你给出一个备选的g函数,总能找到另一个g'函数在D上成立,并且输出与g相反,也即,在D上正确的g,在D以外的数据上不一定正确!更苦逼的是,D以外的计算结果我们无法验证它的正确性!

再举一个相似的例子:

输入集{χ}={0,1}^3;,输出集{η}={○,x}

训练数据D -》

由于该问题比较简单,我们可以把所有在D上成立的备选函数 fi 枚举出来:

f1 ~ f8 都有可能是函数g,但是我们确定不了。

在上面的两个例子中,在D的基础上都能得出不止一个备选函数 fi,并且无法确定这些备选函数的正确性。对于这样的问题,可以讲机器学习是无能为力的。

-

概率方法

根据上一节,用有限的数据D,去推测D超集上的目标函数f有可能会失败。这种用已知推测未知的问题在概率论中同样存在:

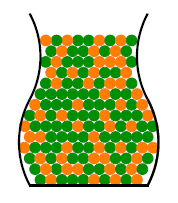

在一个罐子里,放着很多小球,他们分两种颜色{橘色,绿色}。有什么办法能够推测橘色小球所占的比例?

从罐中随机抓一把小球,有N个。

设:罐中橘色球的比例为μ(未知),抓出来的样本中橘色球的比例为ν(已知)。ν能代表μ吗?

根据概率论中的霍夫丁不等式(Hoeffding’s Inequality),若N足够大,ν就很可能接近μ。

-

概率方法与机器学习的联系

罐子中橘色球的比例μ --》备选函数h(x)的正确性(是否接近f(x)),h∈H

罐子中的小球 --》 输入集{χ}

作为样本的N个小球 --》 训练集D={ xi, yi } ( i=1, ... ,N) D∈{χ}

橘色小球 --》h(xi)错误,或h(xi)≠f(xi)

绿色小球 --》h(xi)正确,或h(xi)=f(xi)

这里假设小球与数据x都是独立同分布的。

显然,N足够大的时候可以用D上的 [h(x)≠f(x)] 来推测{χ}上的 [h(x)≠f(x)]。就是说,如果样本足够大,那么备选函数h在D上犯错误的比例接近其在{χ}上犯错误的比例。

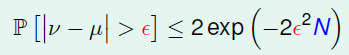

设某一备选函数h在D上的犯错比例为E-in(h),在整个输入集上的犯错比例为E-out(h),则有:

这意味着我们可以根据备选函数h在D上的表现来衡量它的正确性,并最终从备选函数集H中选出最优的那个h作为g,且g≈f。

-

真实的机器学习

到此为止万无一失了吗?No,因为概率论喜欢与人开玩笑。举个例子,150个人,每人抛一个硬币5次,至少有一个人5次皆为人头向上的概率为:

1 - (31/32)^150 = 99.15%

所以一个小概率事件如果重复多次,他发生的概率就会变得很大。

同理,如下情形是有可能的:

学习算法A在备选函数集H中(含有很多h)孜孜不倦地挑选着h,突然找到一个hi,发现它在D上没犯错误或只犯了很少错误,A高兴大喊:我找到g了,就是这个hi!但实际上这个hi在{χ}上却犯了很多错误(E-in(hi)与E-out(hi)差很远)。对于这个hi来说,D是一个坏样本(Bad Sample)。

H中可能提取若干样本Di,{ i= 1, 2,3 . . . },对于某一个h来说,其中一些样本是Bad Sample。那么对于任意样本D和给定的h,有:

(for h)

(for h)在整个备选函数集H(有M个元素)上,以下4个命题等价:

---D是H的Bad Sample

---D是某些h的Bad Sample

---学习算法A不能在H中做自由筛选

---存在某些h使得E-in(h)与E-out(h)差很远

所以,D-1126这样的训练数据集是比较优质的。

给定任意D,它是某些H的Bad Sample的概率为:

即H中备选函数的数量M越少,样本数据量N越大,则样本成为坏样本的概率越小。在一个可接受的概率水平上,学习算法A只需要挑选那个表现最好的h作为g就行了。

以上推论成立的必要条件是M有限,当M→∞时怎么办?下次讨论。

台大机器学习——可行性证明1

最新推荐文章于 2021-11-07 21:11:35 发布

文章转自:https://my.oschina.net/findbill/blog/207243

557

557

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?