多层感知机模型

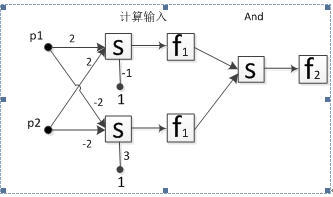

之前说单层的感知机模型不能处理线性不可分问题,多层感知机却可以成功胜任。下面再从异或入手解决问题。图片来源(

自己动手写神经网络)。

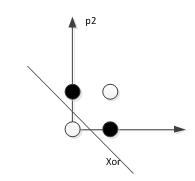

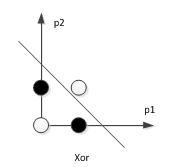

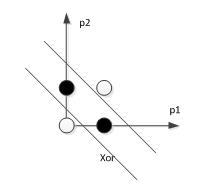

如上图两层的感知机就能完成对XOR问题的正确划分。第一层的上侧是函数:2*p1+2*p2-1,下侧是函数-2*p1-2*p2+3,第二层是函数And就是与操作。可以得出它们对问题的划分如下:

即多层感知机把不能一次线性区分的问题分几次来解决,先解决分开解决各个部分再统一解决各个部分。有了这样的思路之后,关于神经网络的研究又开始如火如荼了。

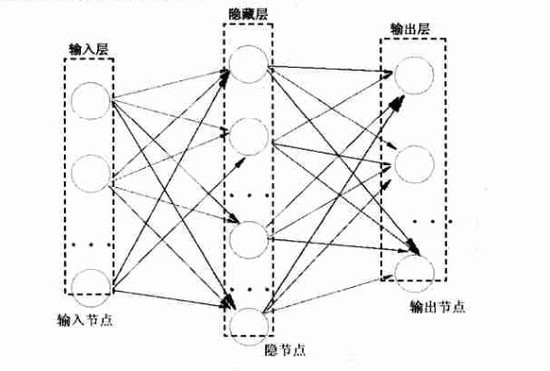

BP神经网络

sigmoid函数

BP(Back Propagation)神经网络也是用的多层感知机模型,训练方法是误差逆传播,就是从输出层计算误差,反向向前传播,逐层修改连接权重的权值。

神经网络用的函数f是sigmoid函数(之前有说过)。

神经网络用的函数f是sigmoid函数(之前有说过)。

sigmoid函数把

映射到了(0,1),而且有个有意思的性质

映射到了(0,1),而且有个有意思的性质

,所以它的导数很容易求。我们为什么要把这个激励函数从普通的加权和换成sigmoid函数呢?因为BP算法要求导,sigmoid函数更加胜任。

,所以它的导数很容易求。我们为什么要把这个激励函数从普通的加权和换成sigmoid函数呢?因为BP算法要求导,sigmoid函数更加胜任。

映射到了(0,1),而且有个有意思的性质

映射到了(0,1),而且有个有意思的性质

,所以它的导数很容易求。我们为什么要把这个激励函数从普通的加权和换成sigmoid函数呢?因为BP算法要求导,sigmoid函数更加胜任。

,所以它的导数很容易求。我们为什么要把这个激励函数从普通的加权和换成sigmoid函数呢?因为BP算法要求导,sigmoid函数更加胜任。

BP算法

一个普通的三层BP网络如下所示

我们定义误差函数

其中outputs是网络中输出层单元的集合,

我们BP的目的就是使误差函数E最小,理所当然地想到之前的梯度下降法,推导之前约定描述如下:

outputs:输出层单元的集合。

Downstream(j):上一层单元包含j的集合。

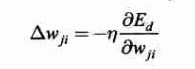

增量梯度下降算法中,对于每个训练样本中第 d 个观测的一个输入权重 w ij 的增量如下表示:

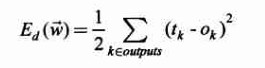

其中 E d 是训练样本中第 d 个观测的误差,通过对输出层所有单元的求和得到:

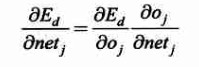

下面我们就要求梯度了(要分层求解,输出层,隐藏层),梯度向量中的各元素求解如下:

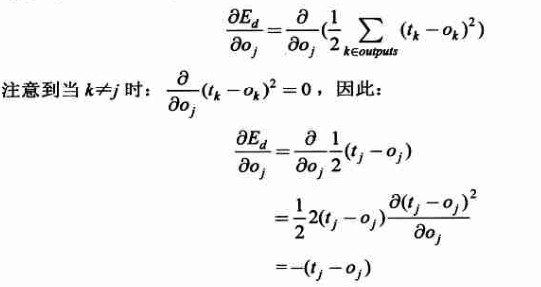

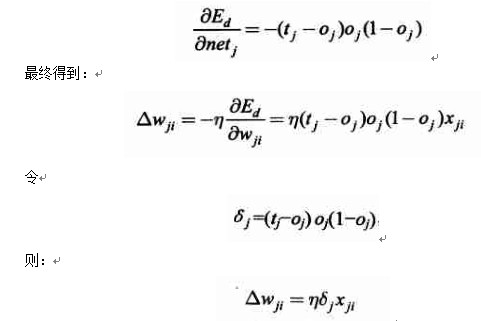

1 )当单元 j 是一个输出单元时:

于是得到:

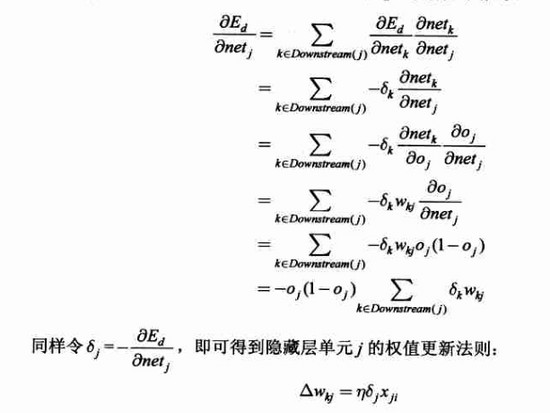

2 )当单元 j 是一个隐藏层单元时,有如下推导:

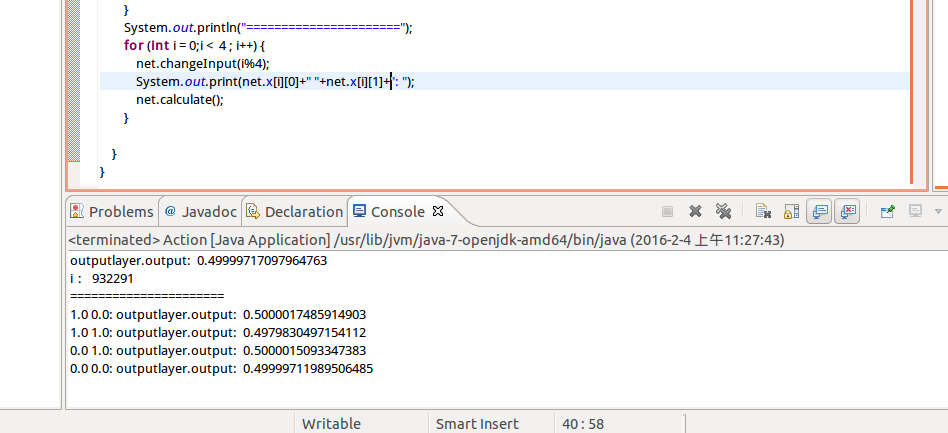

实现

可以看到迭代到第932291代收敛了,可以区分异或问题了。第一次写net,写得不是很好,可以再改进改进,忘了wx+b的b了,加上估计会好点。

本人一边学,一边写,算给自己动力吧~~

2762

2762

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?