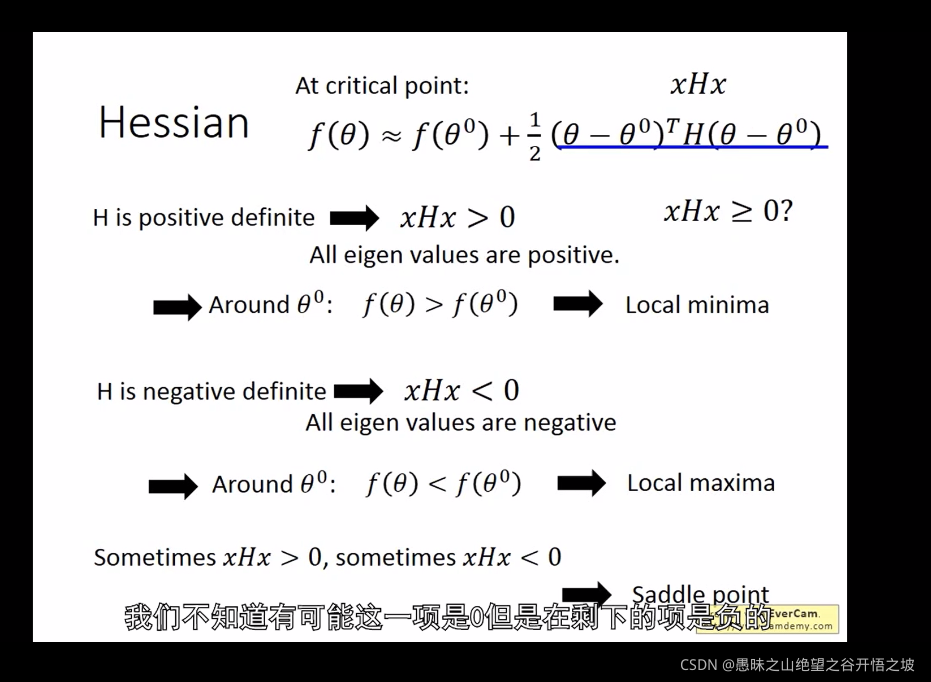

1、本质上就是高等数学最基础的求极值,一阶梯度为0不一定是极值,还需要判断二阶梯度,就这么直接简单,大于0极大值,小于0极小值,等于0不确定可能大可能小,就是鞍点。

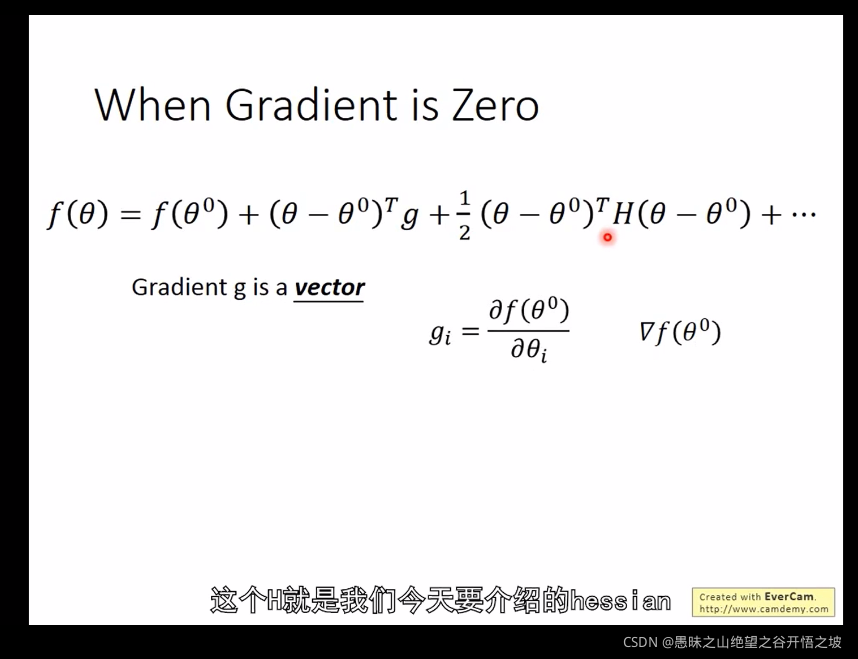

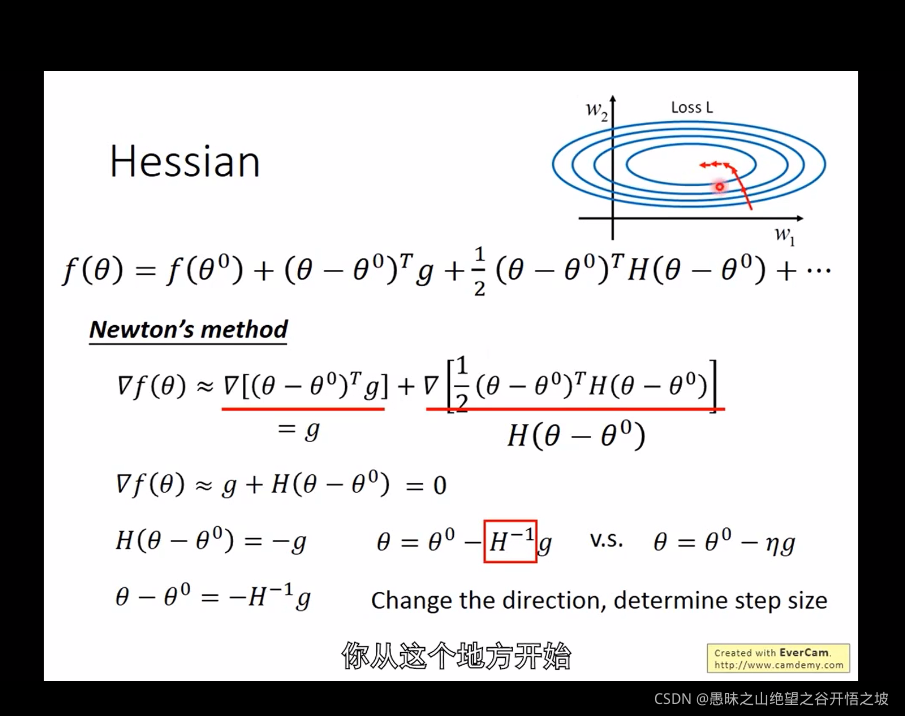

2、随机梯度下降就是用第一项去拟合曲线,这个是存在误差的,但是后面的海森矩阵计算复杂度太高了,所以这样近似相加比高。

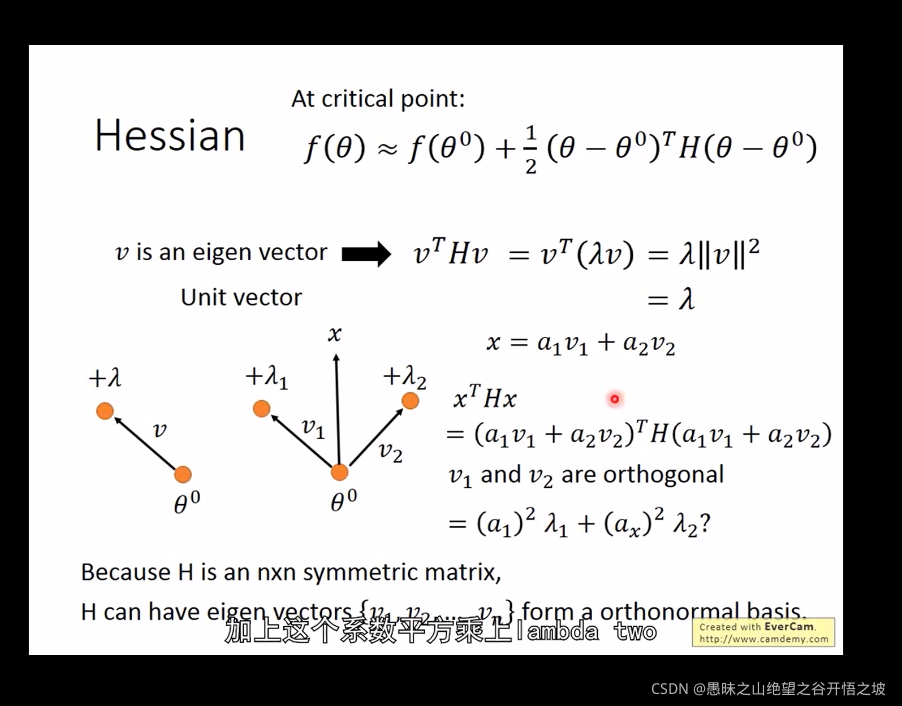

3、剩下的就是线性代数的基本知识,特征向量和特征值。整个就是数学在人工智能领域的一个应用而已。

评论

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?

查看更多评论

添加红包

这篇博客探讨了人工智能中数学的基础作用,重点讲解了如何利用高等数学求取极值,强调一阶梯度为0并不确保极值,需要通过二阶梯度判断。同时,解释了随机梯度下降法在拟合曲线时的误差和效率考量。此外,还提到了线性代数中的特征向量和特征值在人工智能领域的应用。

这篇博客探讨了人工智能中数学的基础作用,重点讲解了如何利用高等数学求取极值,强调一阶梯度为0并不确保极值,需要通过二阶梯度判断。同时,解释了随机梯度下降法在拟合曲线时的误差和效率考量。此外,还提到了线性代数中的特征向量和特征值在人工智能领域的应用。