百度站长平台 robots 在 11 月 27 日全新升级,主要是新增了 2 大功能:

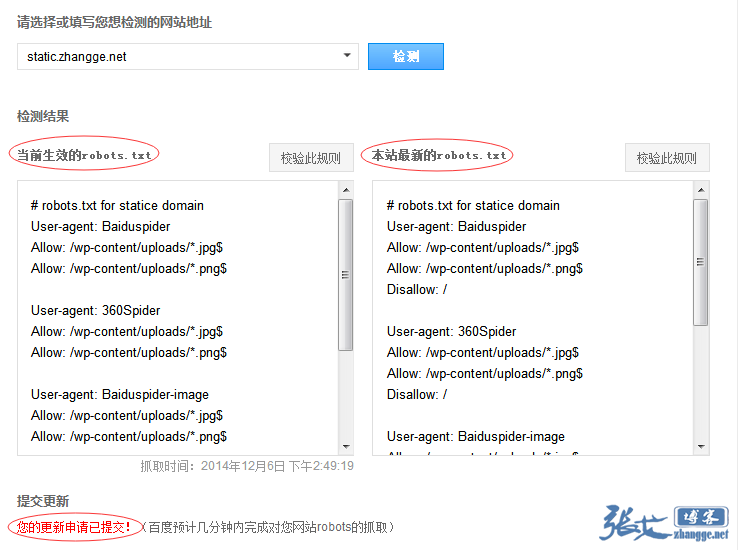

①、可分别显示已生效的 robots 和网站最新的 robots,以便站长自行判断是否需要提交更新:

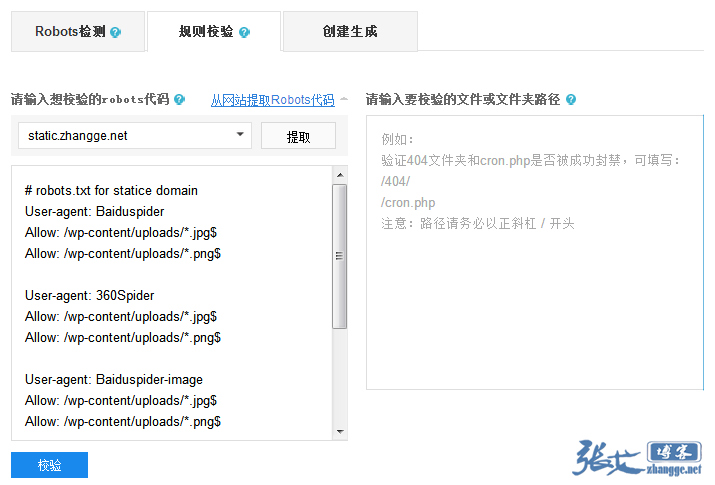

②、新增 robots 校验功能,从此不再写错规则,把蜘蛛挡在门外:

对此,很多关注互联网的博客网站都已发文分享,而且官方也有具体说明,我就不继续赘述了。

写这篇文章的目的,只要是为了纠正以前的一个 robots 认知错误!记得张戈博客前段时间分享过一篇《浅谈网站使用七牛云存储之后的 robots.txt 该如何设置?》,我在文章分享的七牛镜像域名的 robots 应该如下设置:

本来当时使用百度 robots 检测也是没问题的:

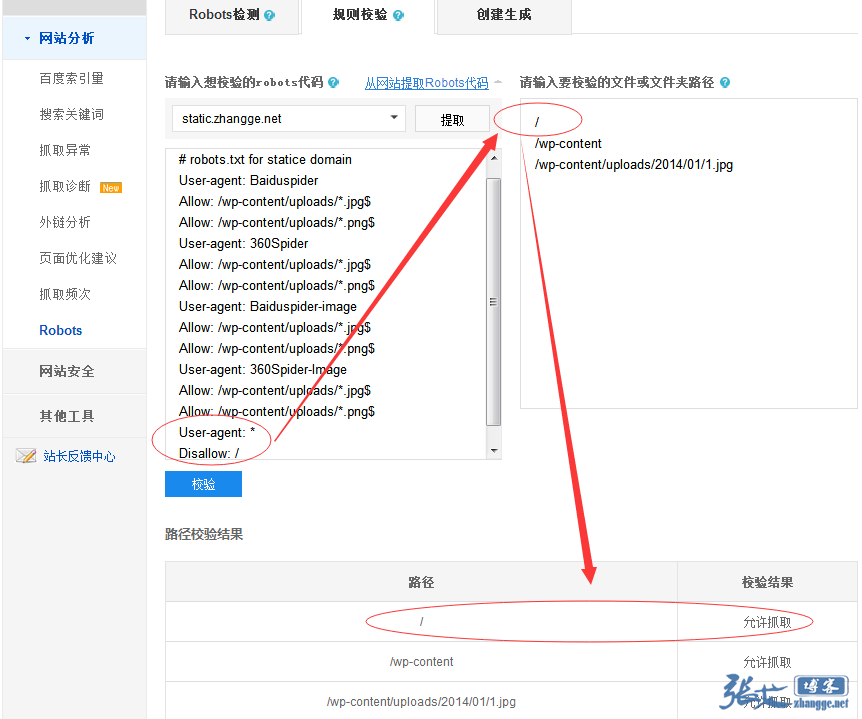

当这次 robots 工具升级之后,我使用新增的【规则校验】功能试了下,竟然是如下结果:

纳尼?最后的禁封难道不起作用了??于是,我试着把禁止规则移动到最前面看看效果:

结果,依然全部允许抓取!!这不科学啊!

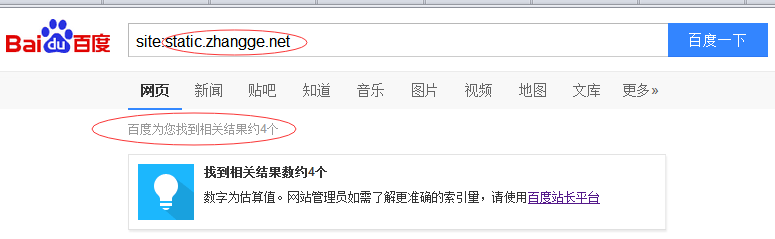

想了半天,我看只有一个解释了,那就是百度只看 Baiduspider 标签了,其他的规则它不理睬!难怪之前百度依然会收录我的七牛静态域名:

好吧,上有政策下有对策,对之前的规则稍作修改即可:

# robots.txt for statice domain

User-agent: Baiduspider

Allow: /wp-content/uploads/*.jpg$

Allow: /wp-content/uploads/*.png$

Disallow: /

User-agent: 360Spider

Allow: /wp-content/uploads/*.jpg$

Allow: /wp-content/uploads/*.png$

Disallow: /

User-agent: Baiduspider-image

Allow: /wp-content/uploads/*.jpg$

Allow: /wp-content/uploads/*.png$

Disallow: /

User-agent: 360Spider-Image

Allow: /wp-content/uploads/*.jpg$

Allow: /wp-content/uploads/*.png$

Disallow: /

User-agent: *

Disallow: /

164

164

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?