激活函数(Activation Function) 对激活函数、梯度消失或梯度爆炸的原因、解决办法都做了很透彻的讲解!

1、有关“梯度消失和梯度爆炸”,自己的理解

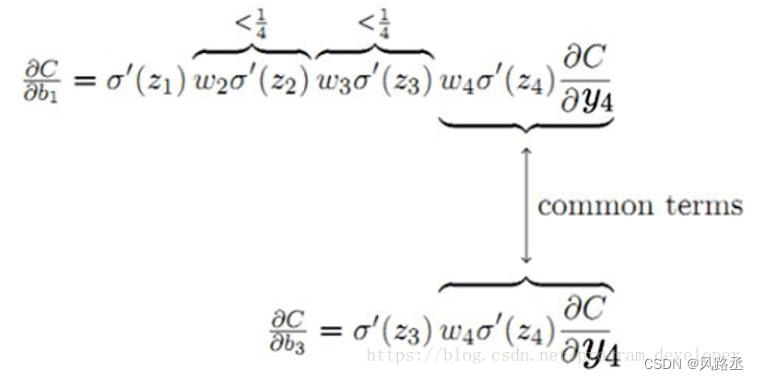

(1)梯度消失和梯度爆炸都发生在靠近输入层的神经元网络,原因:

- 梯度的

链式相乘;- 越靠近输入层,求导的链式越长。如下图所示,b1、b3的后半部分导数是完全相同的,可以认为:

b1的导数 =λ * b3的导数。

其中λ就是 引发 输入层发生梯度和梯度爆炸的根源。

(2)解决办法

因为λ 中包含之前层的导数σ 和 之前层的权重wi,所以解决他们的办法也是从这2项入手:

- 减少训练深度(使得链式计算变短,避免出现不恰当的

λ)- 选择合适的激活函数(针对

导数σ)- 选择合适的权重初始化方法(针对

权重w)- 正则L1, L2(针对

权重w):模型训练的正则L1、L2- batchNorm、layerNorm:layerNorm和batchNorm

- …

本文探讨了梯度消失和梯度爆炸在神经网络中的现象,强调它们主要影响靠近输入层的神经元。原因在于链式求导导致的梯度放大或缩小。文章提出了通过减小网络深度、选择适当激活函数、权重初始化策略以及使用正则化技术如L1/L2、batchNorm和layerNorm来解决这些问题。

本文探讨了梯度消失和梯度爆炸在神经网络中的现象,强调它们主要影响靠近输入层的神经元。原因在于链式求导导致的梯度放大或缩小。文章提出了通过减小网络深度、选择适当激活函数、权重初始化策略以及使用正则化技术如L1/L2、batchNorm和layerNorm来解决这些问题。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?