- 本文配置环境基于

- CentOS系统

- 部署jdk

- 部署Tomcat服务器

- 至少3台虚拟机

- 网络设置

- 虚拟机ip地址别名设置,服务器之间相互ping通

- 时间同步

- 免密钥登陆

hadoop1安装和配置

- 配置文件信息

- 规划

- 启动虚拟机,并关闭三台虚拟机的防火墙

- 将hadoop安装包上传座位NameNode的服务器node01,并解压

- 环境变量配置,安装包解压的文件夹中的ect/hadoop目录下的hadoop-env.sh

echo $JAVA_HOME查看自己配置jdk的javahome环境变量

vim /home/hadoop-2.6.5/etc/hadoop/hadoop-env.sh打开配置文件,修改环境变量

- 修改同一目录下,

vim core-site.xml设置核心的相关配置

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://node01:9000</value> #填写规划成作为NameNode的服务器的ip地址别名,端口9000

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop-2.6.1</value> #namenode和datanode的存放位置,默认就放在这个路径中

</property>

</configuration>

- 修改同一目录下,

vim hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value> #副本的数量

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>node02:50090</value> #填写规划成为SecondaryNameNode的服务器的ip地址别名,端口号50090

</property>

<property>

<name>dfs.namenode.secondary.https-address</name>

<value>node02:50091</value> #和上述一样,上述是配置http 这是配置https

</property>

</configuration>

- 在同一目录下,创建masters文件,写上SecondaryNameNode服务器的节点名(ip地址别名)

vim /home/hadoop-2.6.5/etc/hadoop/masters虚拟机ip地址别名设置很重要,没有配置请查找我的博客

[规划成为SecondaraNameNode的服务器ip地址别名]

- 修改同一目录下,slaves文件,配置DataNode服务器

vim /home/hadoop-2.6.5/etc/hadoop/slaves

[规划成为DataNode服务器的ip地址别名]

- 回到解压hadoop安装文件夹的目录下,将配置好的文件夹复制到其他的服务器的同等路径下

scp -r hadoop-2.6.5 node02:/home/

scp -r hadoop-2.6.5 node03:/home/

- 在根目录下配置hadoop局部环境变量:解压文件夹下的bin和sbin

vim ~/.bash_profile

- 将配置好的文件拷贝到其他的服务器的同等路径下

scp -r ~/.bash_profile node02:/root/

scp -r ~/.bash_profile node03:/root/

- 现在让这些配置好环境变量的服务器使用source命令生效

source ~/.bash_profile

-

输入h,再按Tab键测试是否配置成功

-

操作规划作为NameNode的服务器,我这儿是node01,回到根目录使用

hdfs namenode -format进行格式化

-

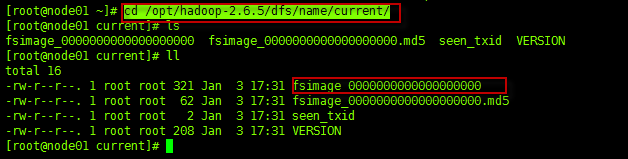

cd /opt/hadoop-2.6.5/dfs/name/current/目录下存放了fsimage镜像信息

-

启动HDFS分布式文件存储系统

start-dfs.sh

- 浏览器访问[NameNodeip]:[端口号]看是否成功

2678

2678

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?