第一步:在windows系统中安装linux虚拟机

1、 首先安装VMwareWorkstation,我在本地使用12.5.6版本;

2、 下载centos6.3镜像,CentOS-6.3-x86_64-bin-DVD1.iso;

3、 创建好虚拟机

第二步:配置网络

1、设置本地网卡的IP等信息

2、设置虚拟机网络

(1)修改ifcfg-eth0文件信息

命令如下:

修改信息如下:

修改完成后重启网络:service network restart

关闭防火墙:service iptables stop(临时)

chkconfig iptables off(永久)

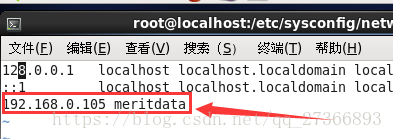

3、 修改hosts文件

添加meritdata主机所对应的ip地址

第三步:安装jdk(root用户)

1、使用ftp将提前装备好的文件上传至/bigdata文件夹下

2、解压jdk:tar -vxf jdk-7u79-linux-x64.tar.gz

3、建立软连接:ln -s /bigdata/jdk1.7.0_79 java

创建好后查看如下:

4、配置jdk的环境变量

vi /etc/profile

增加如下代码:

exportJAVA_HOME=/bigdata/java

export CLASSPATH=/bigdata/java/lib

export PATH=$JAVA_HOME/bin:$PATH

source/etc/profile

5、查看jdk是否安装成功

第四步:新建用户

Su -root

adduser bigdata

passwd bigdata

cd /

chown -R bigdata:bigdata /bigdata/

第五步:设置SSH免密登录(bigdata用户)

进入到港创建的用户下:

su – bigdata

生成公钥和私钥:

ssh-keygen-t rsa

将公钥导入本机:

cd~/.ssh

catid_rsa.pub > authorized_keys

更改权限:

chmod600 authorized_keys

测试:

ssh host,第一次登录可能需要yes确认,之后就可以直接登录了。

第六步:安装hadoop(bigdata账户下)

1、解压hadoop

登录bigdata用户:su -bigdata

进入/bigdata目录下:cd /bigdata

解压hadoop: tar -vxf hadoop-2.6.0-cdh5.8.2.tar.gz

解压hive: tar -vxf hive-1.1.0-cdh5.8.2.tar.gz

创建hadoop软链接: ln -s hadoop-2.6.0-cdh5.8.2/ hadoop

创建hive软链接: ln -s hive-1.1.0-cdh5.8.2/ hive

2、配置环境变量

编辑profile文件:

vi ~/.bash_profile

增加java及hadoop配置信息:

export JAVA_HOME=/bigdata/java

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export HADOOP_HOME=

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

867

867

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?