1 报错1

提交报错:

- Flink1.8.0之后不支持hadoop编译,故会导致我程序在集群上运行时报错

解决办法:

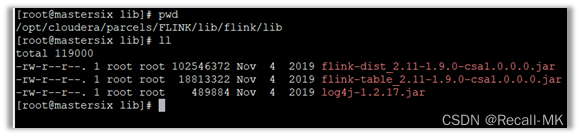

- 下载flink-shaded-hadoop-2-uber-2.7.5-7.0.jar包,并将其放到对应的集群flink所有节点下的的lib目录下,之后重启Flink

2 报错2

提交报错

- java.lang.NoClassDefFoundError: scala/runtime/java8/JFunction1 m c V I mcVI mcVIsp

解决办法:

- 原因是,我的代码编译使用的是scala 2.12.8,我切换成了2.11.4就可以了

3 报错3

INFO ApplicationMaster:54 - Final app status: FAILED, exitCode: 13, (reason: Uncaught exception: org.apache.hadoop.yarn.exceptions.InvalidResourceRequestException: Invalid resource request, requested virtual cores < 0, or requested virtual cores > max configured, requestedVirtualCores=6, maxVirtualCores=4

解决办法

- 简单说就是任务请求6vcores,但是集群最大就4vcore,所以报错

- 修改yarn-site.xml中的

yarn.scheduler.maximum-allocation-vcores

3 Flink检查点生成多个

- Flink的检查点默认是生成一个,想要生成多个需要在conf/flink-conf.yaml中添加如下的参数,在这里我设置的是让其生成2个

state.checkpoints.num-retained: 2

2379

2379

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?