一、合并文件

1. -getmerge

合并后的文件只能保存到本地。可以使用通配符

hadoop fs -getmerge [-nl] <hdfs dir> <local file path>

-nl:合并后的文件中每部分用空格分割

假设在hdfs上有一个/user/spark/output目录,里面有作业执行的结果

part-000000,part-000001,part-000002,SUCCESS文件里面是空的

可以使用命令:hadoop fs -getmerge /user/spark/output dir/mergeFile

二、批量下载且指定下载范围

1. -get如果精确到目录级别,会把目录也下下来,如果精确到文件,则不会自动创建目录,只会下载文件。

2. 支持通配符,会下载/user/hive下所有2020开头的目录下的test开头的文件

hdfs dfs -get /user/hive/2020*/test*

三、查看大小

syntax

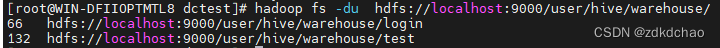

hdfs dfs -du [-s] [-h] [-x] <path> ...

默认单位是B

B是字节,byte,一byte是8bit,一般byte用B,bit用b。

1MB是1024B

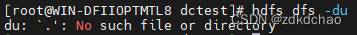

parh不能省,会报错

不加参数,会将path所有目录的大小列出

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?