概述

两种 一种是scala jdbc写入mysql

一种是spark dataset直接写入spark

期间遇到ssl driver 甚至时间戳相差13h等问题都记录了解决方案.

目录

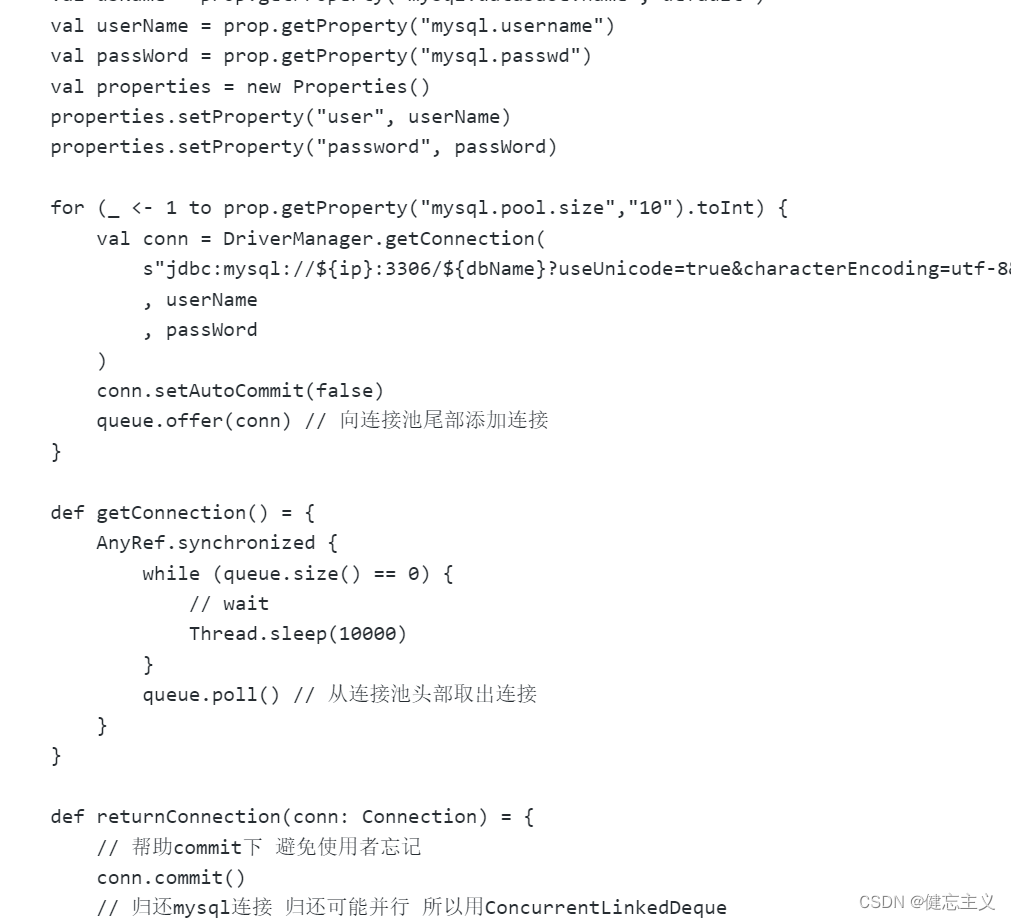

部分代码

使用案例

使用案例

def updateMysqlSD(BUSINESS_TYPE:Int, DATA_TYPE:Int, TOTAL_COUNT:Long, STATS_DATA:String = dealDayFormatWith_)={

val conn = getConnection()

// 先删除处理日期 的旧数据

// 方法1

//conn.prepareStatement(s"DELETE FROM ${mysql_sd_name} WHERE BUSINESS_TYPE=${BUSINESS_TYPE} and DATA_TYPE=${DATA_TYPE} and STATS_DATA=${STATS_DATA};")

// 再插入新数据

//conn.prepareStatement(s"INSERT INTO ${mysql_sd_name} ('BUSINESS_TYPE','DATA_TYPE','TOTAL_COUNT','STATS_DATA','CREATE_TIME') VALUES (${BUSINESS_TYPE},${DATA

订阅专栏 解锁全文

订阅专栏 解锁全文

2498

2498

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?