我的项目是从Kafka消费消息,计算之后发送到elasticsearch存储。

现象:每次重启Flink Task,都会往elasticsearch发送已经计算过的数据。比如本来elasticsearch有3条记录,在不往Kafka生产新消息的情况下,重新启动Flink Task之后有6条,再重启是9条,说明数据重复。

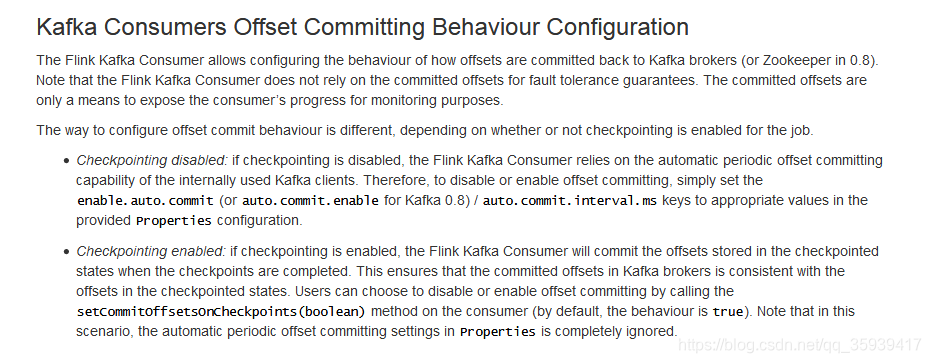

初步怀疑是因为重复消费Kafka的消息,可能是offset没有提交。于是在Flink官网查找相关资料。

上面意思是说,当启用Flink的Checkpointing机制后,默认的offset提交策略是:Flink Kafka消费者会在每次设置检查点完成后提交Kafka的offset。此时配置Kafka消费者的enable.auto.commit是无效的,亲测一直都是false。可以通过setCommitOffsetsOnCheckpoints(false)取消提交Offset与设置检查点之间的关联。

然后我看代码,之前的某位大神把设置检查点的时间间隔设置成了三小时,意思就是说消费者是每三小时提交一次offset,这就不奇怪为什么重启会有大量数据重复了。之前我就怀疑这个参数配置有问题,果然是个坑。最后改成5秒设置一次检查点,数据重复的问题就解决了。

当然,5秒提交一次offset也会存在Flink Task挂掉重启后数据重复消费的情况。是否可以通过setCommitOffsetsOnCheckpoints(false)取消提交Offset与设置检查点之间的关联,然后来自定义提交offset策略来最少化重复的数据?这个有待后期验证。

579

579

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?