二分类问题是应用最广泛的机器学习问题,从这个例子中学习根据电影评论的文字内容划分为正面或负面。

一、IMDB数据集

本节使用IMDB数据集,它包含来自互联网电影数据库(IMDB)的50000条严重两极分化

的评论。数据集被分为用于训练的25000条评论和用于测试的25000条评论,训练集和测试集都包含50%的正面评论和50%的负面评论。

为什么要将训练集和测试集分开?因为不应该将训练机器学习模型的同一批数据再用于测试模型!模型在训练数据上的表现很好,并不意味着它在前所未见的数据上也会变现得很好,我们真正关心的模型在新数据上的性能(因为已经知道了训练数据对应的标签,显然不再需要模型来进行预测)。例如,模型最终可能只是记住了训练样本和目标值之间的映射关系,但这对在前所未见的数据上进行预测毫无用处。

与MNIST数据集一样,IMDB数据集也内置于Keras库。它已经过预处理:评论(单词序列)已经被转换为整数序列,其中每个整数代表字典中的某个单词。

二、加载IMDB数据集

from keras.datasets import imdb

(train_data, train_labels),(test_data, test_labels) = imdb.load_data(num_words=10000)

参数num_words=10000的意思是仅保留训练数据中前10000个最常出现的单词。低频单词将被舍弃。这样得到的向量数据不会太大,便于处理。

train_data和test_data这两个变量都是评论组成的列表,每条评论又是单词索引组成的列表,表示一系列的单词。train_labels和test_labels都是0和1组成的列表,其中 0 代表负面,1 代表正面。

print(train_data[0])

[1, 14, 22, 16, ... 178, 32]

由于限定为前10000个最常见的单词,单词索引都不会超过10000个。

将某条评论迅速解码为英文单词:

#将某条评论解码为英文单词

word_index = imdb.get_word_index()#word_index是一个将单词映射为整数索引的字典

reverse_word_index = dict([(value,key) for (key,value) in word_index.items()])

#键值颠倒,将整数索引映射为单词

decode_review = ' '.join(

[reverse_word_index.get(i-3, '?') for i in train_data[0]]

)#将评论解码,注意,索引减去了3,因为0,1,2是为padding填充,"start sequence"序列开始,"unknow"未知词分别保留的索引

#部分decode_review

decode_review

Out[88]: "? this film was just brilliant casting location scenery story direction everyone's really suited the part they played and you could just imagine being there robert ..."

二、准备数据

不能将整数序列直接输入神经网络。需要将列表转换为张量。转换方式有一下两种:

(1)填充列表,使其具有相同的长度,再将列表转换成形状为(samples, word_indices)的整数张量,然后网络第一层使用能处理这种整数张量的层(即Embedding层,以后写到关于Embedding层时再在这里放上链接)。

(2)对列表进行one-hot编码,将其转换为0和1组成的向量。举个例子,序列[3, 5]将会被转换为10000维向量,只有索引为3和5的元素是1,其余都是0。然后网络第一层可以用Dense层,它能够处理浮点数向量数据。

下面用第二种方法将数据向量化:

#将整数序列编码为二进制矩阵

import numpy as np

def vectorize_sequences(sequences, dimension=10000):

results = np.zeros((len(sequences),dimension))#创建一个形状为(len(sequences), dimension)的矩阵

for i, sequence in enumerate(sequences):

results[i, sequence] = 1#将results[i]的指定索引设为 1

return results

x_train = vectorize_sequences(train_data)

x_test = vectorize_sequences(test_data)

#标签向量化

y_train = np.asarray(train_labels).astype('float32')

y_test = np.asarray(test_labels).astype('float32')

结果查看:

print(x_train[0])

[0. 1. 1. ... 0. 0. 0.]

怎么来看这个结果呢?从print(train_data[0])

[1, 14, 22, 16, … 178, 32]我们可以看到有1,14,22等这些数字,那么在x_train[0]中,x_train[0][1]=1, x_train[0][14]=1, x_train[0][22] = 1,x_train[0][16] =1, … x_train[0][178]=1, x_train[0][32]=1。也就是假设train_data[0]中的数值为y,对应x_train[0][y]=1,其余的为0。

三、构建网络

输入数据是向量,而标签是标量(1和0)。有一类网络在这种问题上表现很好,就是带有relu激活的全连接层的简单堆叠。比如Dense(16, activation=‘relu’)。

传入Dense层的参数(16)是该层隐含单元的个数。一个隐藏单元是该层表示空间的一个维度。16个隐藏单元对应的权重矩阵W的形状为(input_dimension, 16)。隐藏单元越多(即更高维的表示空间),网络越能学到更加复杂的表示,但网络的计算代价也变得更大,而且可能会导致学到不好的模式(这种模式会提高训练数据上的性能,但不会提高测试数据上的性能)。

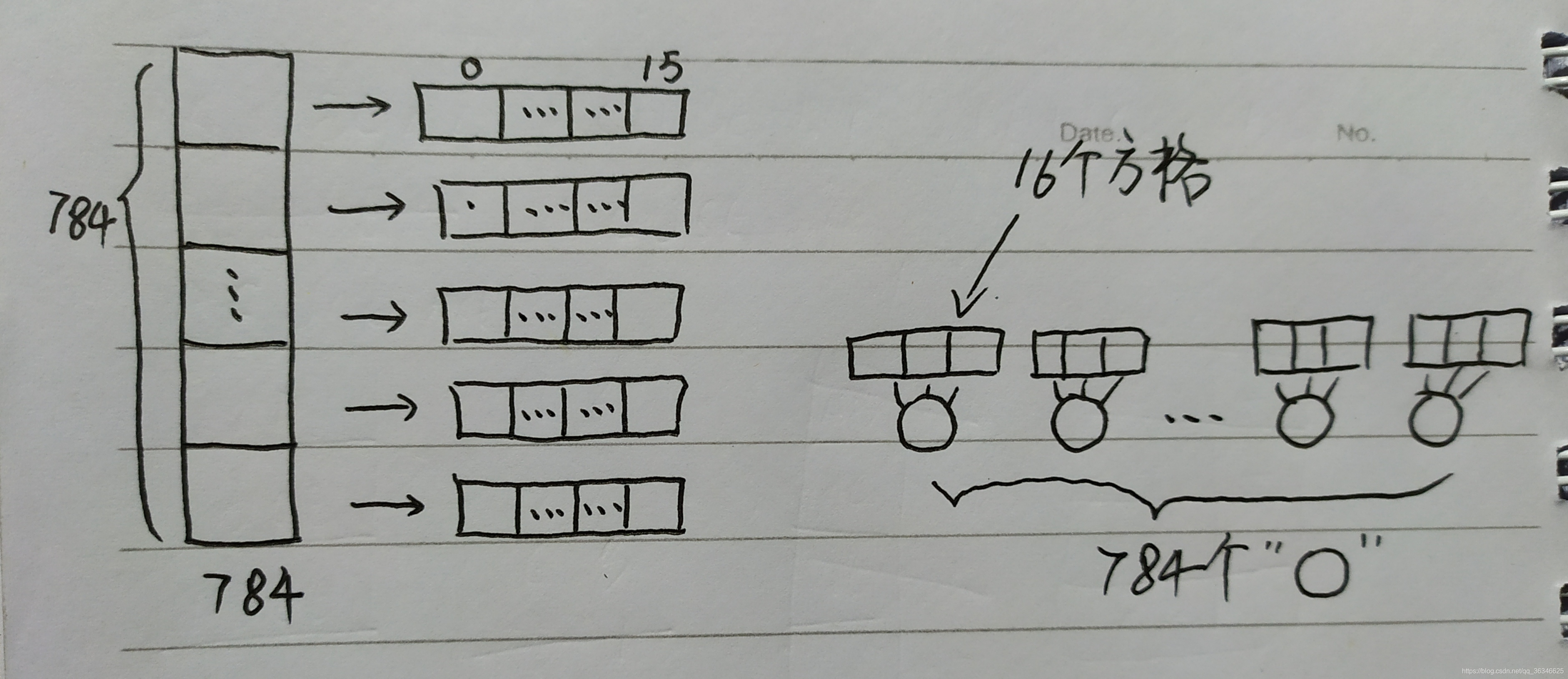

关于“16个隐藏单元对应的权重矩阵W的形状为(input_dimension, 16)”如何理解呢?可以看看下面这张图:

以MNIST数据集的输入大小为例,28×28=784,也就是有784个“O”,每个“O”都单独“应对”16个小方格,一个方格对应一个权重参数,所以“16个隐藏单元对应的权重矩阵W的形状为(input_dimension, 16)”。

对于这种Dense层的堆叠,需要确定以下两个关键架构:

(1)网络有多少层;

(2)每层有多少个隐藏单元。

下面搭建起来的网络模型的架构为:

(1)网路有两个中间层,每层都有16个隐藏单元;

(2)第三层输出一个标量,预测当前评论的情感。

模型定义:

from keras import models

from keras import layers

model = models.Sequential()

model.add(layers.Dense(16, activation='relu', input_shape=(10000,)))

model.add(layers.Dense(16, activation='relu'))

model.add(layers.Dense(1, activation='sigmoid'))

最后需要选择一个损失函数和优化器。面对二分类问题,网络的输出是一个概率值。网络最后一层使用sigmoid激活函数,仅包含一个单元,最好使用binary_crossentropy(二元交叉熵)损失。

但是这并不是唯一可行的选择,还可以使用mean_squared_error(均方误差)。但对于输出概率值的模型,交叉熵crossentropy往往是最好的选择。下面的步骤是用rmsprop优化器和binary_crossentropy损失函数来配置模型。注意,在训练过程中还要监控精度accuracy。

#编译模型

model.compile(optimizer='rmsprop',

loss = 'binary_crossentropy',

metrics=['accuracy'])

上述代码将优化器、损失函数好指标作为字符串输入,这是因为rmsprop、binary_crossentropy和accuracy都是Keras内置的一部分。有时候我们可能希望配置自定义优化器的参数,或者传入自定义的损失函数或指标函数。前者可以通过optimizer参数传入一个优化器类实例来实现;后者可通过向loss和metrics参数传入函数对象来实现。代码如下:

#配置优化器

from keras import optimizers

model.compile(optimizer= optimizers.RMSprop(lr=0.001),

loss = 'binary_crossentropy',

metrics=['accuracy'])

#使用自定义的损失和指标

from keras import optimizers

from keras import losses

from keras import metrics

model.compile(optimizer= optimizers.RMSprop(lr=0.001),

loss = losses.binary_crossentropy,

metrics = [metrics.binary_accuracy])

四、验证所设计的模型

为了在训练过程中监控模型在前所未见的数据上的精度,需要将原始训练数据流出10000个样本作为验证集。剩下15000作训练集。

#留出验证集

x_val = x_train[:10000]

partial_x_train = x_train[10000:]

y_val = y_train[:10000]

partial_y_train = y_train[10000:]

现在使用512个样本组成的小批量,将模型训练20个轮次(即对x_train和y_train两个张量中的所有样本进行20次迭代)。与此同时,还要监控在留出的10000个样本上的损失和精度。可以通过将验证数据传入validation_data参数来完成。

#训练模型

model.compile(optimizer='rmsprop',

loss = 'binary_crossentropy',

metrics=['accuracy'])

history = model.fit(partial_x_train,

partial_y_train,

epochs=20,

batch_size = 512,

validation_data = (x_val, y_val))#使用验证集监控模型

注意,调用model.fit()返回了一个History对象,这个对象有一个history成员,它是一个字典,包含训练过程中的所有数据。

history.history.keys()

Out[102]: dict_keys(['val_loss', 'val_binary_accuracy', 'loss', 'binary_accuracy'])

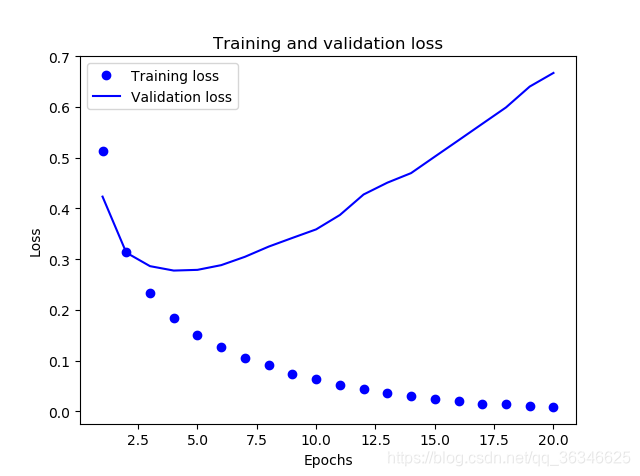

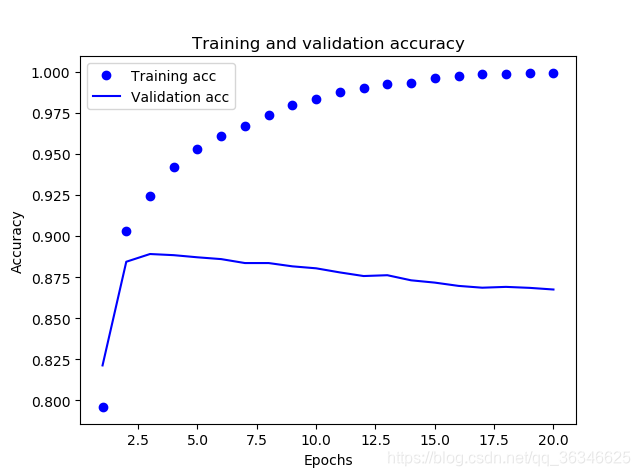

字典中包含4个条目,对应训练过程和验证过程中监控的指标。下面使用Matplotlib在同一张图上绘制训练损失和验证损失,以及训练精度和验证精度。

#绘制训练损失和验证损失

import matplotlib.pyplot as plt

history_dict = history.history

loss_values = history_dict['loss']

val_loss_values = history_dict['val_loss']

epochs = range(1,len(loss_values)+1)

plt.plot(epochs, loss_values, 'bo', label='Training loss')#'bo'表示蓝色圆点

plt.plot(epochs, val_loss_values, 'b', label='Validation loss')#'b'表示蓝色实线

plt.title('Training and validation loss')

plt.xlabel('Epochs')

plt.ylabel('Loss')

plt.legend()

plt.show()

绘制训练损失和验证损失:

绘制训练精度和验证精度:

plt.clf()#清空图像

acc = history_dict['accuracy']

val_acc = history_dict['val_accuracy']

plt.plot(epochs, acc, 'bo', label='Training acc')

plt.plot(epochs, val_acc, 'b', label='Validation acc')

plt.title('Training and validation accuracy')

plt.xlabel('Epochs')

plt.ylabel('Accuracy')

plt.legend()

plt.show()

如图所示,训练损失每轮都在下降,训练精度每轮都在提升。这就是梯度下降优化的预期结果-----想要最小化的量随着每次迭代越来越小。但验证损失和验证精度并非如此:它们似乎在第3或第4轮达到最佳值。

这就是之前警告过的一种情况:模型在训练数据上表现越来越好,但是在前所未见的数据上不一定表现得越来越好。准确地说,这就是过拟合:在第3或第4轮之后,模型对训练数据过度优化,最终学到的表示仅仅针对训练数据,无法泛化到训练集之外的数据。

在这种情况下,为了防止过拟合,可以在3轮之后停止训练。通常来说,可以使用许多方法来降低过拟合。

现在从头开始训练一个新的网络,训练4轮,然后在测试数据上评估模型。

#从头开始重新训练一个模型

model = models.Sequential()

model.add(layers.Dense(16, activation='relu', input_shape=(10000,)))

model.add(layers.Dense(16, activation='relu'))

model.add(layers.Dense(1, activation='sigmoid'))

model.compile(optimizer='rmsprop',

loss = 'binary_crossentropy',

metrics=['accuracy'])

model.fit(x_train, y_train, epochs=4, batch_size = 512)

results = model.evaluate(x_test, y_test)#在测试数据上评估模型

最终结果如下:

results

Out[9]: [0.3133043148469925, 0.876800000667572]

这种箱单简单的方法得到了87%的精度。利用更先进的方法,可以得到更高的精度(准确率)。

五、使用训练好的网络在新数据上生成预测结果

训练好网络之后,希望将模型用于实践,可以使用predict方法来得到评论为正面的可能性大小。

model.predict(x_test)

Out[10]:

array([[0.28486687],

[0.9995778 ],

[0.97062624],

...,

[0.17118531],

[0.08027949],

[0.7447252 ]], dtype=float32)

如结果输出所示,网络对某些样本的结果非常确信(大于等于0.99,或小于0.08),当概率处于0.4~0.6之间时,说明网络对样本的结果不太确信。

六、进一步实验

通过以下实验,可以确信,前面选择的网络架构是非常合理的,虽然仍有改进的空间。

(1)前面使用了两个隐藏层。可以尝试使用一个或三个隐藏层,然后观察对验证精度和测试精度的影响。

(2)尝试使用更多或更少的隐藏单元,比如32个、64个等。

(3)尝试使用mse损失函数代替binary_crossentropy。

(4)尝试使用tanh激活(这种激活在神经网络早期非常流行)代替relu。

七、小结

从例子中学到的要点:

(1)通常需要对原始数据进行大量预处理,以便将其转化为张亮输入到神经网络中。单词序列可以编码为二进制向量。但也有其他编码方式。

(2)带有relu激活的Dense层堆叠,可以解决很多种问题(包括情感分类)。

(3)对于二分类问题(两个输出类别),网络的最后一层应该是只有一个单元并使用sigmoid激活的Dense层,网络输出应该是0~1范围内的标量,表示概率值。

(4)对于二分类问题的sigmoid标量输出,应该使用binary_crossentropy损失函数。

(5)无论需要解决的问题是什么,rmsprop优化器通常都是足够好的选择。

(6)随着神经网络在训练数据上的表现越来越好,模型最终会过拟合,并在前所未有的数据上得到越来越差的结果。一定要一直监控模型在训练数据集之外的数据上的性能。

说明:本文摘抄自《Python深度学习》 [美]弗朗索瓦·肖莱 著 张亮 译。由于没有链接,所以文章标注为【原创】。在这个平台上发布这篇文章,一来,可以提供给需要的人作一些参考;二来,是为了自己查阅和回顾方便。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?