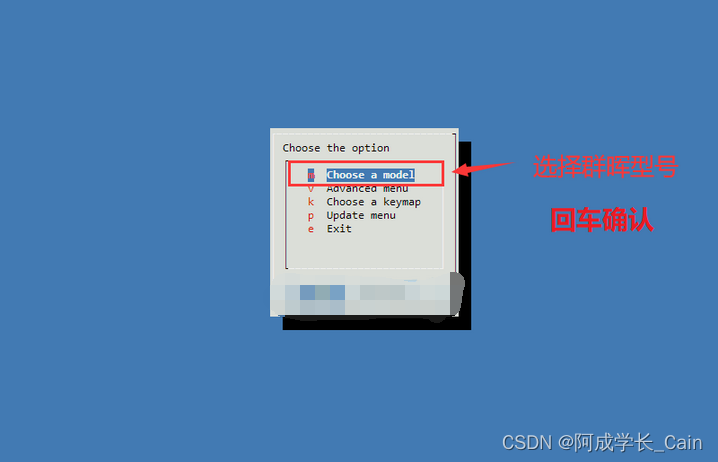

ARPL 是一款黑群晖系统引导在线编译工具,目前支持最新群晖系统DSM 7.1.1,今天为了折腾升级这个群晖系统DSM 7.1.1浪费了一天的时间,ARPL是巴西人一位大神开发的黑群晖系统引导在线编译工具,使用下来非常的不错,可惜没有简体中文操作界面,不过几个英文单词也难不倒我们,而且网上还有大把的教程,参考一下就可以完全掌握ARPL工具的使用方法,如果你实在不会的,阿成会在明天给大家做个图文教程。ARPL 黑群晖系统引导在线编译工具在GitHub上开源代码,非常的安全,非常的可靠。

ARPL 黑群晖系统引导在线编译工具项目地址 https://github.com/fbelavenuto/arpl

ARPL 黑群晖系统引导在线编译工具项目地址 https://github.com/fbelavenuto/arpl

中文版arpl编译系统github仓库地址:https://github.com/wjz304/arpl-zh_CN

中文版arpl编译系统下载地址:https://github.com/wjz304/arpl-zh_CN/releases

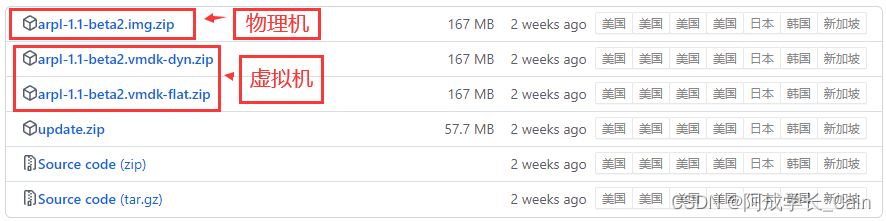

arpl-beta2.img.zip 是物理(实体)机使用的不要选择错了

arpl-beta2.vmdk-dyn.zip 虚拟机使用的不要选择错了

arpl-beta2.vmdk-flat.zip 虚拟机使用的不要选择错了

软件官方英文版:https://github.com/fbelavenuto/arpl/releases

软件官方英文版:https://github.com/fbelavenuto/arpl/releases

中文版arpl编译系统github仓库地址:https://github.com/wjz304/arpl-zh_CN

中文版arpl编译系统下载地址:https://github.com/wjz304/arpl-zh_CN/releases

百度网盘:https://pan.baidu.com/s/1aIpQDTEuJzYu9J5–lwQfw 提取码: hm3y

742

742

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?