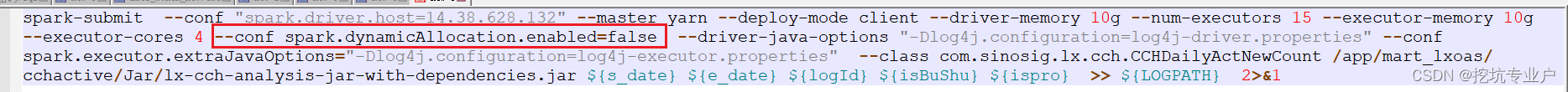

CDH环境中,默认开启了动态资源占用:spark.dynamicAllocation.enabled=true,在资源充足下,

num-executors,executor-cores 不会被限制住,造成executors数据一直增长,队列资源空闲资源被占满,导致其他任务无法运行。

可以通过 --conf spark.dynamicAllocation.maxExecutors=100 限制动态资源申请的最大核数;或者--conf spark.dynamicAllocation.enabled=false 关闭动态资源分配以解决该问题。

869

869

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?