深度学习大牛吴恩达曾经说过:做 AI 研究就像造宇宙飞船,除了充足的燃料之外,强劲的引擎也是必不可少的。假如燃料不足,则飞船就无法进入预定轨道。而引擎不够强劲,飞船甚至不能升空。类比于 AI,深度学习模型就好像引擎,海量的训练数据就好像燃料,这两者对于 AI 而言同样缺一不可。

随着深度学习技术在机器翻译、策略游戏和自动驾驶等领域的广泛应用和流行,阻碍该技术进一步推广的一个普遍性难题也日渐凸显:训练模型所必须的海量数据难以获取。

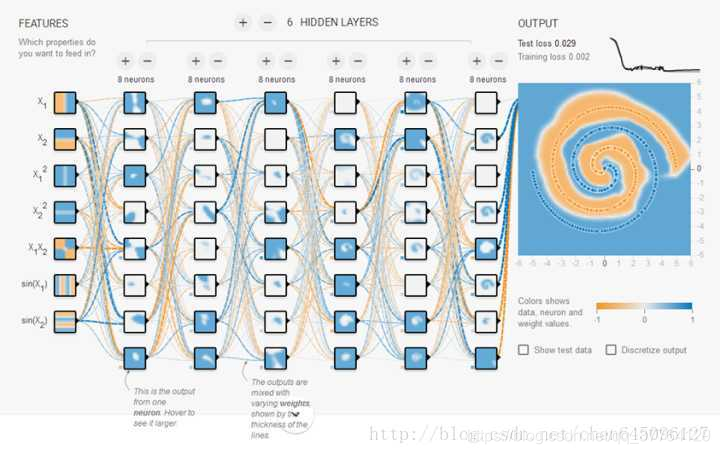

以下是一些当前比较流行的机器学习模型和其所需的数据量,可以看到,随着模型复杂度的提高,其参数个数和所需的数据量也是惊人的。

在深度学习中,当数据量不够大时候,常常采用下面5中方法:

1. 人工增加训练集的大小.

通过平移, 翻转, 加噪声等方法从已有数据中创造出一批"新"的数据.也就是Data Augmentation(数据扩充)

这是解决过拟合最有效的方法,只要给足够多的数据,让模型「看见」尽可能多的「例外情况」,它就会不断修正自己,从而得到更好的结果:

如何获取更多数据,可以有以下几个方法:

从数据源头获取更多数据:这个是容易想到的,例如物体分类,我就再多拍几张照片好了;但是,在很多情况下,大幅增加数据本身就不容易;另外,我们不清楚获取多少数据才算够;

根据当前数据集估计数据分布参数,使用该分布产生更多数据:这个一般不用,因为估计分布参数的过程也会代入抽样误差。

数据增强(Data Augmentation):通过一定规则扩充数据。如在物体分类问题里,物体在图像中的位置、姿态、尺度,整体图片明暗度等都不会影响分类结果。我们就可以通过图像平移、翻转、缩放、切割等手段将数据库成倍扩充;

不同的任务背景下, 我们可以通过图像的几何变换, 使用以下一种或多种组合数据增强变换来增加输入数据的量. 这里具体的方法都来自数字图像处理的内容, 相关的知识点介绍, 网上都有, 就不一一介绍了.

- 旋转 | 反射变换(Rotation/reflection):

在深度学习中,当数据量有限时,常用方法包括数据增强、正则化、dropout、无监督预训练和模型剪枝。数据增强通过几何变换等方式扩充训练集,正则化通过L2范数抑制过拟合,dropout随机关闭神经元以提高泛化能力,无监督预训练利用自编码器等进行预训练,模型剪枝减少网络冗余。早期停止策略可在验证集精度不再提升时终止训练,防止过拟合。

在深度学习中,当数据量有限时,常用方法包括数据增强、正则化、dropout、无监督预训练和模型剪枝。数据增强通过几何变换等方式扩充训练集,正则化通过L2范数抑制过拟合,dropout随机关闭神经元以提高泛化能力,无监督预训练利用自编码器等进行预训练,模型剪枝减少网络冗余。早期停止策略可在验证集精度不再提升时终止训练,防止过拟合。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?