一、LangChain4J 介绍

LangChain4j 是一个专为 Java 开发者设计的开源框架,旨在简化大型语言模型(LLMs)与 Java 应用程序的集成。其核心目标是降低开发者在构建智能应用时的复杂度,特别是那些需要与 LLMs 交互的应用,如聊天机器人、智能助手和文档检索系统等。

方法如下:

-

统一 API

LangChain4j 提供了一个标准化的 API,支持多种 LLM 提供商(如 OpenAI、Google Vertex AI、ZhiPu、Qianfan 等)和向量存储(如 Pinecone、Milvus 等)。通过统一的 API,开发者可以轻松切换不同的 LLM 或嵌入存储。目前,LangChain4j 支持超过 15 个主流的 LLM 提供商和 20 多个嵌入存储。 -

综合工具箱

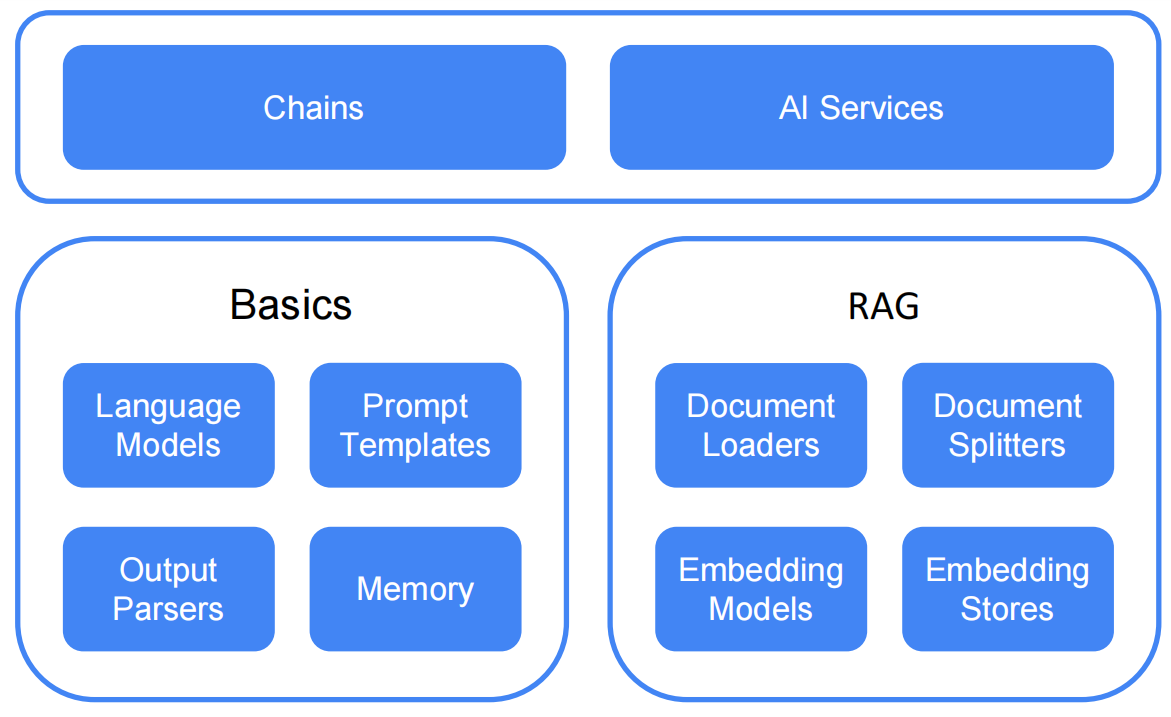

LangChain4j 集成了丰富的工具和功能,涵盖了从低级的提示模板、聊天记忆管理到高级的 AI 服务和 RAG(检索增强生成)模式。这些工具基于社区的最佳实践,帮助开发者快速构建复杂的 LLM 应用。例如:-

提示模板:支持动态生成提示词,优化与 LLM 的交互。

-

聊天记忆管理:通过

ChatMemory组件实现多轮对话的上下文记忆。 -

RAG 管道:支持从数据摄取到检索的完整流程,包括文档加载、分割、嵌入和向量存储。

-

-

社区驱动与创新

LangChain4j 融合了 LangChain、Haystack、LlamaIndex 等框架的理念,并结合了社区的创新。其活跃的社区持续推动新技术的整合,确保开发者能够使用最新的 LLM 技术。

二、LangChain4J 的两种抽象级别

LangChain4j 提供了两种抽象级别,以满足不同开发需求:

-

低级别(Low Level)

在低级别抽象中,开发者可以完全控制 LLM 应用的各个组件,例如:-

ChatLanguageModel:用于与 LLM 进行交互。

-

UserMessage 和 AiMessage:分别表示用户输入和 LLM 的输出。

-

EmbeddingStore 和 Embedding:用于向量存储和检索。

这种模式适合需要高度定制化的场景,但需要开发者编写更多的代码。

-

-

高级别(High Level)

高级别抽象通过封装复杂的底层逻辑,提供了更简洁的开发体验。例如:-

AI 服务(AiServices):通过声明式 API 与 LLM 交互,减少了样板代码。

-

RAG 管道:通过高级 API 实现文档检索和生成,简化了复杂流程。

这种模式适合快速开发和原型设计,同时仍支持灵活的微调。

-

三、LangChain4J 的核心功能扩展

-

多模态支持

LangChain4j 不仅支持文本输入,还支持图像输入,适用于多模态应用场景。例如,开发者可以构建能够处理文本和图像的智能助手。 -

动态工具调用

支持动态生成和执行 LLM 代码,适用于需要实时生成逻辑的应用场景。 -

与 Spring Boot 和 Quarkus 集成

LangChain4j 提供了与 Spring Boot 和 Quarkus 的无缝集成,方便 Java 开发者将其嵌入到现有的企业级应用中。 -

文档处理与检索

LangChain4j 支持从多种来源(如文件系统、URL、GitHub 等)加载文档,并提供多种分割算法(如按段落、句子、字符等)将文档切分为更小的片段。这些片段可以被嵌入并存储在向量数据库中,用于高效的相似性检索。 -

Token 管理与优化

LangChain4j 提供了 Token 切分和计数工具,帮助开发者优化与 LLM 的交互,避免因输入过长导致的性能问题。

四、LangChain4J 的应用场景

-

智能客服

通过集成聊天记忆和 RAG 技术,构建能够理解上下文并提供精准回答的客服系统。 -

文档检索与问答

利用 RAG 管道,从大量文档中检索相关信息并生成准确的答案,适用于企业内部知识库系统。 -

内容生成

通过提示模板和动态工具调用,生成定制化的内容,如博客文章、电子邮件等。

五、总结

LangChain4j 是一个功能强大且灵活的框架,为 Java 开发者提供了与 LLM 集成的全面解决方案。无论是低级别的定制化开发,还是高级别的快速原型设计,LangChain4j 都能满足需求。其丰富的工具箱、多模态支持和活跃的社区使其成为构建智能应用的理想选择。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?