一、问题背景:

- hive内部分区表

hive中,表分为内部表(管理表)和外部表(托管表)

对于外部表,在创建的时候,需要加上EXTERNAL关键字

不使用EXTERNAL关键字创建的表为内部表

DROP TABLE IF EXISTS O_EBS${db_para}.XXAPEX_XXSRM_0506_LOG_L_HIS;

CREATE TABLE IF NOT EXISTS O_EBS${db_para}.XXAPEX_XXSRM_0506_LOG_L_HIS(

HEADER_ID STRING COMMENT ''

...

)

partitioned by(PART_DT STRING)

row format delimited fields terminated by '\036'

stored as orcfile;

很明显,这次创建的就是内部表,还是分区表,并且以ORC格式存储

- 修改表结构(新增字段)

ALTER TABLE O_EBS${db_para}.XXAPEX_XXSRM_0506_LOG_L_HIS ADD COLUMNS(

JIT_FLAG STRING COMMENT '是否JIT'

,MONDAY_SCHEDULE_DATE STRING COMMENT '周一齐套日期'

...

)cascade;

-- 分区表新增列的时候:需要加上级联cascade,否则旧分区中新增的列将会为空并且无法更新

-- 即便insert overwrite整个分区也不会生效...

-- cascade的中文翻译为“级联”,也就是不仅变更新分区的表结构(metadata),同时也变更旧分区的表结构

- 重跑数据(执行也成功了)

二、问题描述

select

part_dt,count(1)

from o_ebs${db_para}.XXAPEX_XXSRM_0506_LOG_L_HIS t1

where datediff('${bizDate}',t1.part_dt) < 366

and coalesce(t1.source,'') = '工单'

and coalesce(t1.JIT_FLAG,'N') <> 'Y'

group by part_dt

order by part_dt

在hive中执行上述SQL,报错:如下

Error: java.lang.RuntimeException: org.apache.hadoop.hive.ql.metadata.HiveException: Hive Runtime Error while processing row at org.apache.hadoop.hive.ql.exec.mr.ExecMapper.map(ExecMapper.java:179) at org.apache.hadoop.mapred.MapRunner.run(MapRunner.java:54) at

org.apache.hadoop.mapred.MapTask.runOldMapper(MapTask.java:459) at org.apache.hadoop.mapred.MapTask.run(MapTask.java:343) at org.apache.hadoop.mapred.YarnChild$2.run(YarnChild.java:164) at java.security.AccessController.doPrivileged(Native Method) at

javax.security.auth.Subject.doAs(Subject.java:422) at

org.apache.hadoop.security.UserGroupInformation.doAs(UserGroupInformation.java:1924) at org.apache.hadoop.mapred.YarnChild.main(YarnChild.java:158)

Caused by: org.apache.hadoop.hive.ql.metadata.HiveException: Hive Runtime Error while processing row at org.apache.hadoop.hive.ql.exec.vector.VectorMapOperator.process(VectorMapOperator.java:52)

at org.apache.hadoop.hive.ql.exec.mr.ExecMapper.map(ExecMapper.java:170) ... 8 more

Caused by: java.lang.NullPointerException at java.lang.System.arraycopy(Native Method) at org.apache.hadoop.hive.ql.exec.vector.BytesColumnVector.setVal(BytesColumnVector.java:151) at

org.apache.hadoop.hive.ql.exec.vector.BytesColumnVector.setElement(BytesColumnVector.java:317) at org.apache.hadoop.hive.ql.exec.vector.expressions.VectorCoalesce.evaluate(VectorCoalesce.java:78) at

org.apache.hadoop.hive.ql.exec.vector.expressions.VectorExpression.evaluateChildren(VectorExpress

ion.java:118) at org.apache.hadoop.hive.ql.exec.vector.expressions.gen.FilterStringGroupColNotEqualStringGroupScal

arBase.evaluate(FilterStringGroupColNotEqualStringGroupScalarBase.java:40) at org.apache.hadoop.hive.ql.exec.vector.expressions.FilterExprAndExpr.evaluate(FilterExprAndExpr.ja

va:38) at org.apache.hadoop.hive.ql.exec.vector.VectorFilterOperator.processOp(VectorFilterOperator.java:100) at org.apache.hadoop.hive.ql.exec.Operator.forward(Operator.java:815) at

org.apache.hadoop.hive.ql.exec.TableScanOperator.processOp(TableScanOperator.java:98) at org.apache.hadoop.hive.ql.exec.MapOperator$MapOpCtx.forward(MapOperator.java:157) at

org.apache.hadoop.hive.ql.exec.vector.VectorMapOperator.process(VectorMapOperator.java:45) ... 9 more

三、解决问题

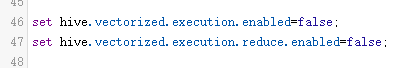

禁止设置矢量查询

set hive.vectorized.execution.enabled=false;

set hive.vectorized.execution.reduce.enabled=false;

在执行的代码前加上这两个参数设置,再重跑就成功啦~~

四、补充

矢量查询(Vectorized query) 每次处理数据时会将1024行数据组成一个batch进行处理,而不是一行一行进行处理,这样能够显著提高执行速度。

向量化查询执行是 Hive 的一项功能,可大大减少典型查询操作(如扫描,过滤器,聚合和联接)的 CPU 使用率。标准查询执行系统一次处理一行。这在执行的内部循环中涉及长代码路径和重要的元数据解释。向量化查询执行通过一次处理一个 1024 行的块来简化操作。在该块内,每一列都存储为向量(原始数据类型的数组)。诸如算术和比较之类的简单操作是通过在一个紧密的循环中快速迭代向量而完成的,循环内没有或只有很少的函数调用或条件分支。通过有效地使用处理器管道和高速缓存,这些循环以精简的方式进行编译,该方式使用相对较少的指令,并平均在较少的时钟周期内完成每条指令。

-- 要使用向量化查询执行,必须以ORC格式存储数据

set hive.vectorized.execution.enabled = true;

-- 默认情况下,矢量化执行是关闭的;禁用向量化执行命令:

set hive.vectorized.execution.enabled = false;

4089

4089

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?