深度学习入门-基于Python的理论入门与实现源代码加mnist数据集下载推荐

书籍封面

1-图灵网站下载

书里也说了,可以图灵网站下载https://www.ituring.com.cn/book/1921

不过这个没有带mnist数据集,而根据源程序下载mnist数据集经常断流,因为是从国外服务器下载的

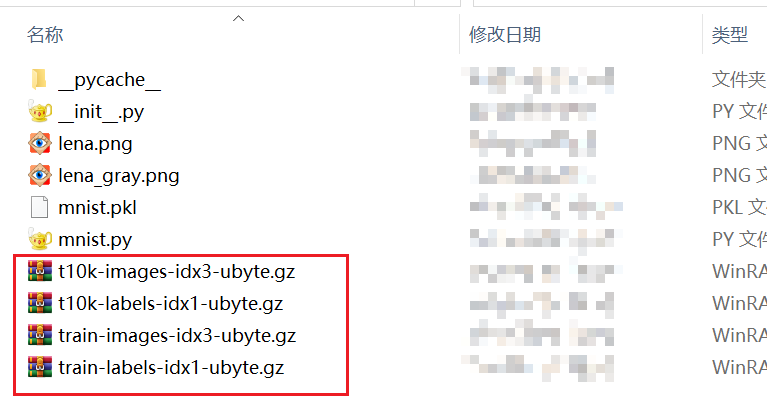

2.源代码分享,带mnist数据集

源代码也是从图灵下载的,只不过加上mnist数据集而已

下载链接

更新https://wwa.lanzoui.com/iyBrHhp5lgj

https://wwe.lanzous.com/iyBrHhp5lgj

百度网盘链接:https://pan.baidu.com/s/1ip38bQKbsKXVozv7uKVmkA

提取码:or7w

。

。

。

这是一篇关于深度学习入门的博客,特别针对使用Python的初学者。书中提供了理论入门和实现源代码,并推荐了两个下载源。第一个是图灵网站,但不包含MNIST数据集,而第二个来源则提供了带有MNIST数据集的源代码,包括百度网盘和兰舟网盘的下载链接。由于直接从国外服务器下载MNIST数据集可能不稳定,这些链接提供了一种更稳定的获取途径。

这是一篇关于深度学习入门的博客,特别针对使用Python的初学者。书中提供了理论入门和实现源代码,并推荐了两个下载源。第一个是图灵网站,但不包含MNIST数据集,而第二个来源则提供了带有MNIST数据集的源代码,包括百度网盘和兰舟网盘的下载链接。由于直接从国外服务器下载MNIST数据集可能不稳定,这些链接提供了一种更稳定的获取途径。

903

903

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?