链路聚合

指将多个物理端口汇聚在一起,形成一个逻辑端口,以实现出/入流量吞吐量在各成员端口的负荷分担,交换机根据用户配置的端口负荷分担策略决定网络封包从哪个成员端口发送到对端的交换机。当交换机检测到其中一个成员端口的链路发生故障时,就停止在此端口上发送封包,并根据负荷分担策略在剩下的链路中重新计算报文的发送端口,故障端口恢复后再次担任收发端口。

通俗的讲:这种模式即可以增加流量的访问提高网速,又可以在一块网卡坏掉之后可以正常工作

实验前提:双网卡设备

bond模式

1.删除网络配置

nmcli connection delete eth0 #eth0为设备名称

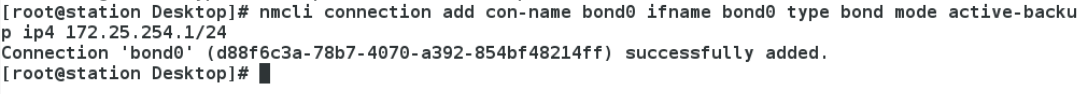

2.创建链路聚合

nmcli connection add con-name bond0 ifname bond0 type bond mode active-backup ip4 172.25.254.1/24 #active-backup 为主动备份模式

添加工作设备

将两个网卡eth0 eht1都加到这个bond链路上

nmcli connection add con-name eth0 ifname eth0 type bond-slave master bond0

nmcli connection add con-name eth1 ifname eth1 type bond-slave master bond0

然后

nmcli connection show

可以看到设备都已经添加成功

我们也可以设一个监控来观察bond配置过程

watch -n 1 cat /proc/net/bonding/bond0 #监控bond0状态

测试

关闭eth0网卡,我们可以看到,bond0的工作网卡从eth0切换到了eth1

再次开启eth0时,工作网卡依旧为eth1,只有关闭eth1时才切换回eht0

ifconfig eth0 down

ifconfig eth1 up

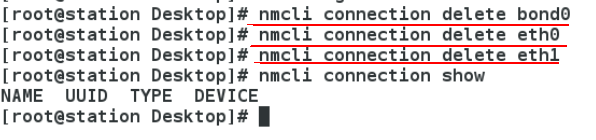

删除bond接口

nmcli connection delete bond0

nmcli connection delete eth0

nmcli connection delete eth1

team模式

服务器和客户机,特别是服务器单线路接入网络时,存在以下单点故障:

1.接入物理设备(通常是交换机)宕机;

2.接入设备的网口损坏;

3.使用的网线损坏;

4.服务器/客户机的网卡故障。

解决这种单点故障只能使用服务器网卡组(team)技术。

与bond模式相似,但是bond模式下只可以支持2块网卡,而team模式下可以支持8块

删除所有网络配置

使用终端打开网络配置界面再一一删除

nm-connection-editor

监控team

watch -n 1 teamdctl team0 stat #监控team0的工作状态

创建team接口

nmcli connection add con-name team0 ifname team0 type team config '{"runner":{"name":"activebackup"}}' ip4 172.25.254.1/24

在这里插入图片描述

添加工作设备

nmcli connection add con-name eth0 ifname eth0 type team-slave master team0

nmcli connection add con-name eth1 ifname eth1 type team-slave master team0

测试

关闭eth0以后发现eth1开始顶替工作,再次开启eth0 ,还是eth1开始工作

ifconfig eth0 down

ifconfig eth0 up

删除team接口

删除tam接口与删除bond接口操作一样

567

567

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?