机器学习与数据挖掘

文章平均质量分 76

分享干货与心得,内容由浅入深,通俗易懂

图灵的猫.

给行业以ai,而不是给ai以行业

展开

-

别怕,“卷积“其实很简单

首先给大家讲一个关于卷积的小故事:小明是杭州某互联网大厂的员工,每天996十分辛苦,但小明最近爱上了打台球,经常不在工位。这天,小明的主管让小明改一个需求,小明却到楼下找产品部小丽打台球去了,被主管发现,他非常气愤,扇了小明一巴掌(注意,这就是输入信号,脉冲)。于是小明脸上会渐渐地(贱贱地)鼓起来一个包,小明的脸就是一个系统,而鼓起来的包就是小明的脸对巴掌的响应。好,这样就和信号系统建立起来意义对应的联系。原创 2018-01-17 13:15:52 · 210507 阅读 · 32 评论 -

「11」Python实战篇:利用KNN进行电影分类

上一期文章:「10」民主投票法——KNN的秘密中,我们剖析了KNN算法的本质和特点、局限。这里我们用python代码进行KNN的实现。第1部分是KNN的基础算法步骤,第2部分是一个电影分类的实战项目。OK, let's begin~KNN算法实现 1 #!/usr/bin/env python 2 # -*- coding:utf-8 -*- 4 import csv ...原创 2020-02-14 21:06:17 · 6587 阅读 · 2 评论 -

「15」支持向量机Python实战篇——蓝瘦香菇到底有没有毒?

我们通过SVM的数学原理讲解了这个最常见的机器学习算法。这一篇我们用一个非常简单的python实战项目来练习一下SVM并加深理解。原创 2020-05-24 11:27:51 · 3602 阅读 · 1 评论 -

「14」支持向量机——我话说完,谁支持?谁反对?

1. 支持向量1.1 线性可分首先我们先来了解下什么是线性可分。在二维空间上,两类点被一条直线完全分开叫做线性可分。严格的数学定义是:1.2 最大间隔超平面从二维扩展到多维空间中时,将 d0 和 d1 完全正确地划分开的 y = wx + b 就成了一个超平面。为了使这个超平面更具鲁棒性,我们会去找最佳超平面,以最大间隔把两类样本分开的超平面,也称之为最大间隔超平面。两类样本分别分割在该超平面的两侧; 两侧距离超平面最近的样本点到超平面的距离被最大化了。..原创 2020-05-24 11:21:56 · 2924 阅读 · 0 评论 -

「13」朴素贝叶斯Python实战:计算打喷嚏的工人患病的概率

上一期文章:「12」你们啊,naive!——朴素贝叶斯谈笑录中,我们剖析了朴素贝叶斯算法的本质和特点以及贝叶斯学派的一些知识。这里我们用python代码进行Naive Bayes算的的实现。第1部分是计算打喷嚏的建筑工人患上新冠肺炎的概率,第2部分是上一期文章中提到的西瓜分类实战项目。实战项目一、计算打喷嚏的建筑工人患上新冠肺炎的概率有多大?class NBClassif...原创 2020-02-28 14:58:04 · 3707 阅读 · 2 评论 -

「10」民主投票法——KNN的秘密

KNN,全称是K-Nearest Neighbor,也就是最近邻算法。这个算法虽然没有雅典制度那么历史悠久,但也比我们想象的要古老。Cover 和 Hart 早在 1968 年就提出了最初的邻近算法,用于解决分类的问题。我们在前几期提到了分类问题的本质,大家可以回忆一下当作复习。它是所有机器学习分类算法中最简单的方法之一,如果你已经回忆了前几期的文章,那么一定会反应过来,它同时也可以被用来做回归算法。所谓K最近邻,就是k个最近的邻居的意思,说的是每个样本都可以用它最接近的k个邻居来代表。...原创 2020-02-14 21:04:45 · 2362 阅读 · 0 评论 -

「09」真损啊!——损失函数与极大似然估计

前言上期文章:「07」回归的诱惑:深入浅出逻辑回归中 ,我们介绍了逻辑回归的原理,组成和优缺点,并探讨了分类的本质含义。在这一期,我们会继续07的部分,从逻辑回归开始,引出机器学习中最重要的概念——参数学习。还记得我们的线性回归是如何学习直线方程参数的吗?最小二乘法(多元情况下叫做正规方程) 梯度下降法关于梯度下降,在之后的优化方法综述中会详细讲述,这里我们聚焦参数学习的本质—...原创 2020-02-01 17:02:19 · 4542 阅读 · 0 评论 -

「08」回归的诱惑:深入浅出逻辑回归(Python实战篇)

在上一篇文章「07」回归的诱惑:深入浅出逻辑回归里,我们详细解释了什么是分类算法以及逻辑回归、逻辑回归的特点,这一期给出实战案例的Python代码,供大家参考第一步 导入数据from collections import OrderedDictimport pandas as pd#数据集examDict={ '学习时间':[0.50,0.75,1.00,1.25...原创 2020-01-21 18:17:49 · 2031 阅读 · 0 评论 -

「07」回归的诱惑:深入浅出逻辑回归

前言上期文章:「05」回归的诱惑:一文读懂线性回归中 ,我们介绍了线性回归的原理,组成和优缺点,并探讨了回归的本质含义。在这一期,我们将从回归开始,引出一个机器学习中最重要的任务——分类。还记得我们上一节的课后题吗?其实答案很简单,任意一条线都可以把任意的数据点分为不同的类,也就是有无数个直线方程存在,这种解并没有意义。这就引出了我们的主题——分类。对于分类问题来说,不同的数据必须分为...原创 2020-01-21 18:14:11 · 2294 阅读 · 0 评论 -

「06」回归的诱惑:一文读懂线性回归(Python实战篇)

在上一篇文章「05」回归的诱惑:一文读懂线性回归里,我们详细解释了什么是线性回归,以及线性回归的特点,这一期给出实战案例的Python代码,供大家参考回归实战第一步 导入数据from collections import OrderedDictimport pandas as pd#数据集examDict={ '学习时间':[0.50,0.75,1.00,1....原创 2020-01-19 20:19:36 · 2300 阅读 · 0 评论 -

「05」回归的诱惑:一文读懂线性回归

前言从这一篇文章开始,就正式进入「美团」算法工程师带你入门机器学习系列的正文了,之前的几篇算是导读和预热,想必大家看的并不过瘾。从这里开始,我们将会以线性回归为起点,贯通回归方法在机器学习算法中所扮演的角色、具有的功能和使用的方法。说起回归,它是我们在高中时就接触过的内容。具体的,回归(Regression)是指研究一组随机变量(Y1 ,Y2 ,…,Yi)和另一组随机变量(X1,X2,…,......原创 2020-01-19 20:18:15 · 2510 阅读 · 1 评论 -

「04」机器学习、深度学习需要哪些数学知识?

入门避坑指南自学三年,基本无人带路,转专业的我自然是难上加难,踩过无数坑,走过很多弯路。这里我整理了一下自己踩过的坑,供大家参考。1. 不要从头开始学数学如果不是一点数学都不会,你没有必要从零学起。用上个把月,把微积分、线性代数、以及概率统计复习一遍就够了。我自己因为没有学过高数,所以花了半年时间,甚至读了数学分析、泛函分析和测度论这样的教材。现在回想起来,其实学到的大部分知识并没有在后...原创 2020-01-08 22:47:27 · 6116 阅读 · 3 评论 -

机器学习入门到进阶十本好书推荐

机器学习作为近期人工智能领域的热点话题一直被广大知乎讨论,我也一直收到很多私信咨询有哪些好的书籍适合自己进行阅读学习。机器学习专业出版社:异步社区,为大家带来十本经典机器学习相关书籍,分别适合入门、进阶到精深的三个不同阶段同学阅读,并且每本书籍都由异步社区机器学习相关编辑同学标注了适合阅读人群:Python高性能编程Python高性能编程-图书 - 异步社区本书适合初级和中...转载 2020-01-03 13:39:38 · 4281 阅读 · 1 评论 -

距离,范数与相似度

在数据分析和数据挖掘的过程中,我们经常需要知道个体间差异的大小,进而评价个体的相似性和类别。最常见的是数据分析中的相关分析,数据挖掘中的分类和聚类算法,如K最近邻(KNN)和K均值(K-Means)。当然衡量个体差异的方法有很多,最近查阅了相关的资料,这里整理罗列下。为了方便下面的解释和举例,先设定我们要比较X个体和Y个体间的差异,它们都包含了N个维的特征,即X=(x1, x2, x3, … xn...原创 2018-02-14 20:04:04 · 2450 阅读 · 0 评论 -

优化算法中的鞍点与梯度下降

摘要:本文将讨论寻找凸路径( convex path )时可能会遇到的不同类型的临界点( critical points),特别是基于梯度下降的简单启发式学习方法,在很多情形下会使你在多项式时间内陷入局部最小值( local minimum ) 。凸函数比较简单——它们通常只有一个局部最小值。非凸函数则更加复杂。在这篇文章中,我们将讨论不同类型的临界点( critical points)翻译 2017-12-25 19:44:10 · 12001 阅读 · 1 评论 -

机器学习中的VC维数和分类

VC维数学习VC维要先知道的概念有:增长函数(growth function)、对分(dichotomy)、打散(shattering)和断点(break point)1.增长函数增长函数表示假设空间H对m个示例所能赋予标记的最大可能结果数。比如说现在数据集有两个数据点,考虑一种二分类的情况,可以将其分类成A或者B,则可能的值有:AA、AB、BA和BB,原创 2017-12-22 23:23:20 · 6729 阅读 · 1 评论 -

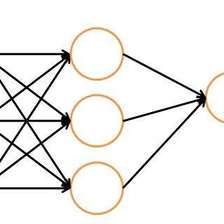

深入浅出BP神经网络(反向传播算法)

反向传播算法(Backpropagation)是目前用来训练人工神经网络(Artificial Neural Network,ANN)的最常用且最有效的算法。其主要思想是:(1)将训练集数据输入到ANN的输入层,经过隐藏层,最后达到输出层并输出结果,这是ANN的前向传播过程;(2)由于ANN的输出结果与实际结果有误差,则计算估计值与实际值之间的误差,并将该误差从输出层向隐藏层反向传转载 2018-01-10 20:01:13 · 2111 阅读 · 1 评论

分享

分享