第一周-数学基础的学习大纲

1. 矩阵对角化,SVD分解以及应用

2. 逆矩阵,伪逆矩阵

3. PCA原理与推导

4. 极大似然估计,误差的高斯分布与最小二乘估计的等价性

5. 最优化,无约束,有约束,拉格朗日乘子的意义,KKT条件

课程2 逆矩阵,伪逆矩阵,最小二乘解,最小范数解;PCA原理与推导

1. 逆矩阵,伪逆矩阵,最小二乘解,最小范数解

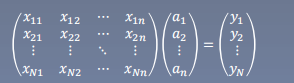

𝑥1, 𝑥2, ⋯ , 𝑥𝑁, 𝑥𝑖 ∈ ℝ𝑛

𝑦1, 𝑦2, ⋯ , 𝑦𝑁, 𝑦𝑖 ∈ ℝ1

𝑦1 = 𝑥11𝑎1 + 𝑥12𝑎2 + ⋯ + 𝑥1𝑛𝑎𝑛

𝑦2 = 𝑥21𝑎1 + 𝑥22𝑎2 + ⋯ + 𝑥2𝑛𝑎𝑛

⋮

𝑦𝑁 = 𝑥𝑁1𝑎1 + 𝑥𝑁2𝑎2 + ⋯ + 𝑥𝑁𝑛𝑎𝑛

𝑋𝑁×𝑛𝑎𝑛×1 = 𝑌𝑁×1

当𝑁 = 𝑛且𝑋𝑁×𝑛可逆时:

𝑎 = 𝑋−1𝑌s

一般情况:𝑁 ≠ n

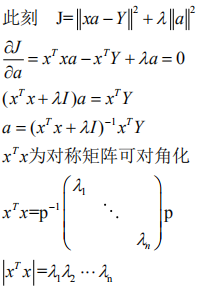

设min||X𝑎 − 𝑌||2 = 𝐽

则对矩阵求导可得,𝜕𝐽/𝜕𝑎= X𝑇(X𝑎 − 𝑌) = 0

X𝑇X𝑎 = X𝑇𝑌 X𝑇X是否可逆?

补充:矩阵可逆的条件:

R(A)=n,即若矩阵满秩则矩阵可逆

秩的定义:矩阵中所有行向量中极大线性无关组的元素个数。

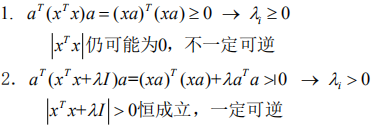

1. N > n

如 𝑁 = 5, 𝑛 = 3 (X𝑇X)3×3一般是可逆的

补充: R(AB)<<R(A)或R(B)

则 𝑎 = (X𝑇X)(−1)X𝑇𝑌

此时(X𝑇X)(−1)X𝑇𝑌即为伪逆矩阵

2. 𝑁 < 𝑛

如 𝑁 = 3, 𝑛 = 5 (X𝑇X)5×5

𝑅(X𝑇X) ≤ 𝑅(X) ≤ 3

故X𝑇X不可逆

此时就需要加上正则项得,

这里所求的解便是最小范数解

2. PCA原理与推导

PCA仍然是一种数据压缩的算法

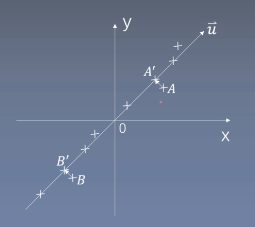

如图所示,A点需要x,y两个坐标来表示,假设A在向量u上面的投影点为A’,则A’仅仅需要一个参数就能表示,就是OA’的长度(即A’在u上的坐标),我们就想着用A’来替换A,这样N个点(原来要2*N个参数),现在只需要(N+2)个参数(u也需要2 个参数)

但是此时就带来了误差,如AA’和BB’,所以我们要能够找到这样一个方向u,使得所有原始点与投影点之间的误差最小。

后续将继续更新课程内容. . . .

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?