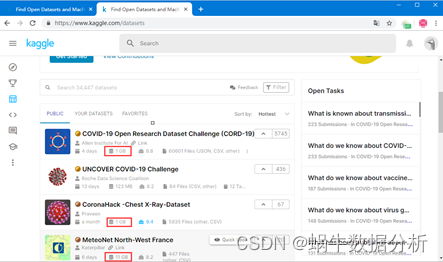

数据分析过程中,有时候接触的数据集会非常大。例如,打算在Kaggle(Kaggle是一个数据建模和数据分析竞赛平台。)竞赛平台上寻找一些数据集来练习,但是发现部分数据集是几G甚至几十G的,如图1所示。

针对这种大型数据集如果直接读取可能会造成运行失败或者直接导致系统瘫痪。本实例将使用Pandas对大型数据集进行分批读取,同时介绍几种常用方法供读者学习参考。

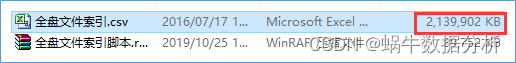

例如,笔者从数据库中导出的CSV文件有2G多,如图2所示。

分批导入后运行效果如图3和图4所示。由于数据量非常大且篇幅有限,这里仅展示部分数据。从输出结果得知:数据每100万行输出一次。

订阅专栏 解锁全文

订阅专栏 解锁全文

1902

1902

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?