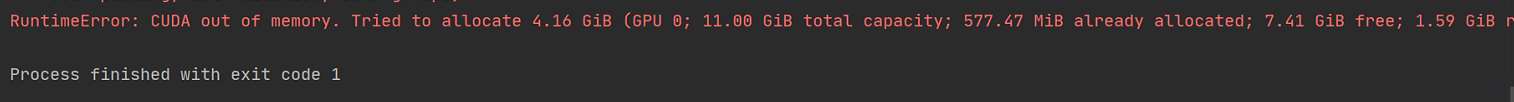

这里简述一下我遇到的问题:

可以看到可用内存是大于需要被使用的内存的,但他依旧是报CUDA out of memory的错误

我的解决方法是:修改num_workers的值,把它改小一点,就行了,如果还不行

可以考虑使用以下方法:

1.减小batch_size

2.运行torch.cuda.empty_cache()函数

3.释放GPU内存,kill掉没用的进程

4.更改使用的显卡。这里大多指在服务器上运行,没有制定显卡,都默认使用第一张,或者多人使用,产生的不足。

参考链接:https://blog.csdn.net/weixin_41401924/article/details/120851573

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?