准备新节点

将纯净的虚拟机复制一台出来,作为新的节点,并完成对应配置

1.修改mac地址以及IP地址

2.关闭防火墙,关闭selinux

3.更改主机名

4.更改主机名与IP地址映射

5.生成公钥与私钥,并完成ssh免密登录

6.安装jdk并配置环境

7.配置Hadoop环境

8.解压Hadoop安装包

9.将主节点关于Hadoop的配置文件全部拷贝到当前节点

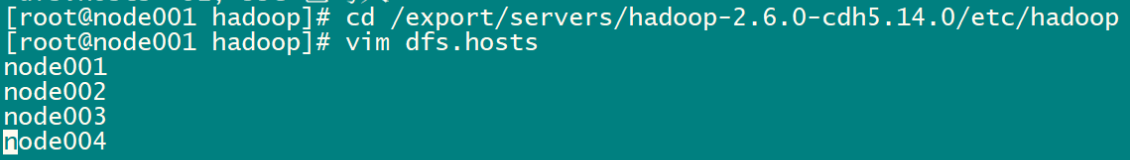

2.创建dfs.hosts文件并添加配置

在主节点也就是namenode所在的机器的/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop目录下创建dfs.hosts文件并添加工作节点(datanode)名字

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop vim dfs.hosts

3.主节点编辑hdfs-site.xml添加配置

在namenode的hdfs-site.xml配置文件中增加dfs.hosts属性

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/ vim

hdfs-site.xml

配置:

<property>

<name>dfs.hosts</name>

<value>/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/dfs.hosts</value>

</property>

4.刷新namenode

在主节点执行以下命令刷新namenode

hdfs dfsadmin -refreshNodes

5.更新resourceManager节点

主节点执行以下命令刷新resourceManager

yarn rmadmin -refreshNodes

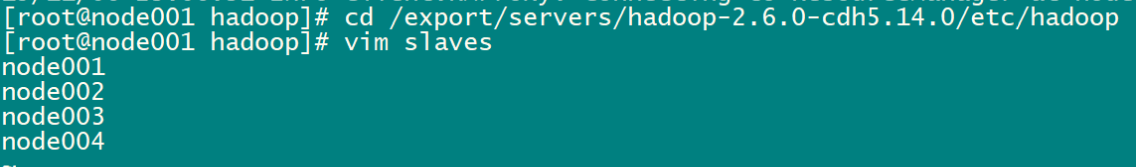

6.namenode的slaves文件增加新服务节点主机名称

主节点编辑slaves文件,并添加新增节点的主机,更改完后,slaves文件不需要分发到其他机器上面去

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim slaves

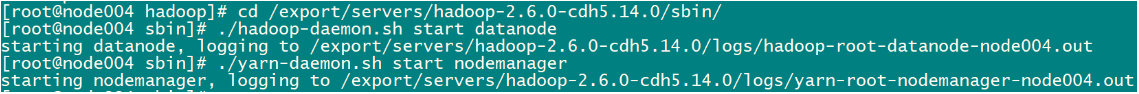

7.单独启动新增节点

在新增节点执行以下命令,启动datanode和nodemanager

cd /export/servers/hadoop-2.6.0-cdh5.14.0/sbin/

./hadoop-daemon.sh start datanode 启动datanode

./yarn-daemon.sh start nodemanager 启动nodemanager

8.浏览器查看

http://node01:50070/dfshealth.html#tab-overview

http://node01:8088/cluster

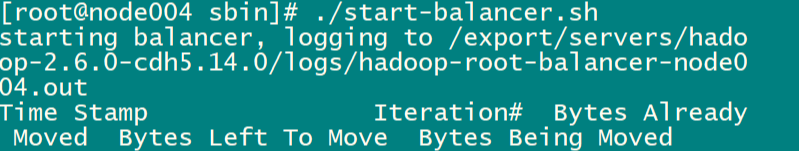

9.使用负载均衡命令,让数据均匀负载所有机器

cd /export/servers/hadoop-2.6.0-cdh5.14.0/sbin/

./start-balancer.sh

2675

2675

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?