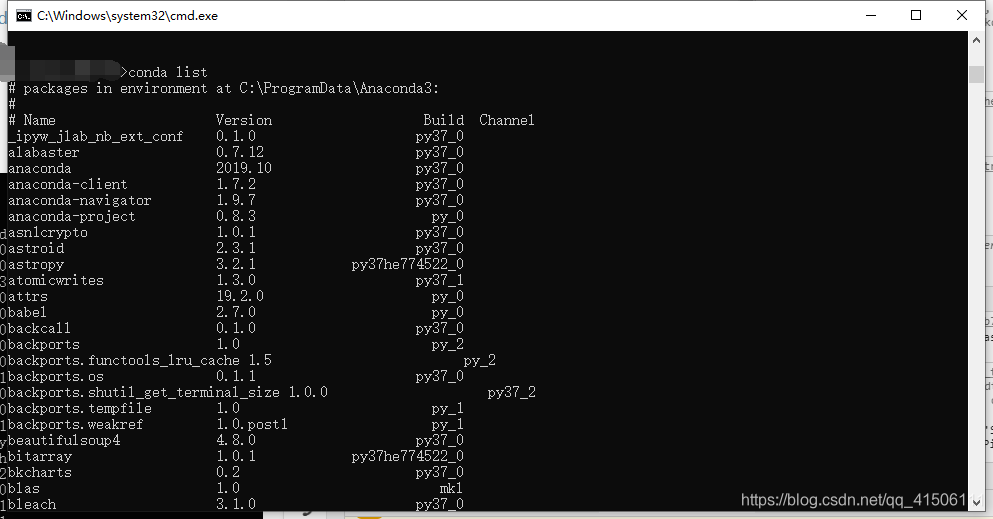

1. 查看conda中已经有的包

conda list

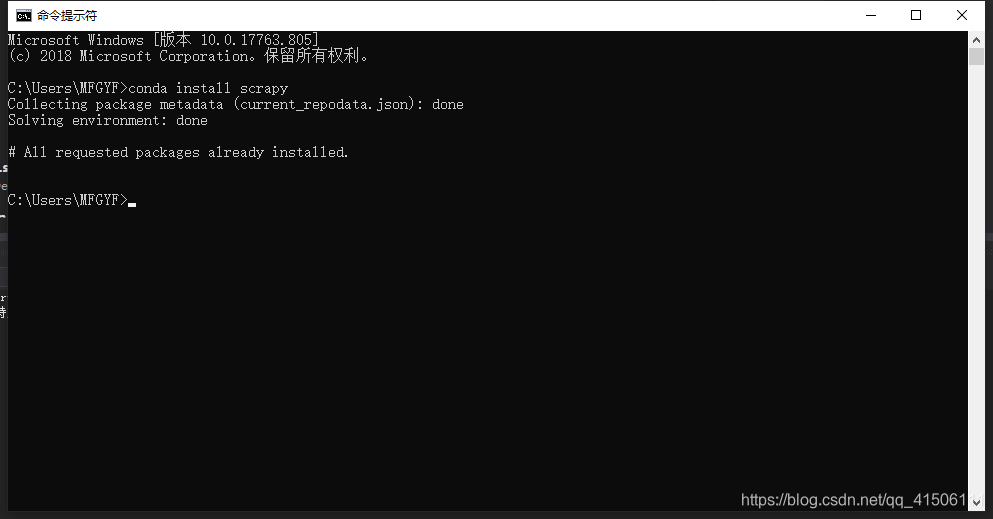

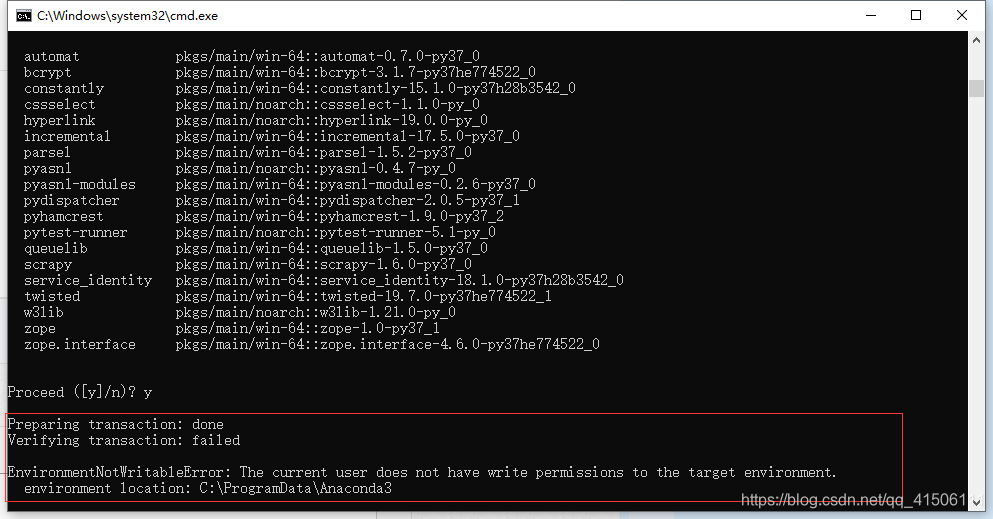

2. 安装Scrapy

conda install scrapy

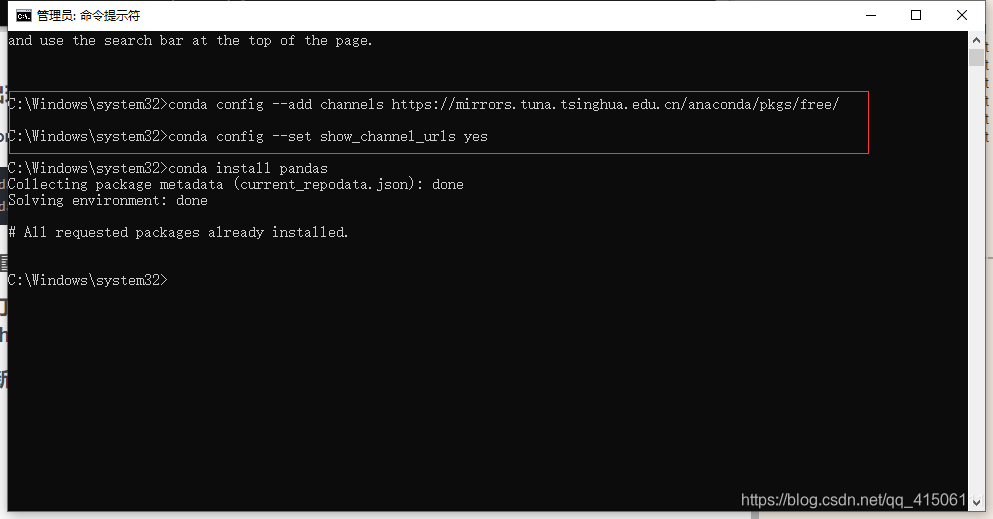

正确的结果

导致这种错误的原因是没有以管理员方式启动CMD

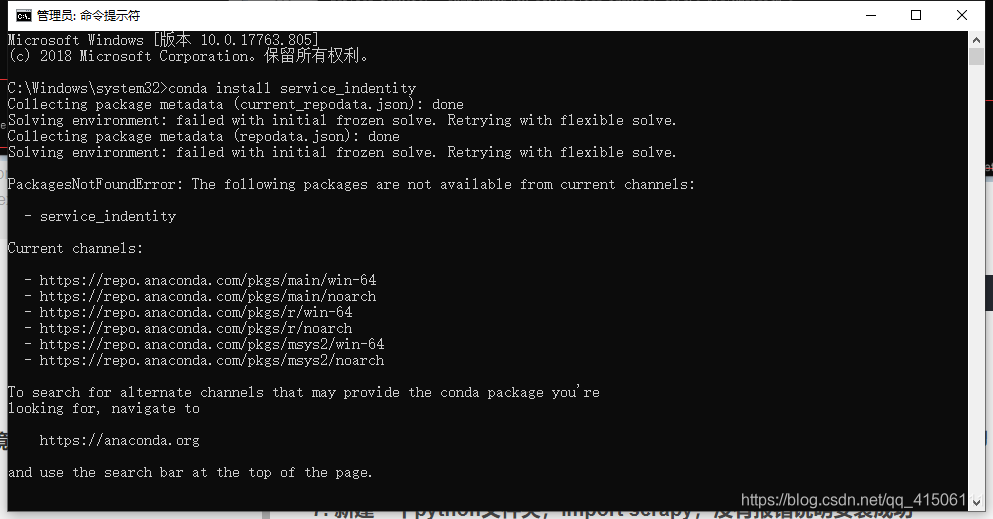

3. 安装依赖包

conda install service_indentity

4.出现CondaHTTPError的解决方法:添加清华大学镜像

conda源国内只有清华有,修改源只需输入如下两行命令:

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/

conda config --set show_channel_urls yes

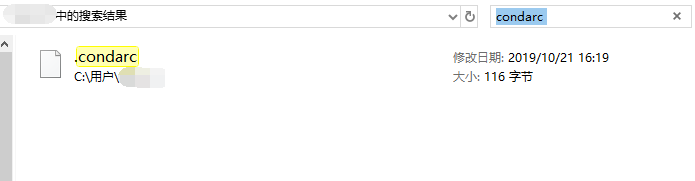

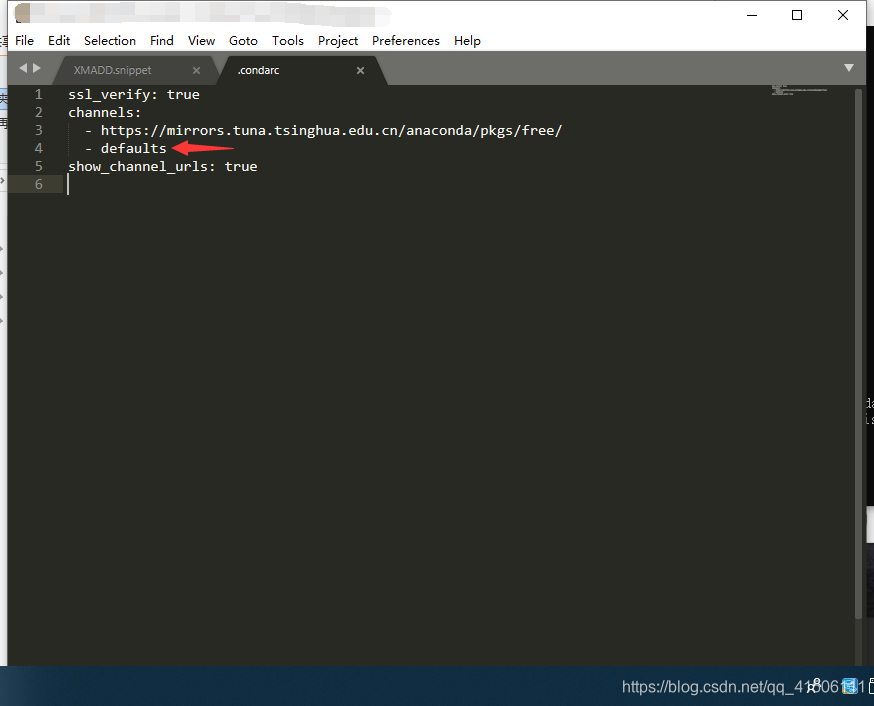

C:\Users\用户名中修改condarc的配置文件,删除第三行

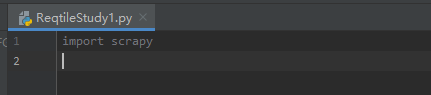

5. 新建一个python文件夹,import scrapy,没有报错说明安装成功

2064

2064

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?