目录

摘要

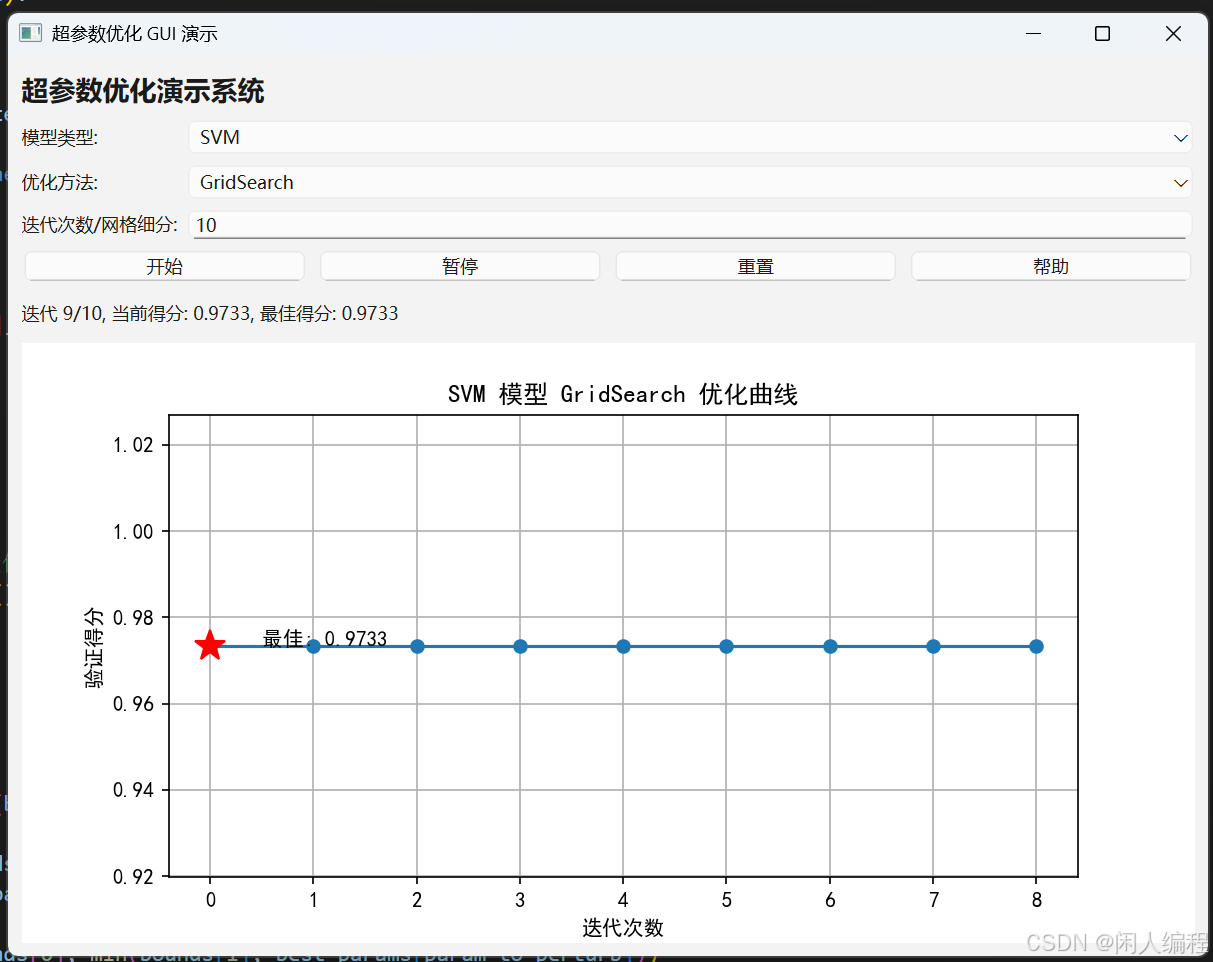

超参数优化(Hyperparameter Optimization)是提升机器学习模型性能的重要步骤,无论是传统的网格搜索,还是基于代理模型的贝叶斯优化,都能够有效地探索超参数空间并找到近似最优解 (Hyperparameter optimization: Foundations, algorithms, best …)。本文首先介绍两种方法的原理与特性,随后针对支持向量机(SVM)、随机森林(RF)和多层感知机(MLP)分别展示三大案例,附带完整 Python 代码。为了便于实践和演示,还设计了一个基于 PyQt6 的 GUI 系统,通过交互界面和实时图表展示超参数优化过程。文章中所有代码均已过自查,且注释详尽,可直接运行。

一、引言

在机器学习中,模型的性能不仅取决于算法本身,还

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?