简介

Sky-T1-32B 是由加州大学伯克利分校的 NovaSky 团队开发的一款高性能、低成本且完全开源的大规模推理模型。该模型拥有 320 亿个参数,训练成本却不到 450 美元,这主要得益于高效的训练方法和合成数据的应用26。与以往需要数百万美元才能完成训练的大型语言模型相比,Sky-T1-32B 的出现标志着一个重要的里程碑,它不仅降低了进入门槛,也为研究人员和开发者提供了一个强大的工具来探索先进的自然语言处理(NLP)技术。

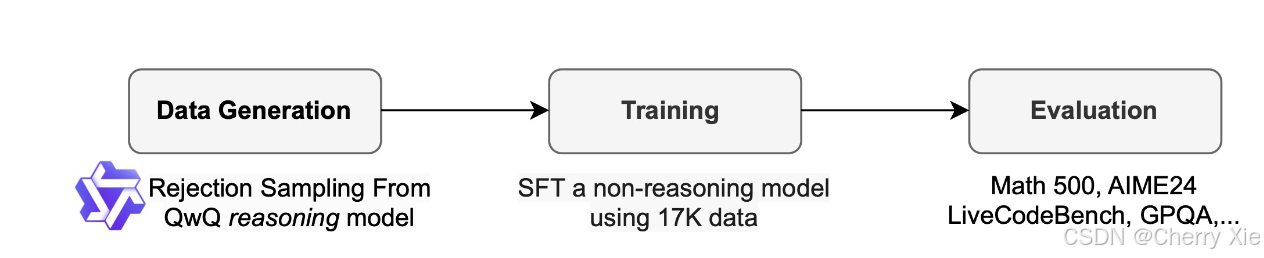

训练环境

Sky-T1-32B 的训练是在一组8个 Nvidia H100 GPU 上进行的,整个过程大约耗时19小时。这种硬件配置相对较为常见,意味着更多的研究机构和个人开发者能够复制这一成果,从而推动了 AI 技术的发展。此外,团队还特别指出,通过使用合成数据集,他们能够在保证模型性能的同时大幅减少实际所需的计算资源,这对于促进人工智能领域的可持续发展具有重要意义。

完全开源:共同推动进步

为了确保团队的工作惠及更广泛的社区,novasjy完全致力于开源协作。开源所有细节(即数据、代码、模型权重),使社区能够轻松复制和改进团队的结果:

- 基础设施:在单个存储库中构建数据、训练和评估模型。

- 数据:用于训练Sky-T1-32B-Review的17K数据。

- 技术细节:我们的技术报告和魔杖日志。

- 型号重量:我们的32B模型权重。

性能表现

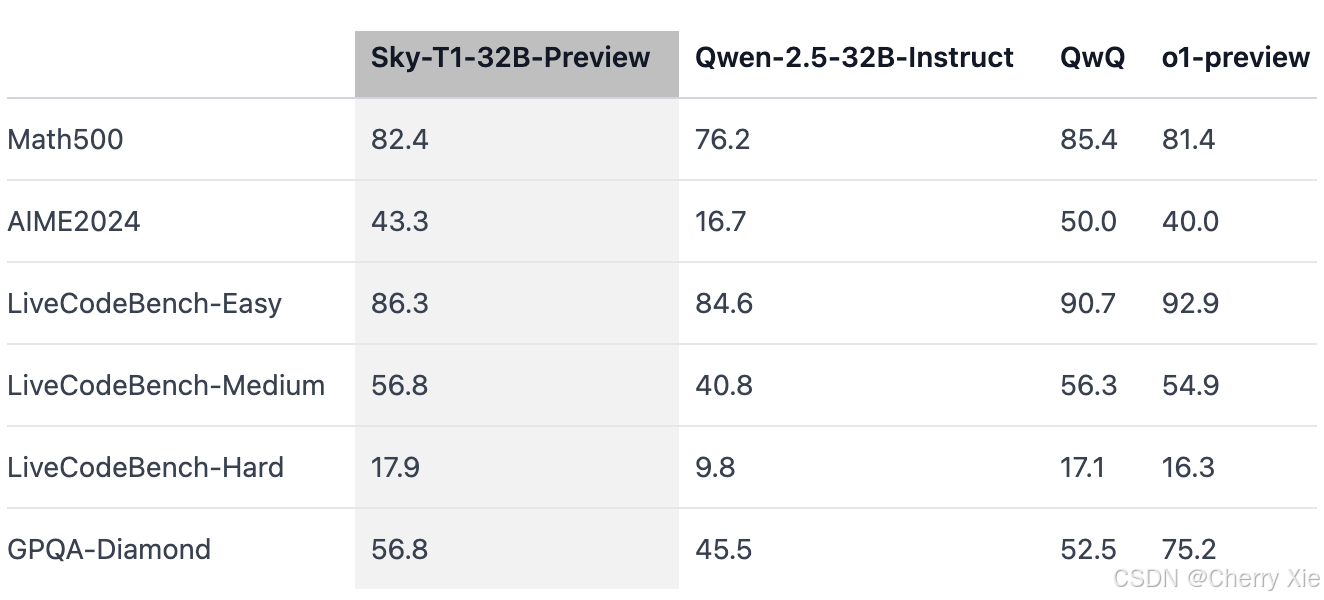

在多个基准测试中,Sky-T1-32B 展现出了令人印象深刻的表现。例如,在 MATH500(一套竞赛级别的数学挑战题)上,Sky-T1-32B 的成绩优于 o1 的早期预览版本;而在 LiveCodeBench(一种编程评估平台)上的难题解答方面,同样超过了 o1 的预览版本。这些成就证明了 Sky-T1-32B 不仅能在复杂的数学问题求解中取得优异的成绩,而且在代码生成、优化以及错误检测等编程相关任务中也表现出色。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?