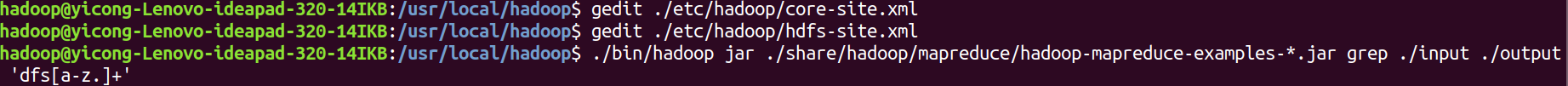

重新进入到/usr/local/hadoop执行

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep ./input ./output 'dfs[a-z.]+'发现拒绝链接,执行查看命令

cat ./output/*也根本没有统计命令。回想之前的安装过程,才发现没有更改 伪分布式的配置文件。便出现了第一张图片的代码,用gedit 命令分别将core-site.xml和hdfs-site.xml文件中

<configuration>

</configuration>之间的配置删去。

操作之后,再执行

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep ./input ./output 'dfs[a-z.]+'便可完成词频统计啦。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1793

1793

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?