下载安装

1、下载地址

https://archive.apache.org/dist/spark/

找到对应适配 Hadoop 版本的安装包下载:

spark-x.x.x-bin-hadoopx.x.tgz

2、安装

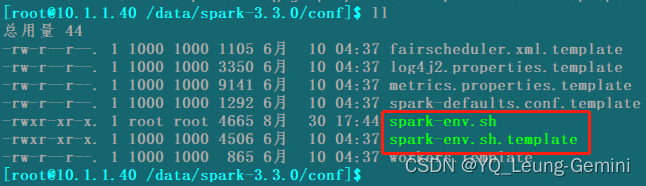

解压安装包,进入 conf 目录使用 cp 复制配置模板

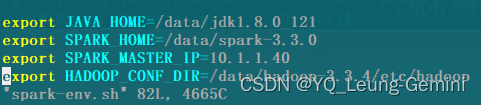

编辑配置文件,添加对应环境变量

export JAVA_HOME=/data/jdk1.8.0_121 # JDK 路径

export SPARK_HOME=/data/spark-3.3.0 # Spark 路径

export SPARK_MASTER_IP=10.1.1.40 # 本机 IP

export HADOOP_CONF_DIR=/data/hadoop-3.3.4/etc/hadoop # Hadoop 配置路径

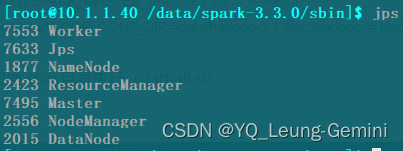

切换 sbin 目录执行 ./start-all.sh

jps 查看进程:Master,Worker

测试使用

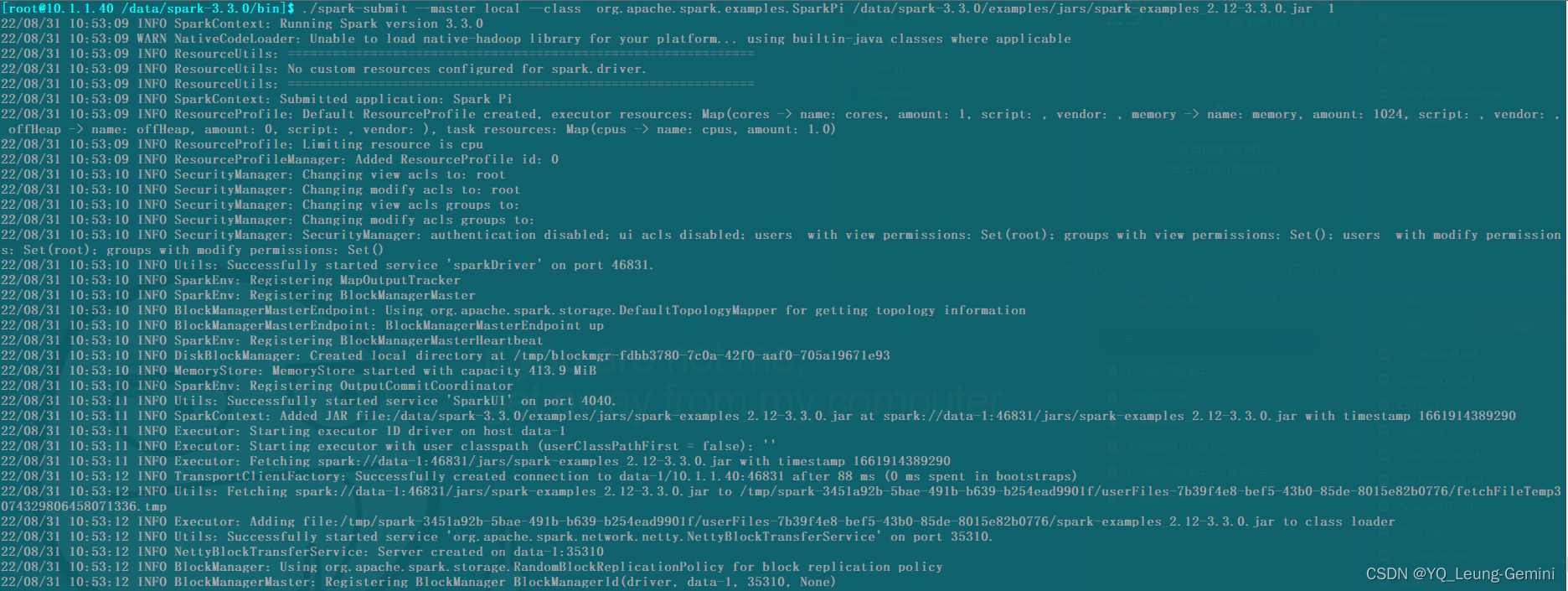

1、本地测试

切换 bin 目录

./spark-submit --master local --class org.apache.spark.examples.SparkPi /data/spark-3.3.0/examples/jars/spark-examples_2.12-3.3.0.jar 1

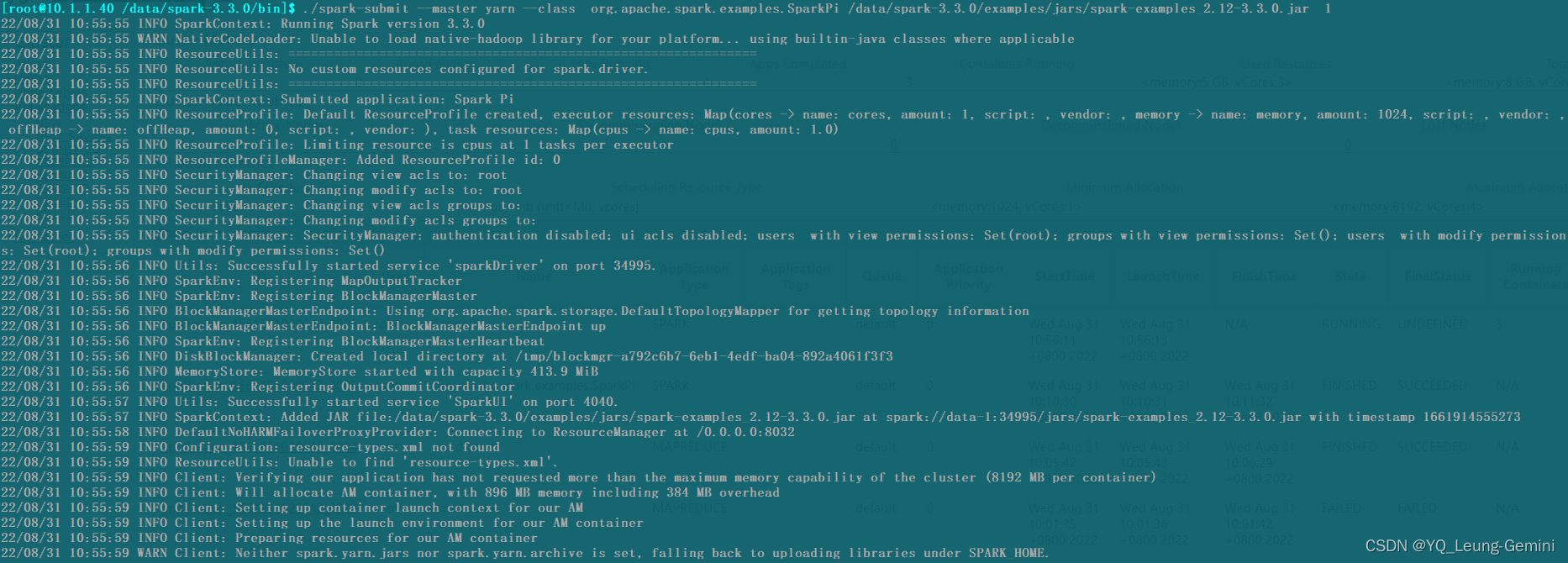

2、Spark on Yarn

./spark-submit --master yarn --class org.apache.spark.examples.SparkPi /data/spark-3.3.0/examples/jars/spark-examples_2.12-3.3.0.jar 1

或

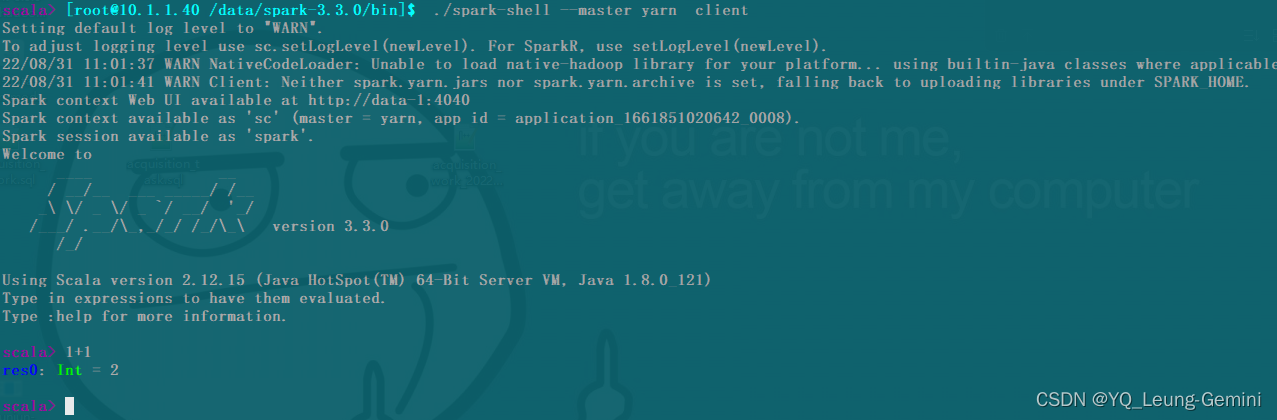

./spark-shell --master yarn client

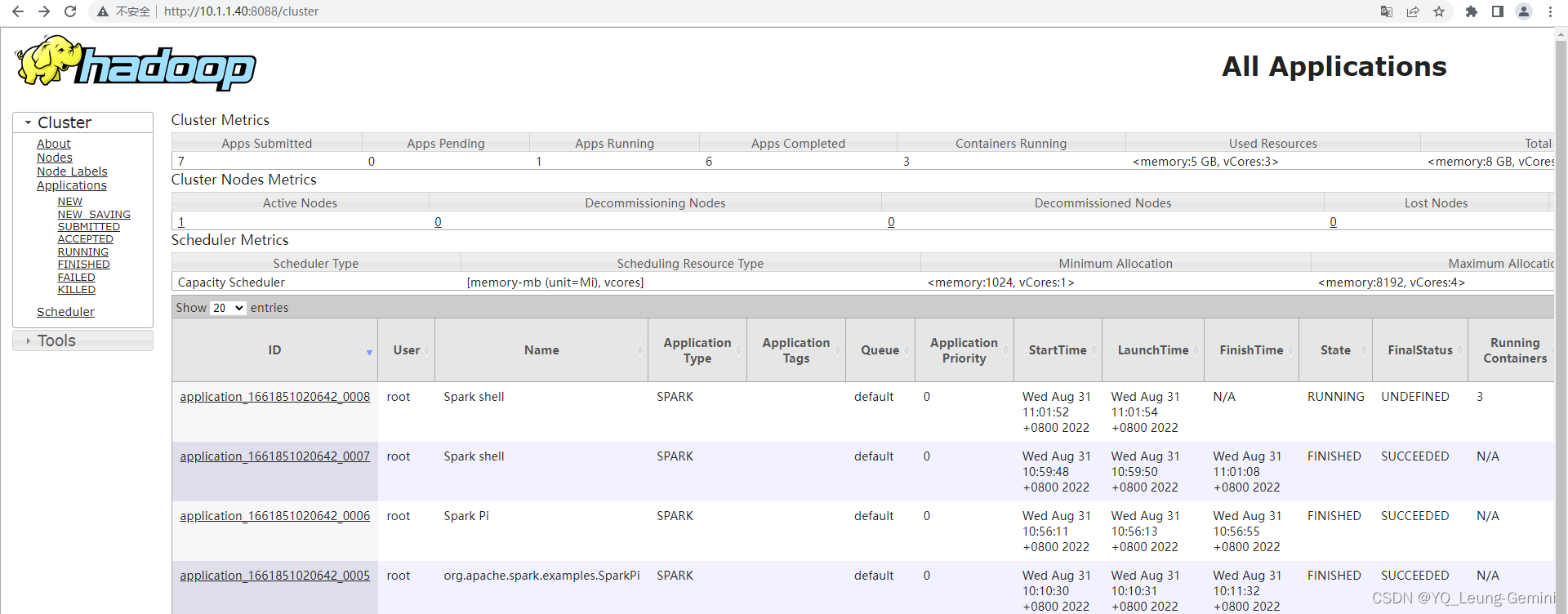

执行测试后 Yarn web 截图

异常处理

现象1:

spark on yarn 模式提交任务报错:java.lang.Exception: When running with master ‘yarn’ either HADOOP_CONF_DIR or YARN_CONF_DIR must be set in the environme.

原因:

spark 找不到 yarn 相关的地址端口信息,无法提交到yarn上运行

解决:

检查 spark-env.sh 环境变量配置,HADOOP_CONF_DIR 配置路径是否正确:

export HADOOP_CONF_DIR=/data/hadoop-3.3.4/etc/hadoop # Hadoop 配置路径

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?