网络构建

神经网络模型是由神经网络层和Tensor操作构成的,mindspore.nn提供了常见神经网络层的实现,在MindSpore中,Cell类是构建所有网络的基类,也是网络的基本单元。一个神经网络模型表示为一个Cell,它由不同的子Cell构成。

1.定义模型类

当我们定义神经网络时,可以继承nn.Cell类,在__init__方法中进行子Cell的实例化和状态管理,在construct方法中实现Tensor操作。

Network 类继承自 nn.Cell,这是 MindSpore 框架中的基类,类似于 PyTorch 的 nn.Module。

2.模型层

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512, weight_init="normal", bias_init="zeros"),

nn.ReLU(),

nn.Dense(512, 512, weight_init="normal", bias_init="zeros"),

nn.ReLU(),

nn.Dense(512, 10, weight_init="normal", bias_init="zeros")

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

softmax = nn.Softmax(axis=1)

pred_probab = softmax(logits)

- 输入是一个 28x28 的图像。

- nn.Flatten()展平操作将图像转换为 784 维的一维向量。

- nn.SequentialCell通过一个包含三层全连接层和两个 ReLU激活函数的序列。

- 输出是 10 维的向量,对应于 10 个分类的得分。

- nn.Softmax最后使用nn.Softmax将神经网络最后一个全连接层返回的logits的值缩放为[0, 1],表示每个类别的预测概率。

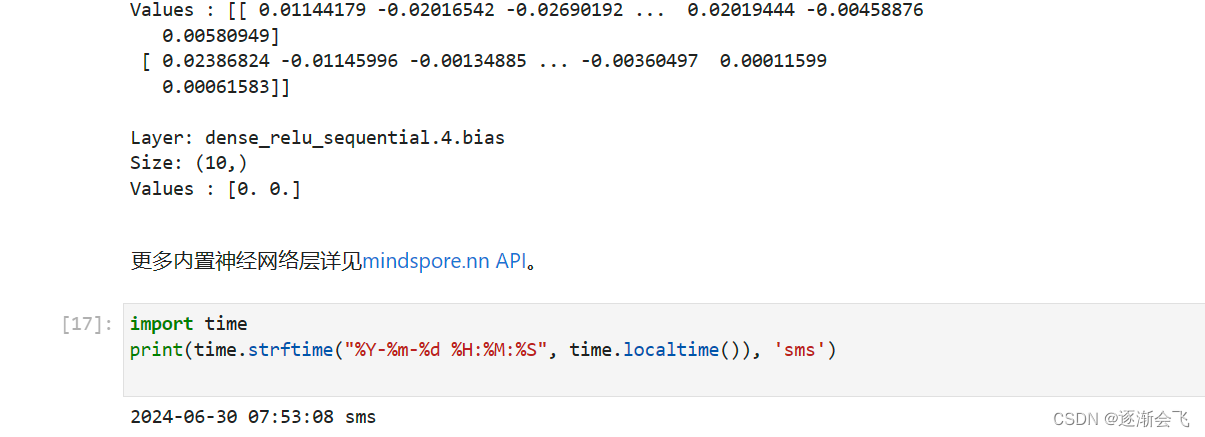

## 模型参数

网络内部神经网络层具有权重参数和偏置参数(如nn.Dense),这些参数会在训练过程中不断进行优化,可通过 model.parameters_and_names() 来获取参数名及对应的参数详情。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?