涉及知识点:

操作系统 Linux(centos 7)

1.本程序最终希望实现的功能是:在我们平时工作中,有的时候我们需要自动产生大量的文件,比如说我们使用高斯交作业,有些输入文件可以通过程序来自动产生,那么我就希望能够有一个程序能够批量产生大量的文件,并且在产生了这些文件以后,能够自动分组,分组的目的就是希望能够充分利用当前服务器的核数来进行计算。

2.当前这个程序能够实现的是,比如我们的服务器有64核,我可以分配CPU核数来进行并行操作,想要产生100W个文件,我将其分成8组,也就是说一组使用8核来产生——解压——移动12.5W文件,最终通过时间对比,发现效率大大增加。

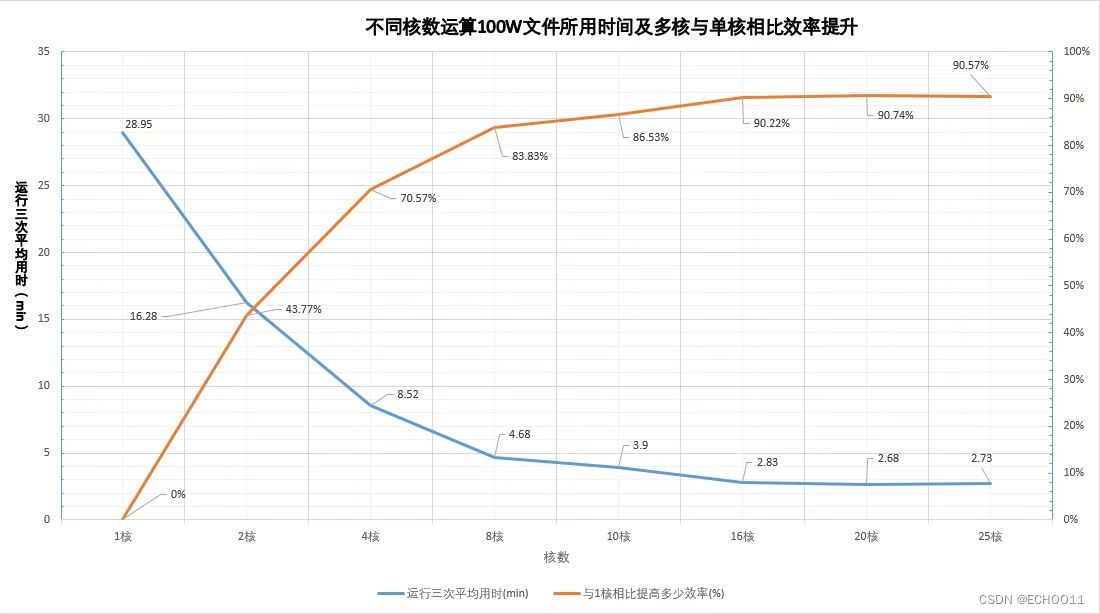

仅生成100W文件(不包含解压与移动),用不同数量核数的效率如下图所示:

2.代码展示

第一部分先展示最核心的代码段:

starttime=`date +'%Y-%m-%d %H:%M:%S'` #计算所用时间

for((i=1;i<=1;i++))

do

taskset -c $i sh ./generate_$i.sh& #指定核数计算

done

wait #等待结束后再进行下一步

for((i=1;i<=1;i++))

do

taskset -c $i sh ./tar_$i.sh&

done

wait

for((i=1;i<=1;i++))

do

taskset -c $i sh ./mv_$i.sh&

done

wait

for((i=1;i<=1;i++))

do

cd group_$i

tar -xzvf group_$i.tar.gz

cd ..

done

wait

gawk -f ./clear.awk

endtime=`date +'%Y-%m-%d %H:%M:%S'`

start_seconds=$(date --date="$starttime" +%s);

end_seconds=$(date --date="$endtime" +%s);

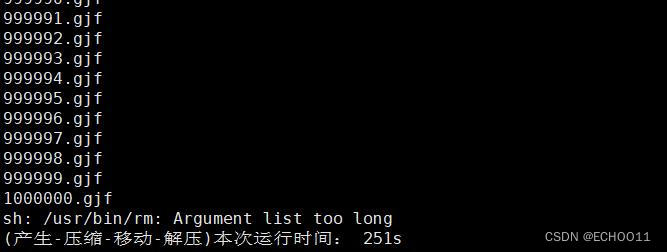

echo "(产生-压缩-移动-解压)本次运行时间: "$((end_seconds-start_seconds))"s"第二部分就是完整代码,因为我想用一个awk程序就完成所有的步骤,所以我利用了awk来写shell和awk,强迫症患者~

BEGIN{

#调用的核数

CORE=1

#生成的文件数

file_number=1000000

#步长

step=file_number/CORE

print"本次程序将产生——解压——移动"file_number"个文件"

print"本次分成"CORE"组"

#——————————————————————————创建mv,tar,及总sh文件——————————————————#

bar1=1

if(bar1==1){

#创建产生文件的awk和sh

for(i=1;i<=CORE;i++)

{

system("touch " "generate_"i".sh")

system("touch " "generate_"i".awk")

}

#创建分组文件夹

for(i=1;i<=CORE;i++)

{

system("mkdir " "group_"i"")

}

#创建成组的mv文件

for(i=1;i<=CORE;i++)

{

system("touch " "mv_"i".sh")

printf"mv group_"i".tar.gz group_"i"">"mv_"i".sh"

}

#产生总并发sh文件

system("touch " "all_sh.sh")

print "starttime=`date +'%Y-%m-%d %H:%M:%S'`">"all_sh.sh"

print"for((i=1;i<="CORE";i++))">"all_sh.sh"

print"do">"all_sh.sh"

print" taskset -c $i sh generate_$i.sh&">"all_sh.sh"

print"done">"all_sh.sh"

print"wait">"all_sh.sh"

print"for((i=1;i<="CORE";i++))">"all_sh.sh"

print"do">"all_sh.sh"

print" taskset -c $i sh tar_$i.sh&">"all_sh.sh"

print"done">"all_sh.sh"

print"wait">"all_sh.sh"

print"for((i=1;i<="CORE";i++))">"all_sh.sh"

print"do">"all_sh.sh"

print" taskset -c $i sh mv_$i.sh&">"all_sh.sh"

print"done">"all_sh.sh"

print"wait">"all_sh.sh"

print"for((i=1;i<="CORE";i++))">"all_sh.sh"

print"do">"all_sh.sh"

print" cd group_$i">"all_sh.sh"

print" tar -xzvf group_$i.tar.gz">"all_sh.sh"

print" cd ..">"all_sh.sh"

print"done">"all_sh.sh"

print"wait">"all_sh.sh"

print"gawk -f clear.awk">"all_sh.sh"

print "endtime=`date +'%Y-%m-%d %H:%M:%S'`">"all_sh.sh"

print "start_seconds=$(date --date=\"$starttime\" +%s);">"all_sh.sh"

print "end_seconds=$(date --date=\"$endtime\" +%s);">"all_sh.sh"

print "echo \"(产生-压缩-移动-解压)本次运行时间: \"$((end_seconds-start_seconds))\"s\"">"all_sh.sh"

}

#————————————————————————————————————————————————————————#

#————————————————————————————产生主体文件——————————————————————————#

bar2=1

if(bar2==1)

{

#递进数组

progressive[1]=1

progressive_step=step

for(i=2;i<=CORE+1;i++)

{

progressive[i]=progressive_step

progressive_step=progressive_step+step

}

for(i=1;i<=CORE;i++)

{

#产生文件的awk内容

print "BEGIN{">"generate_"i".awk"

print "printf\"tar -czvf group_"i".tar.gz \">\"tar_"i".sh\"">"generate_"i".awk"

print "system(\"touch \" \"tar_"i".sh\")">"generate_"i".awk"

print "for(i="progressive[i]";i<="progressive[i+1]";i++){"> "generate_"i".awk"

print " system(\"touch \"i\".gjf&\")"> "generate_"i".awk"

print " printf\" \"i\".gjf\">\"tar_"i".sh\"}}" > "generate_"i".awk"

#产生文件的sh内容

print "gawk -f generate_"i".awk">"generate_"i".sh"

}

}

#————————————————————————clean文件,清除所有已经用完的程序————————————————————#

system("touch " "clear.awk")

print"BEGIN{">"clear.awk"

print"CORE="CORE"">"clear.awk"

print"for(i=1;i<=CORE;i++)">"clear.awk"

print"{">"clear.awk"

print" system(\"rm " "tar_\"i\".sh\")">"clear.awk"

print" system(\"rm " "mv_\"i\".sh\")">"clear.awk"

print" system(\"rm \" \"generate_\"i\".sh\")">"clear.awk"

print" system(\"rm \" \"generate_\"i\".awk\")" >"clear.awk"

print"}">"clear.awk"

print"system(\"rm \" \"all_sh.sh\")">"clear.awk"

print"system(\"rm \" \"*.gjf\")">"clear.awk"

print"}">"clear.awk"

#————————————————————————————————————————————————————————#

#—————————————————————————运行总程序————————————————————————#

system("sh " "all_sh.sh")

#——————————————————————————————————————————————————————#

}运行结果如下(百万文件的产生—压缩—移动—解压):

![]()

3326

3326

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?