线性回归的代价函数

文章目录

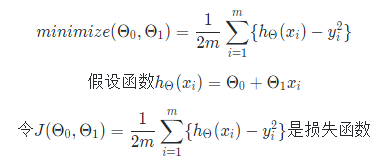

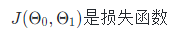

1.损失函数(cost function)

2.误差平方和函数 的目标(square error function)

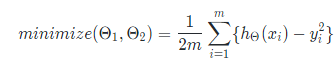

3.简化

- 寻找最佳拟合直线的目标

4.算法

4.1 梯度下降算法(Gradient descent algorithm)

能够自动找出使代价函数J 取最小值的参数 Θ 0 \Theta_0 Θ0 和 Θ 1 \Theta_1 Θ1 来

- 重复直到收敛

repeat until convergence{

Θ j \Theta_j Θj := Θ j \Theta_j Θj - α \alpha α ∂ J ( Θ 0 , Θ 1 ) ∂ Θ j \frac{\partial J(\Theta_0,\Theta_1)}{\partial \Theta_j} ∂Θj∂J(Θ0,Θ1) (for j=0 and j = 1)

}

4.1.1

α

\alpha

α 是学习速率

- ·学习率

如果 α \alpha α太小,比喻为迈着小碎步下山,结果是要走很多步才能到达最低点;如果 α \alpha α太大,可能会越过最低点

- 举例 :对参数

Θ

0

\Theta_0

Θ0 和

Θ

1

\Theta_1

Θ1不断重复下面操作,且

Θ

0

\Theta_0

Θ0 和

Θ

1

\Theta_1

Θ1同时更新,直到收敛

正确操作:

temp0 := Θ 0 \Theta_0 Θ0 - α \alpha α ∂ J ( Θ 0 , Θ 1 ) ∂ Θ 0 \frac{\partial J(\Theta_0,\Theta_1)}{\partial \Theta_0} ∂Θ0∂J(Θ0,Θ1)

temp1 := Θ 1 \Theta_1 Θ1 - α \alpha α ∂ J ( Θ 0 , Θ 1 ) ∂ Θ 1 \frac{\partial J(\Theta_0,\Theta_1)}{\partial \Theta_1} ∂Θ1∂J(Θ0,Θ1)

Θ 0 \Theta_0 Θ0 := temp0

Θ 1 \Theta_1 Θ1 := temp1

错误操作:

temp0 := Θ 0 \Theta_0 Θ0 - α \alpha α ∂ J ( Θ 0 , Θ 1 ) ∂ Θ 0 \frac{\partial J(\Theta_0,\Theta_1)}{\partial \Theta_0} ∂Θ0∂J(Θ0,Θ1)

Θ 0 \Theta_0 Θ0 := temp0

temp1 := Θ 1 \Theta_1 Θ1 - α \alpha α ∂ J ( Θ 0 , Θ 1 ) ∂ Θ 1 \frac{\partial J(\Theta_0,\Theta_1)}{\partial \Theta_1} ∂Θ1∂J(Θ0,Θ1)

Θ 1 \Theta_1 Θ1 := temp1

5.矩阵

5.1矩阵乘法

- 可以将大量运算打包到一次矩阵的乘法运算中

利用矩阵相乘的方法在计算机中任何语言都可以很快的实现,可以简化代码

- 多个特征的处理

5.2 奇异矩阵

没有逆矩阵的矩阵可以相成非常接近0,逆矩阵不存在的矩阵的专有名词是奇异矩阵或则叫退化矩阵

978

978

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?