架构描述

- Filebeat input 收集 log。

- Filebeat output 将 log 写入 kafka 的 topic。

- Logstash input 消费 kafka 的 topic。

- Logstash output 将数据写入 elasticsearch 的 index。

- Kibana 展示 elasticsearch 的 index 数据。

·

问题展示

PS: 主要看 Logstash output 中 index 的配置

Logstash 的初始配置

#消费 kafka 的配置

input{

kafka {

bootstrap_servers => "10.0.30.31:9092,10.0.30.32:9092,10.0.30.33:9092"

topics => "wpf-test-topic"

group_id => "vlan30-logstash"

decorate_events => true

consumer_threads => 3

auto_offset_reset => "earliest"

codec => "json"

}

}

#多个项目日志可根据 if 判断输出不同的索引

output{

if [fields][project] == "wpf-test"{

elasticsearch {

hosts => ["10.0.30.34:9200","10.0.30.35:9200","10.0.30.36:9200"]

index => "log-wpf-test-%{+YYYY.MM.dd}"

user => "elastic"

password => "vlan30-elastic"

}

#stdout{

# codec=>rubydebug

#}

}

}

·

问题描述

这种配置的情况下,会按照系统的时间来创建索引,我当时出现了以下几种情况:

- 1 在第一次启动 Logstash 时,会将所有数据写入当前创建的一个索引中。

- 2 在 Kibana 展示索引信息时,并且通过 “@timestamp” 进行排序时,是根据数据写入的时间进行排序的,而不是日志的时间。这样会导致数据展示混乱。

- 3 按天创建索引时,索引的创建时间为每天上午的八点,而不是零点,这样会导致前一天创建的索引中包含第二天上午八点前的日志,在进行数据统计时不准确。

·

问题截图展示

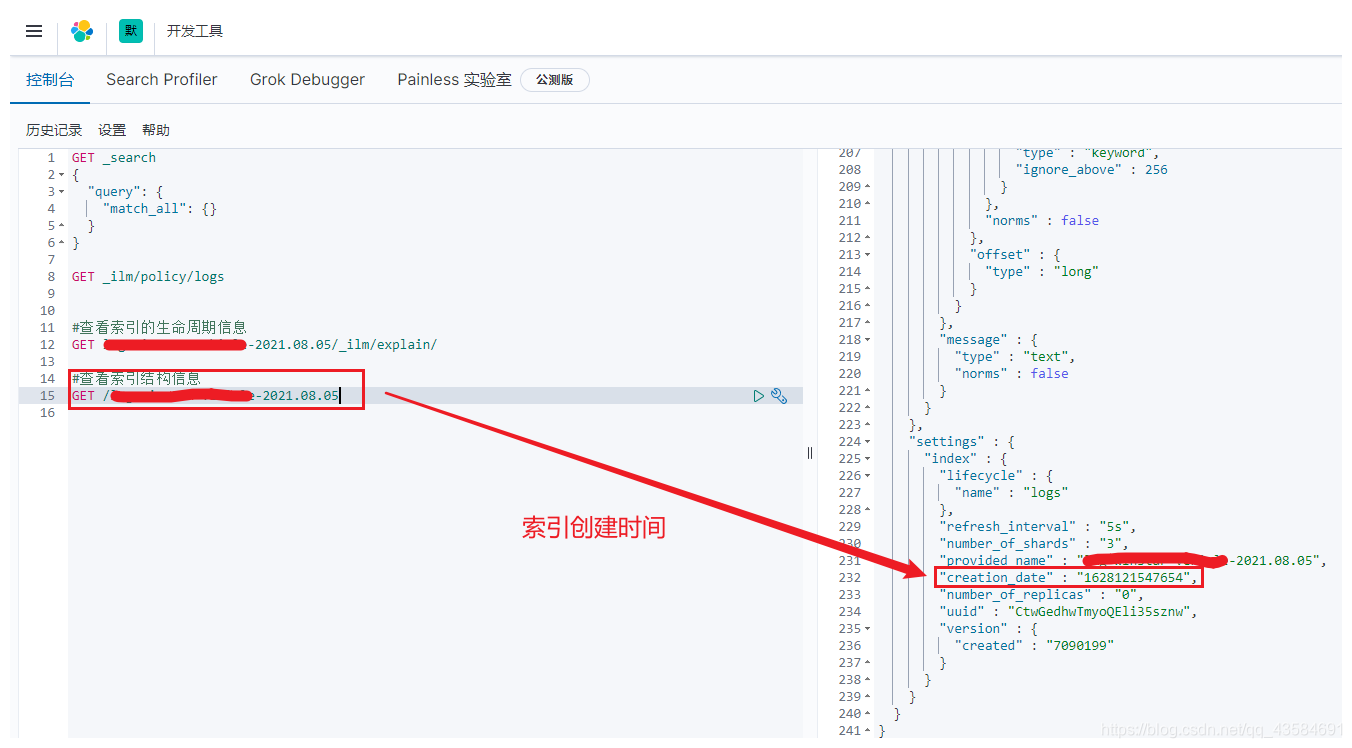

索引的创建时间展示图

·

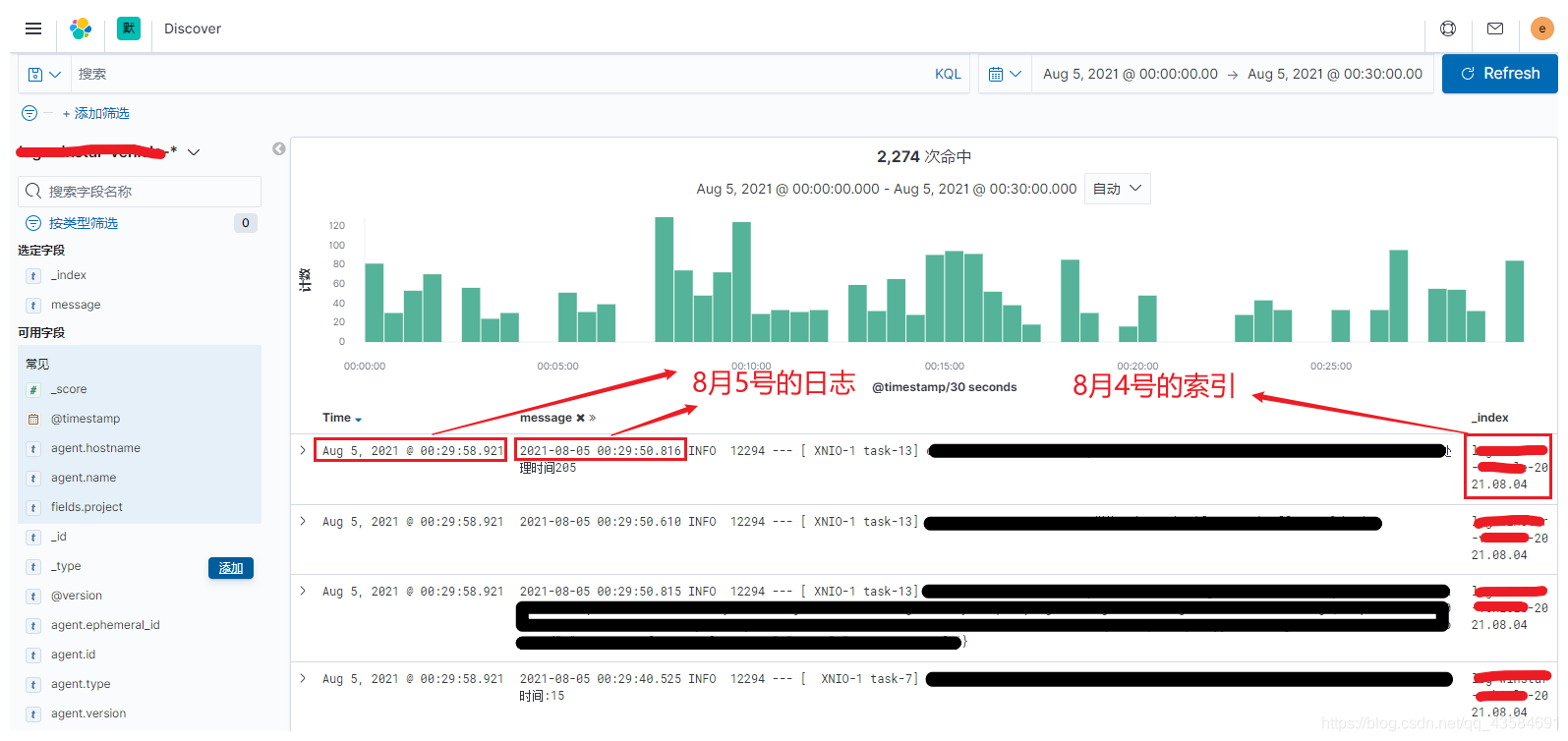

一个索引包含两天的日志展示图

·

解决方法

查找了 Elastic 中文社区的相关文档(strglee大佬的评论),最后使用 “@timestamp” 创建索引后,问题解决。如下所示:

PS: 主要看 logstash filter 和 output 中 index 的配置

#消费 kafka 的配置

input{

kafka {

bootstrap_servers => "10.0.30.31:9092,10.0.30.32:9092,10.0.30.33:9092"

topics => "wpf-test-topic"

group_id => "vlan30-logstash"

decorate_events => true

consumer_threads => 3

auto_offset_reset => "earliest"

codec => "json"

}

}

filter {

#增加一个字段,计算 timestamp 8小时

ruby {

code => "event.set('timestamp', event.get('@timestamp').time.utc+8*60*60)"

}

#用 mutate 插件先转换为 string 类型,gsub只处理string类型的数据

#再用正则匹配,最终得到想要的日期

mutate {

convert => ["timestamp", "string"]

gsub => ["timestamp", "T([\S\s]*?)Z", ""]

gsub => ["timestamp", "-", "."]

}

}

#多个项目日志可根据 if 判断输出不同的索引

output{

if [fields][project] == "wpf-test"{

elasticsearch {

hosts => ["10.0.30.34:9200","10.0.30.35:9200","10.0.30.36:9200"]

index => "log-wpf-test-%{timestamp}"

user => "elastic"

password => "vlan30-elastic"

}

#stdout{

# codec=>rubydebug

#}

}

}

156

156

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?