local 本地测试

- idea运行

flink集群测试

1、standallone cluster

1、准备工作

- 配置JAVA_HOME

- 免密钥

2、上传解压

tar -xvf flink-1.11.0-bin-scala_2.11.tgz

配置环境变量

vim /etc/profile

3、修改配置文件(如果是伪分布式,就不需要修改配置文件)

vim conf/flink-conf.yaml

jobmanager.rpc.address: master 主节点ip地址

vim conf/workers

增加从节点 node1 node2

vim conf/masters

改成主节点ip

同步到所有节点

scp -r flink-1.11.0/ node1:`pwd`

4、启动集群

start-cluster.sh

http://master:8081 访问web界面

2、提交任务 – 将代码打包

-

在web页面提交任务

-

同flink命令提交任务

flink run -c com.xiaoming.flink.core.Demo1WordCount flink-1.0-SNAPSHOT.jar

- rpc方式提交任务

- flink on yarn 只需要部署一个节点

可以停掉独立集群

stop-cluster.sh

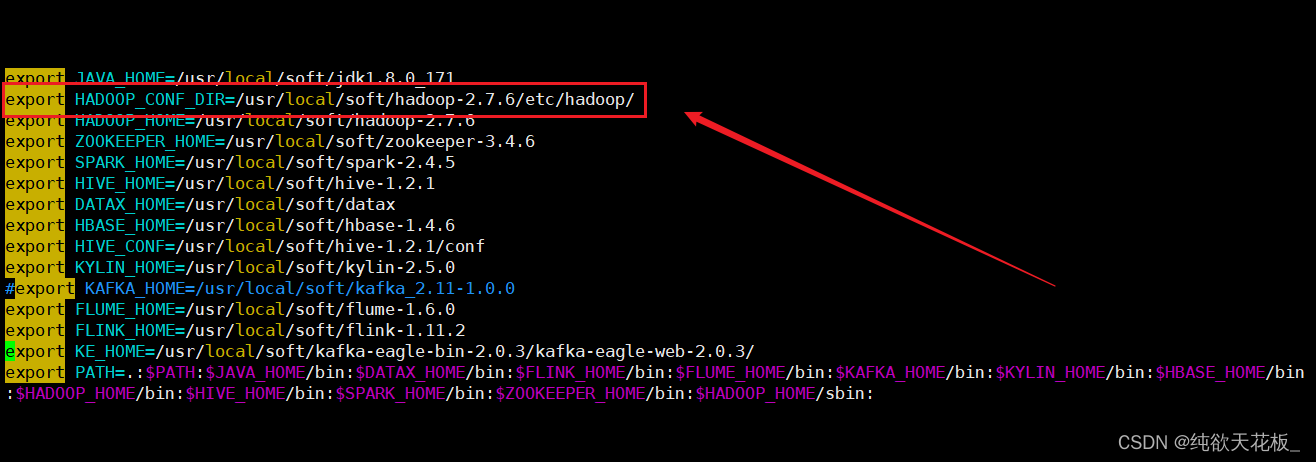

- 配置HADOOP_CONF_DIR

vim /etc/profile

export HADOOP_CONF_DIR=/usr/local/soft/hadoop-2.7.6/etc/hadoop/

- 将hadoop依赖jar上传到flink lib目录

flink-shaded-hadoop-2-uber-2.6. 5-10.0.jar

flink和spark一样都是粗粒度资源申请

- flink启动方式

- yarn-session

在yarn里面启动一个flink集群 jobManager(ApplicationMaster)

先启动hadoop

yarn-session.sh -jm 1024m -tm 1096m

提交任务 任务提交的是偶根据并行度动态申请taskmanager

1、在web页面提交任务

2、同flink命令提交任务

flink run -c com.xiaoming.flink.core.Demo1WordCount flink-1.0-SNAPSHOT.jar

3、rpc方式提交任务

- 直接提交任务到yarn 每一个任务都会有一个jobManager

flink run -m yarn-cluster -yjm 1024m -ytm 1096m -c com.xiaoming.flink.core.Demo1WordCount flink-1.0-SNAPSHOT.jar

杀掉yarn上的任务

yarn application -kill application_1599820991153_0001

1.yarn-session先在yarn中启动一个jobMansager ,所有的任务共享一个jobmanager (提交任务更快,任务之间共享jobmanager , 相互有影响)

2.直接提交任务模型,为每一个任务启动一个joibmanager (每一个任务独立jobmanager , 任务运行稳定)

1254

1254

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?