上一篇:VMware 配置 CentOS7 集群环境

各集群节点的角色分配如下:

| 节点 | 角色 |

|---|---|

| centos01 | NameNode SecondaryNameNode DataNode ResourceManager NodeManager |

| centos 02 | DataNode NodeManager |

| centos03 | DataNode NodeManager |

上传Hadoop并解压

在centos01节点中,将hadoop安装文件hadoop-2.8.2.tar.gz上传到/opt/softwares目录,然后进入该目录,解压安装文件到/opt/modules:

cd /opt/softwares/

tar -zxf hadoop-2.8.2.tar.gz -C /opt/modules/

配置系统环境变量

sudo vi /etc/profile

在文件末尾加入以下内容:

export HADOOP_HOME=/opt/modules/hadoop-2.8.2

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

source /etc/profile

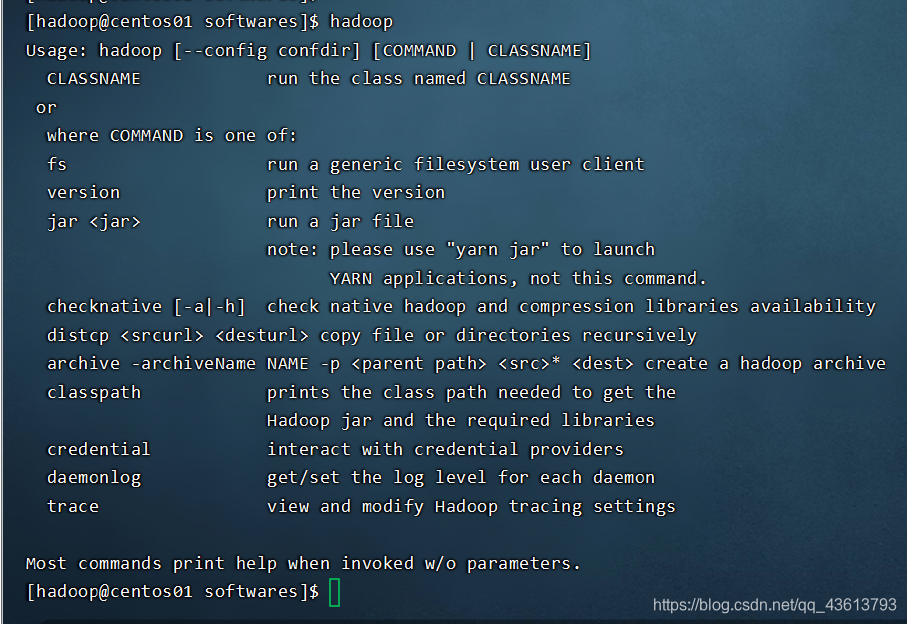

执行hadoop命令,观察是否配置成功

配置Hadoop环境变量

hadoop所有的配置文件都在安装目录下的etc/hadoop中,进入该目录,修改以下配置文件:

hadoop-env.sh

mapred-env.sh

yarn-env.sh

这三个文件分别加入JAVA_HOME环境变量:

export JAVA_HOME=/opt/modules/jdk1.8.0_161

配置HDFS

修改配置文件core-site.xml

加入以下内容:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://centos01:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/opt/modules/hadoop-2.8.2/tmp</value>

</property>

</configuration>

fs.defaultFS:HDFS的默认访问路径,也是NameNode的访问地址

hadoop.tmp.dir:Hadoop数据文件的存放目录。该参数如果不配置,默认指向/tmp目录,/tmp目录在系统重启后会自动清空,从而导致Hadoop的文件系统数据丢失

修改配置文件hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property><!-- 不检查用户权限 -->

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/opt/modules/hadoop-2.8.2/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.name.dir</name>

<value>file:/opt/modules/hadoop-2.8.2/tmp/dfs/data</value>

</property>

</configuration>

dfs.replication:文件在HDFS系统中的副本数

dfs.namenode.name.dir:NameNode节点数据在本地文件系统的存放位置

dfs.datanode.name.dir:DataNode节点数据在本地文件系统的存放位置

修改slaves文件

centos01

centos02

centos03

配置YARN

重命名mapred-site.xml.template并添加内容

将其重命名为mapred-site.xml,添加以下内容:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

yarn-site.xml添加内容

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

yarn.nodemanager.aux-services:NodeManager上运行的附属服务,需配置成mapreduce_shuffle才可运行MapReduce程序。YARN提供了该配置项用于在NodeManager上扩展自定义服务,MapReduce的Shuffle功能正是一种扩展服务。

也可继续在yarn-site.xml文件中添加以下属性内容,指定ResourceManager所在的节点与访问端口(默认8032),此处指定ResourceManager运行在centos01节点:

<property>

<name>yarn.resourcemanager.address</name>

<value>centos01:8032</value>

</property>

复制Hadoop安装文件到其他主机

scp -r hadoop-2.8.2/ hadoop@centos02:/opt/modules

scp -r hadoop-2.8.2/ hadoop@centos03:/opt/modules

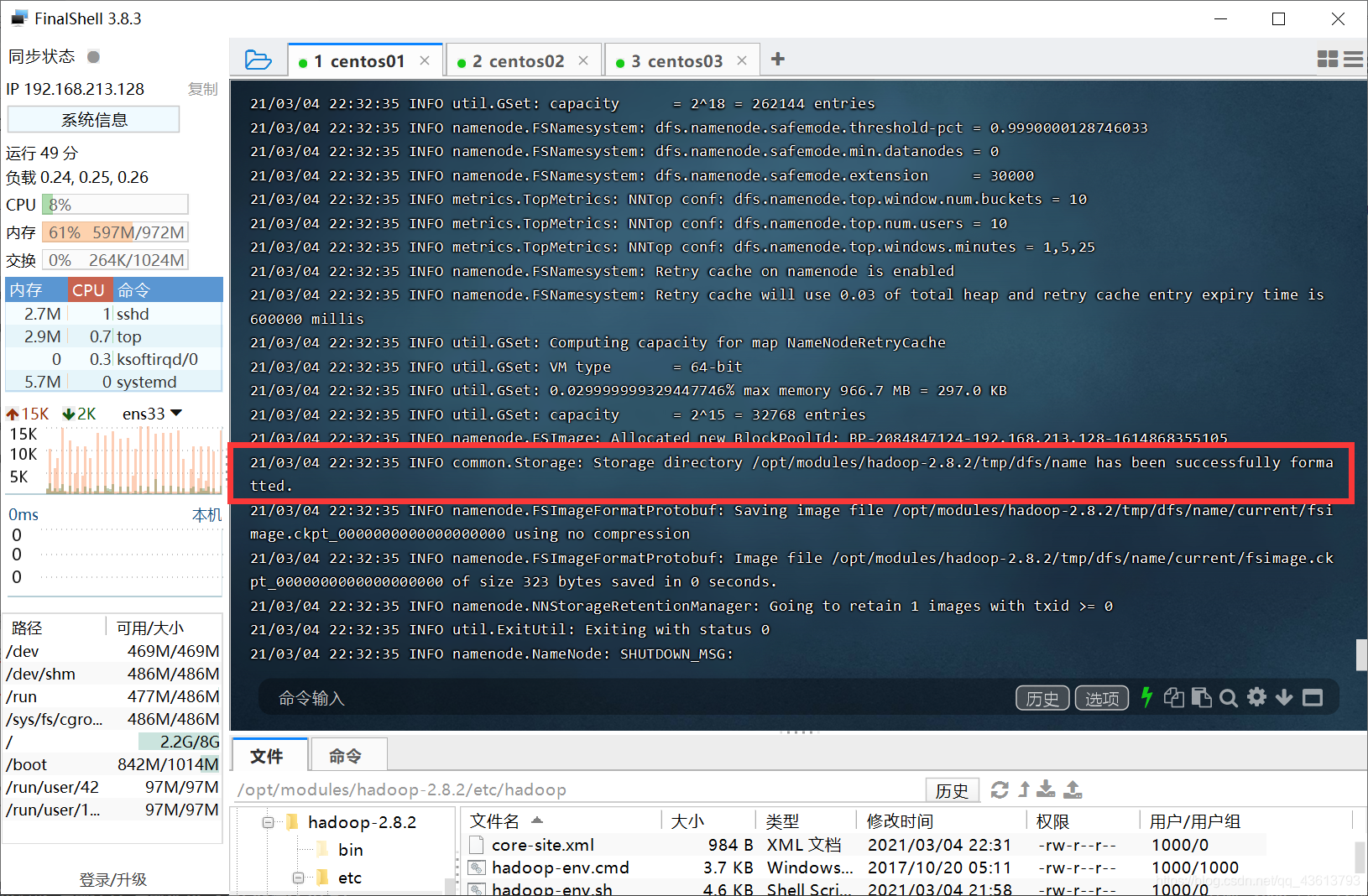

格式化NameNode

在centos01上:

hadoop namenode -format

若能找到以下内容,说明格式化成功:

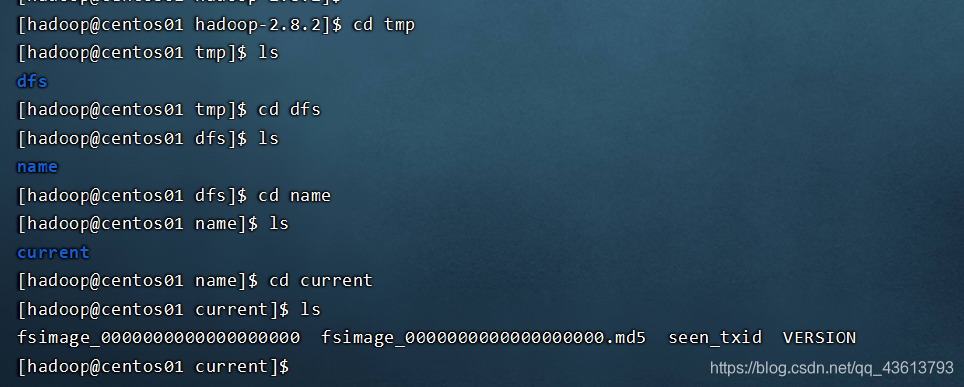

格式化成功后,会在当前节点的Hadoop安装目录中生成tmp/dfs/name/current目录,该目录中则生成了用于存储HDFS文件系统元数据信息的文件fsimage:

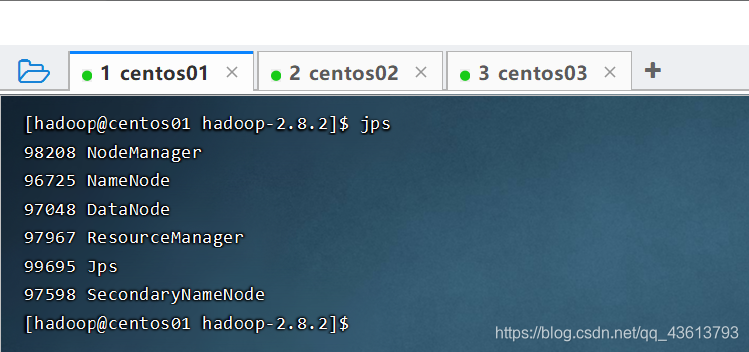

启动Hadoop

在centos01上:

start-all.sh

jps查看各节点启动进程

centos01:

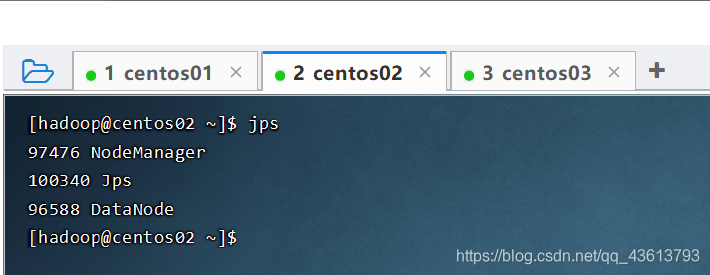

centos02:

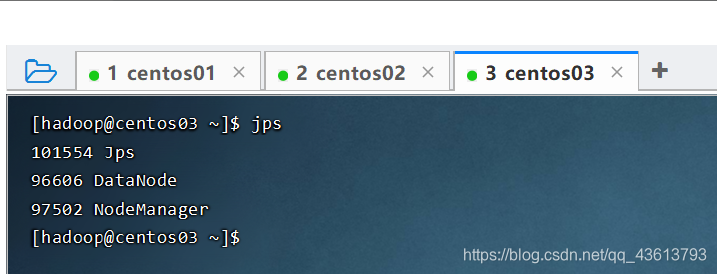

centos03:

测试HDFS

在centos01节点中执行以下命令,在HDFS根目录创建文件夹input,并将Hadoop安装目录下的文件README.txt上传到新建的input文件夹中:

hdfs dfs -mkdir /input

hdfs dfs -put /opt/modules/hadoop-2.8.2/README.txt /input

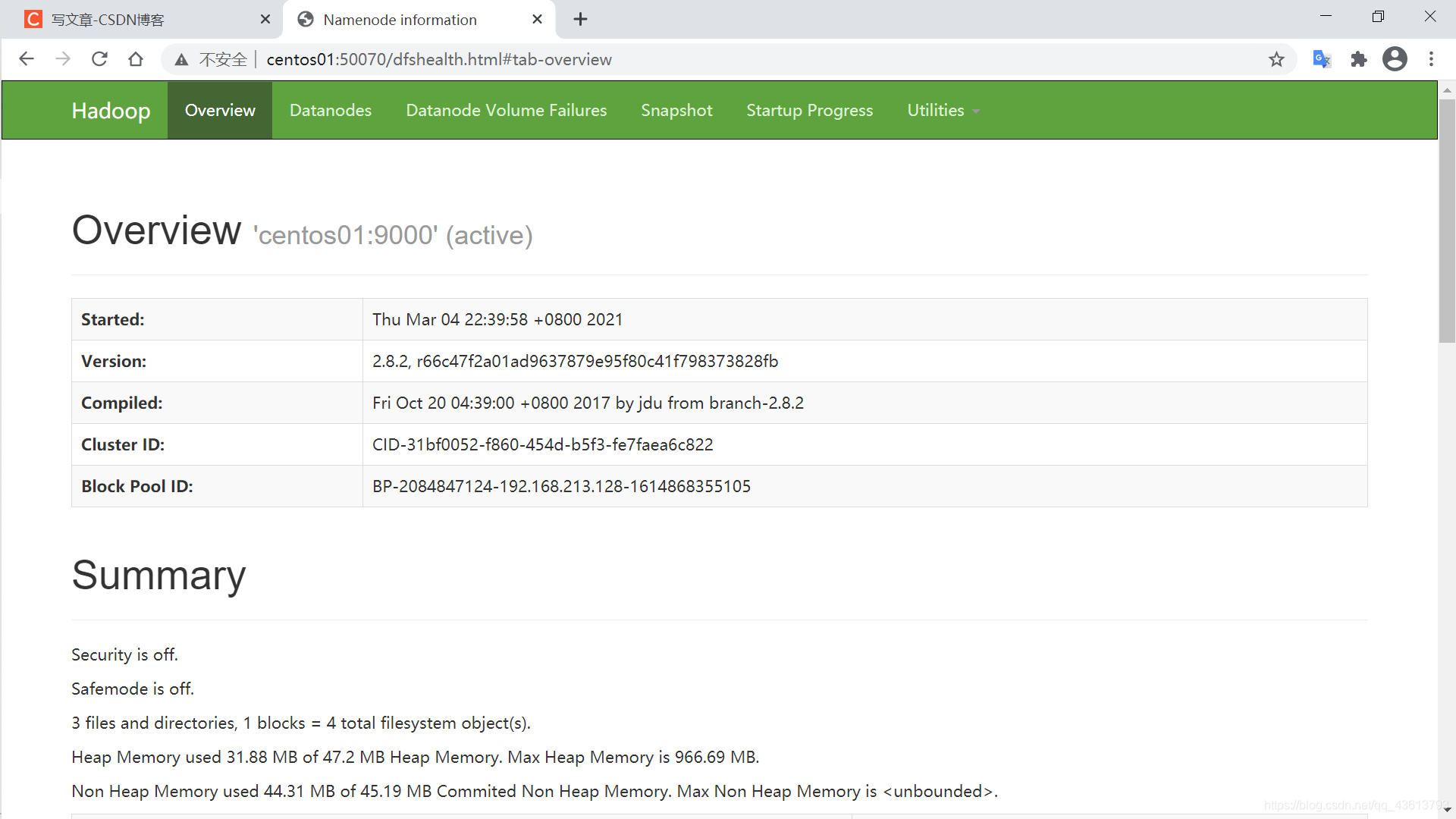

浏览器访问http://centos01:50070:

测试MapReduce

在centos01中执行以下命令,运行Hadoop自带的MapReduce单词计数程序,统计/input文件夹中所有文件的单词数量:

hadoop jar /opt/modules/hadoop-2.8.2/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.8.2.jar wordcount /input /output

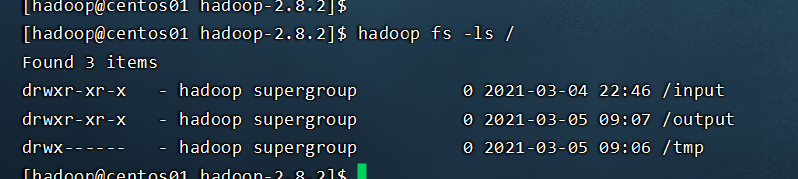

查看是否生成/output文件夹:

hadoop fs -ls /

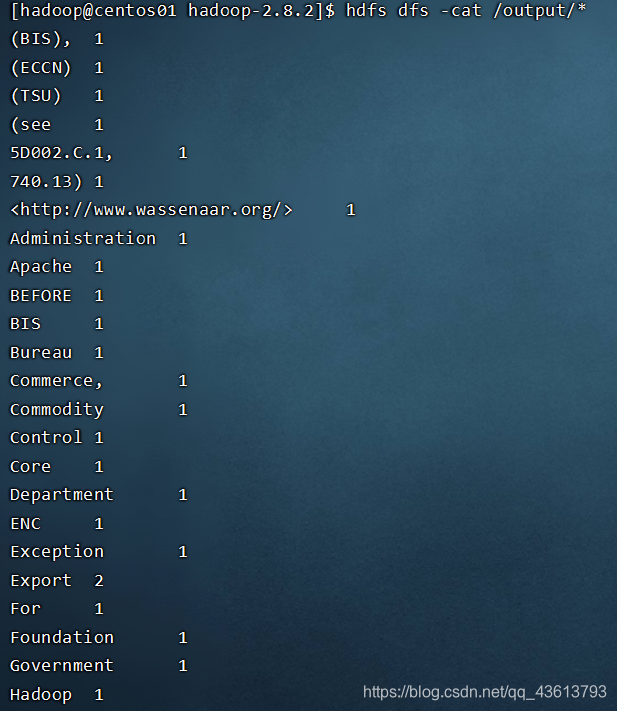

查看MapReduce执行结果:

hdfs dfs -cat /output/*

输出类似如下内容证明Hadoop集群搭建成功:

1933

1933

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?