1.上传压缩包(/usr/local):

hadoop-2.6.0-cdh5.7.0.tar.gz

jdk-8u144-linux-x64.tar.gz

spark-2.2.0-bin-2.6.0-cdh5.7.0.tgz

2.减压包:

更改spark的目录名

mv spark-2.2.0-bin-2.6.0-cdh5.7.0 spark

3.设置环境配置:

export SPARK_HOME=/usr/local/spark

export HADOP_HOME=/usr/local/hadoop-2.7.3

export JAVA_HOME=/usr/local/jdk1.8.0_171

export PATH=$PATH:$SPARK_HOME/bin:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

cd /etc/local/spark/conf/

mv spark-env.sh.template spark-env.sh

5.vim spark-env.sh

在最后加上:

export JAVA_HOME=/usr/local/jdk1.8.0_171

export HADOOP_HOME=/usr/local/hadoop-2.7.3

export HADOOP_CONF_DIR=/usr/local/hadoop-2.7.3/etc/hadoop

export SPARK_MASTER_IP=“master的IP”

export SPARK_WORKER_MEMORY=4g

export SPARK_WORKER_CORES=2

export SPARK_WORKER_INSTANCES=1

变量说明

- JAVA_HOME:Java安装目录

- SCALA_HOME:Scala安装目录

- HADOOP_HOME:hadoop安装目录

- HADOOP_CONF_DIR:hadoop集群的配置文件的目录

- SPARK_MASTER_IP:spark集群的Master节点的ip地址

- SPARK_WORKER_MEMORY:每个worker节点能够最大分配给exectors的内存大小

- SPARK_WORKER_CORES:每个worker节点所占有的CPU核数目

- SPARK_WORKER_INSTANCES:每台机器上开启的worker节点的数目

6.修改文件slaves

mv slaves.template slaves

vim slaves

在最后面加(去掉localhost):

slave1

slave2

7.把修改后的配置文件的发给其他两台:

cd conf

scp -r spark-env.sh worker1:$PWD

scp -r spark-env.sh worker2:$PWD

scp -r slaves slave1:$PWD

scp -r slaves slave2:$PWD

8.启动spark

cd /usr/local/spark/sbin

./start-all.sh

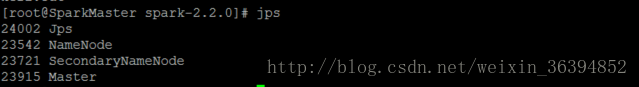

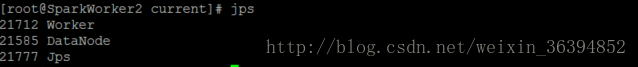

成功打开之后使用jps在SparkMaster、parkWorker1和SparkWorker2节点上分别可以看到新开启的Master和Worker进程。

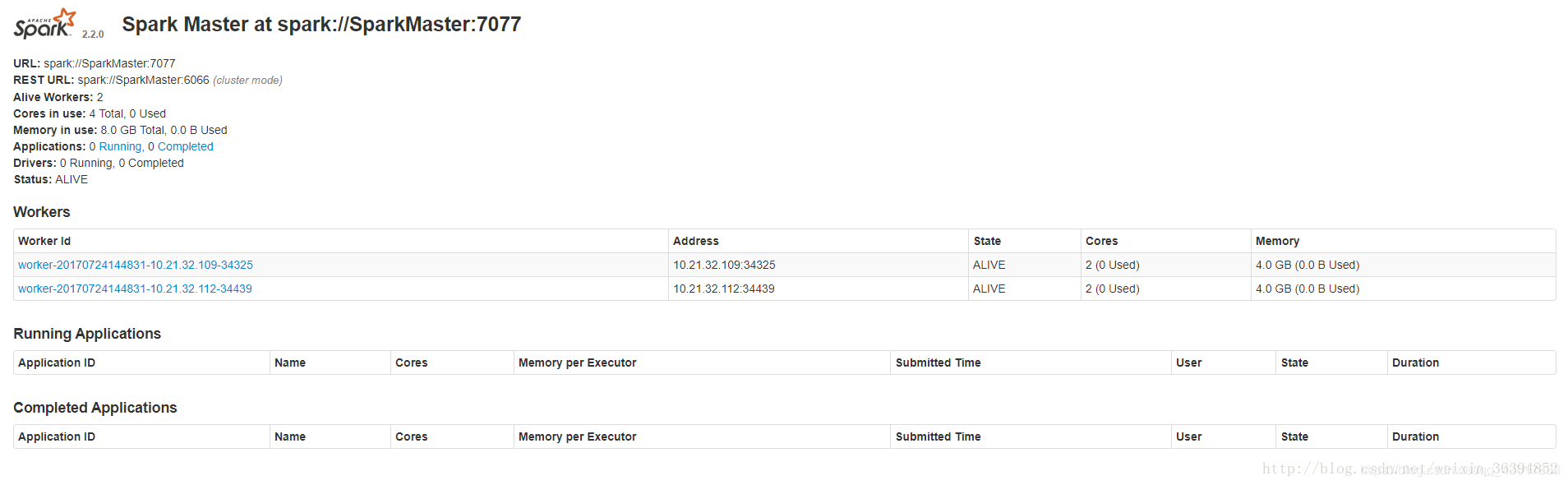

成功打开Spark集群之后可以进入Spark的WebUI界面,可以通过

192.168.88.60:8080

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?