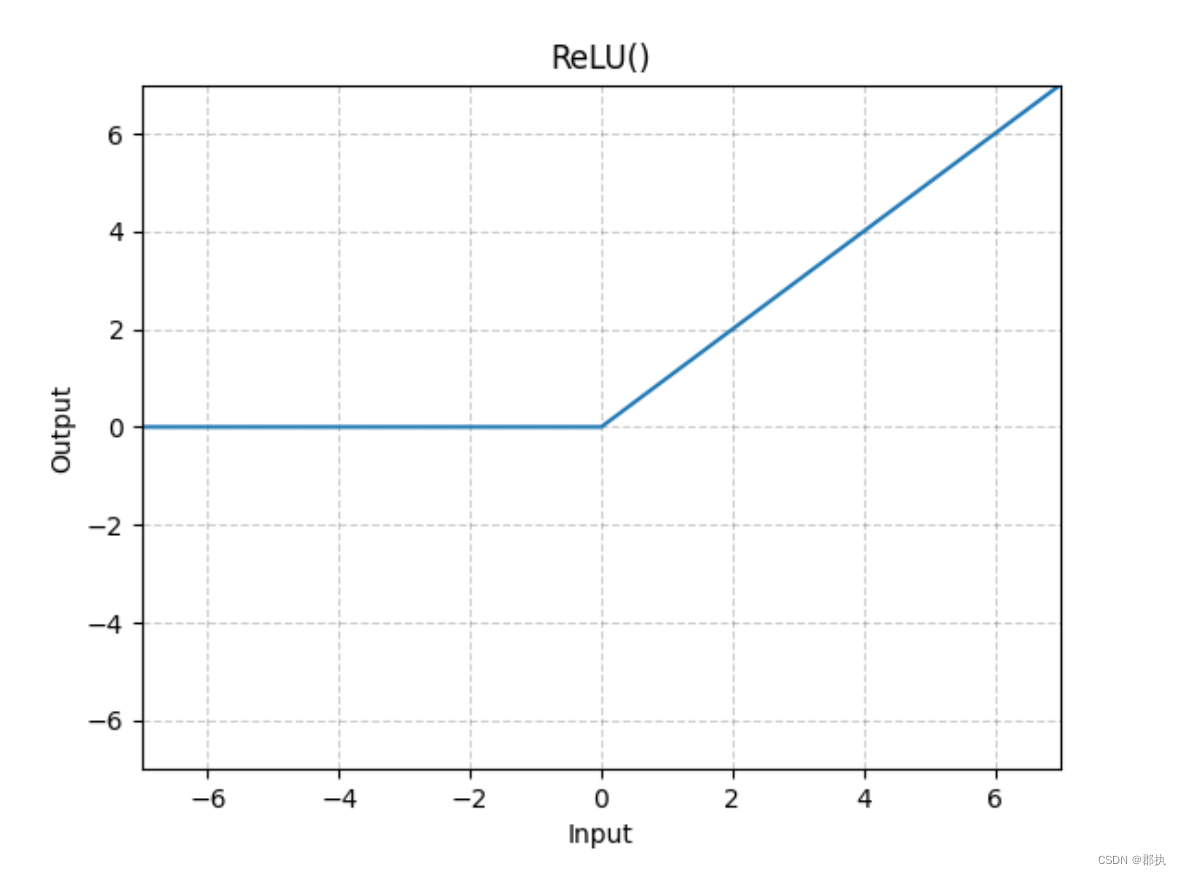

nn.ReLU的使用

import torch

import torchvision

from torch import nn

from torch.utils.data import DataLoader

"""

其主要为测试ReLu函数的使用,其主要功能就是将数值大于0的保留,数值小于零的变成0。

此处还是简单使用手动创造的张量进行演示。

并创建自己模型,模型只有一个功能就是经过Relu进行得到最后的结果。

验证图片数据进入后会发生什么变化。

"""

input = torch.tensor([[1, -0.5],

[-1, 3]])

class MyModule(nn.Module):

def __init__(self):

super().__init__()

self.Relu = nn.ReLU()

def forward(self, x):

output = self.Relu(x)

return output

myModule = MyModule()

output = myModule(input)

print(output)

结果:

tensor([[1., 0.],

[0., 3.]])

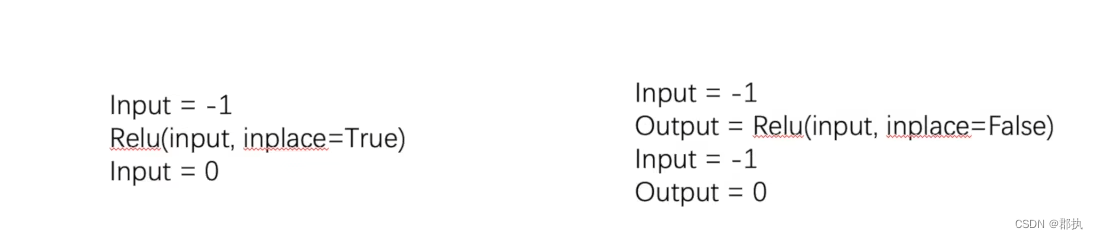

ReLU的主要参数解释为: inplace表示是否修改原值,Ture则无返回值,即修改input的值。

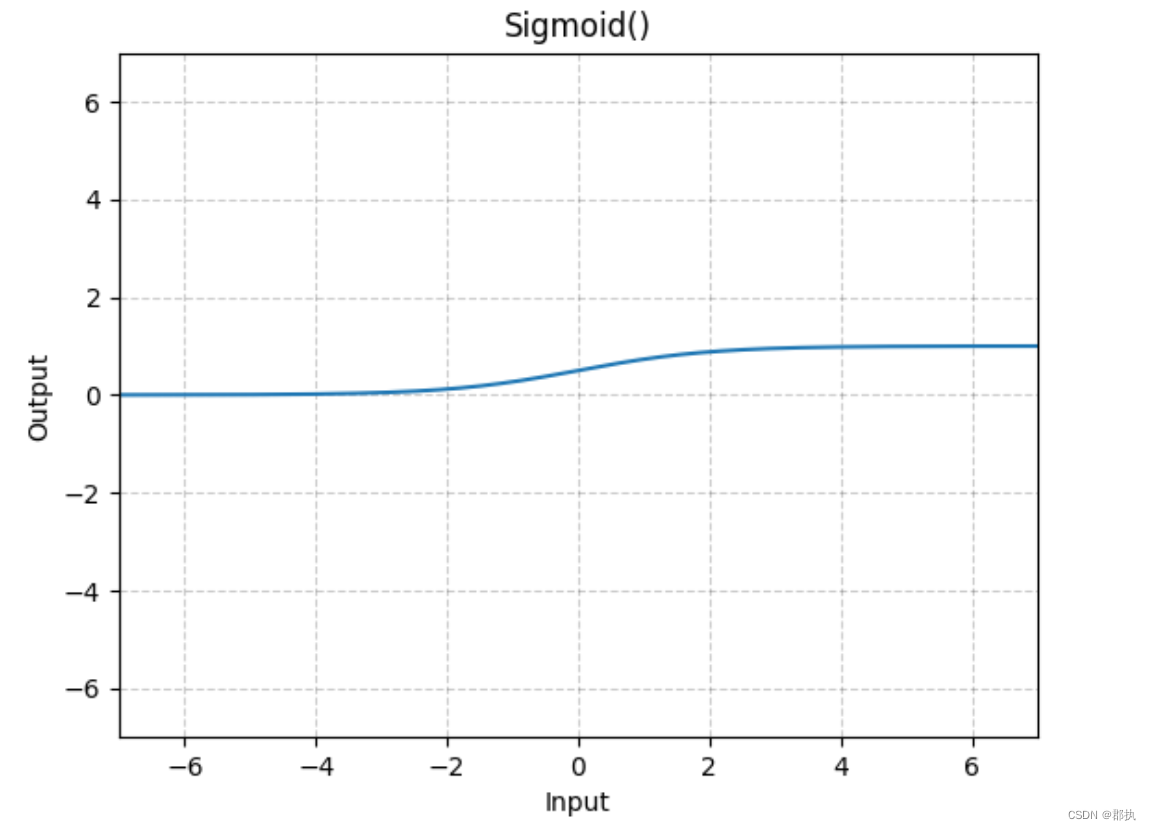

nn.Sigmoid函数

引入非线性激活函数目的:即给网络引入更多的非线性特征。提高训练精度。

import torch

import torchvision

from torch import nn

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

"""

其主要为测试ReLu函数的使用,其主要功能就是将数值大于0的保留,数值小于零的变成0。

此处还是简单使用手动创造的张量进行演示。

并创建自己模型,模型只有一个功能就是经过Relu进行得到最后的结果。

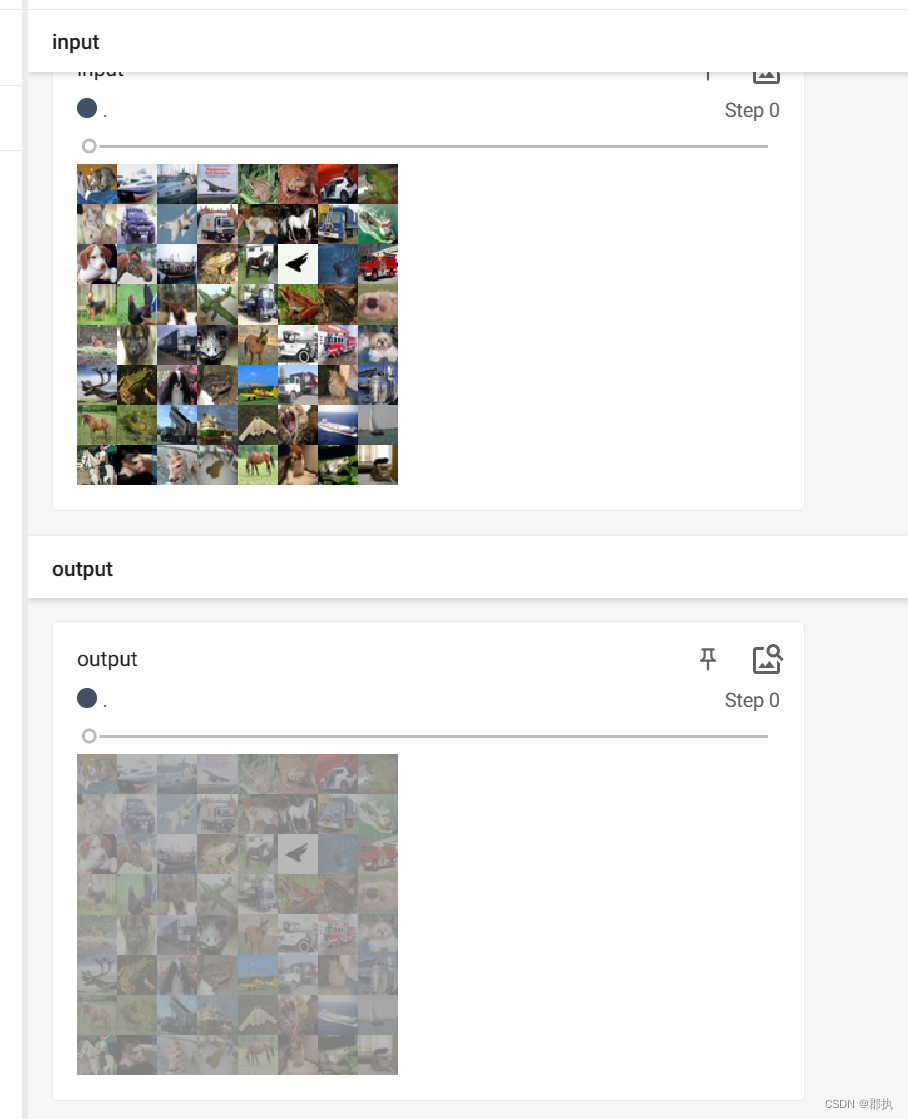

验证图片数据经过 Sigmoid进入后会发生什么变化。

"""

dataset = torchvision.datasets.CIFAR10("../DataSet/dataset", train=False, transform=torchvision.transforms.ToTensor(),

download=False)

dataloader = DataLoader(dataset, 64)

class MyModule(nn.Module):

def __init__(self):

super().__init__()

self.ReLu = nn.ReLU()

self.Sigmoid = nn.Sigmoid()

def forward(self, x):

output = self.Sigmoid(x)

return output

writer = SummaryWriter("Sigmoid")

myModule = MyModule()

for data in dataloader:

imgs, target = data

writer.add_images("input", imgs)

output = myModule(imgs)

writer.add_images("output", output)

break

writer.close()

实验结果:像是蒙上一层滤镜!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?