本地安装llama AI模型

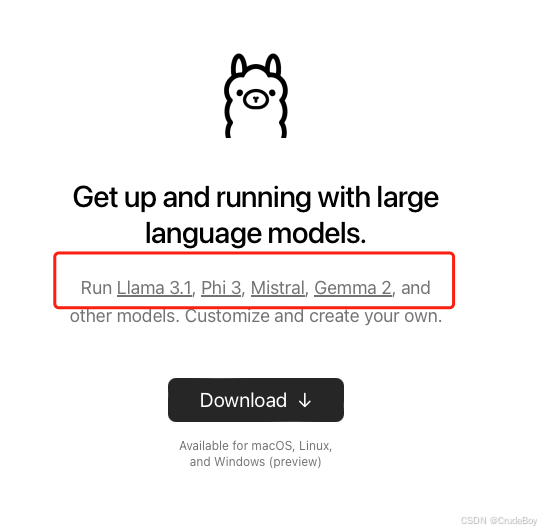

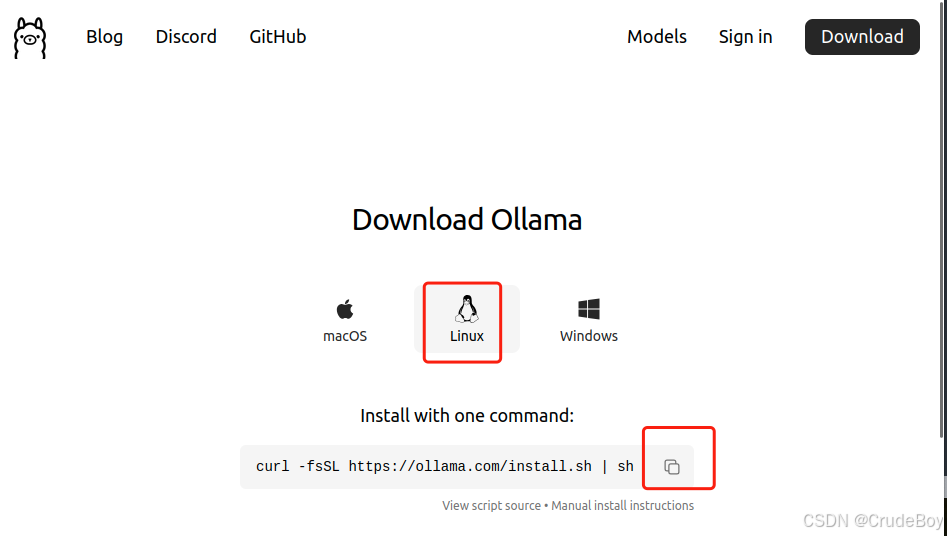

官网:https://ollama.com

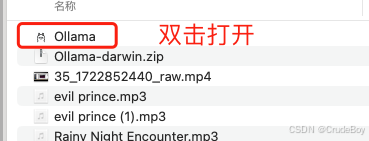

下载对应版本,这里是MAC:

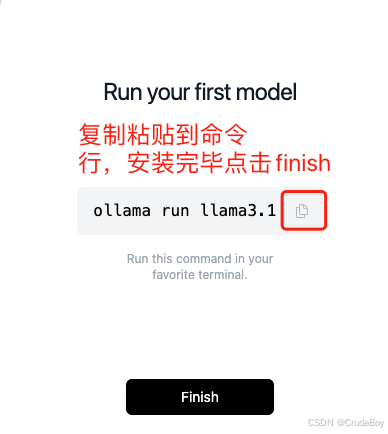

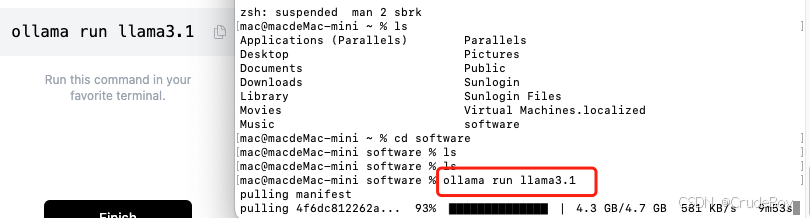

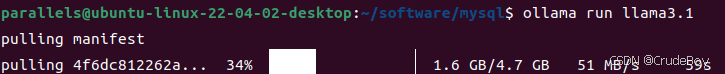

ollama run llama3.1

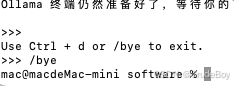

退出Ollama终端:

/bye

启动:

ollama run llama3.1

发现下面几种语言模型都可以安装:

![]()

ollama run gemma2

首字母大写改成小写即可,首次执行命令会自动安装然后运行。

ollama run phi3

ollama run mistral

以下是百度AI的介绍,对Mistral应该不是太了解:

Llama 3.1、Phi 3、Mistral、Gemma 2分别代表了不同领域或公司推出的技术产品或模型,以下是它们的详细介绍:

Llama 3.1

定义与特点:

- Llama 3.1是Meta AI(前身为Facebook AI Research)推出的最新一代大型语言模型。

- 它具有128K的上下文长度扩展,支持八种语言(包括英语、中文、法语、德语、日语、韩语、俄语和西班牙语),并首次开源了405B参数级别的前沿AI模型。

- Llama 3.1为开发者和技术研究者提供了强大的支持,无论是处理大量文本数据的编程助手,还是构建多语言对话系统的开发者,都能从中受益。

- 它支持长文本摘要和多语言对话代理,具有先进的工具使用和推理能力,以及模型蒸馏能力,允许在开源领域实现前所未有的技术扩展。

目标受众:

- 主要面向开发者和技术研究者,特别是那些寻求利用最前沿AI技术来推动自己项目和研究的专业人士。

定价策略:

- Llama 3.1是一款开源免费的语言模型,无需支付任何费用即可使用。

Phi 3

定义与特点:

- Phi 3是Microsoft开发的一系列开放式AI模型,属于小语言模型(SLM)范畴。

- 它在各种语言、推理、编码和数学基准测试中表现出色,为开发者构建生成式人工智能应用程序提供了更多实用的选择。

- Phi-3-mini有两种上下文长度变体,包括支持128K个令牌的上下文窗口的模型。

应用场景:

- 适用于需要高效且成本效益高的AI模型的应用场景。

Mistral

定义与说明:

- Mistral在此上下文中可能不是一个特定的技术产品或模型名称。它更可能是一个非技术性的词汇,如人名(如法国诗人Frederic Mistral)、地名或特定领域的术语(如“密史脱拉风”,指法国南部出现于冬季的寒冷强风)。

- 在当前的技术或AI领域,没有直接证据表明Mistral是一个被广泛认可的技术产品或模型。

Gemma 2

定义与特点:

- Gemma 2是谷歌在2024年推出的一系列轻量级、最先进的开放式模型。

- 它采用全新架构,提供27B(270亿)参数大小的尺寸,性能可与Llama 3 70B相媲美,但尺寸只有后者的一半。

- Gemma 2的设计旨在降低部署成本,其高效性使得所需的计算量少于同类模型的一半。

- 它支持在英伟达的GPU和Vertex AI中的单个TPU主机上高效运行,为开发人员提供了跨越不同平台和工具生态系统的强大调优功能。

综上所述,Llama 3.1、Phi 3和Gemma 2都是各自领域内具有显著特点和优势的技术产品或模型,而Mistral则可能是一个非技术性的词汇或术语。

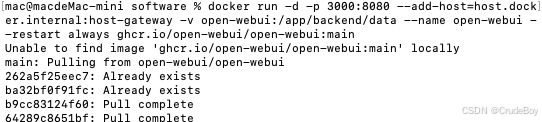

命令行看着不舒服的话补个UI界面,需安装docker:

终端执行:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

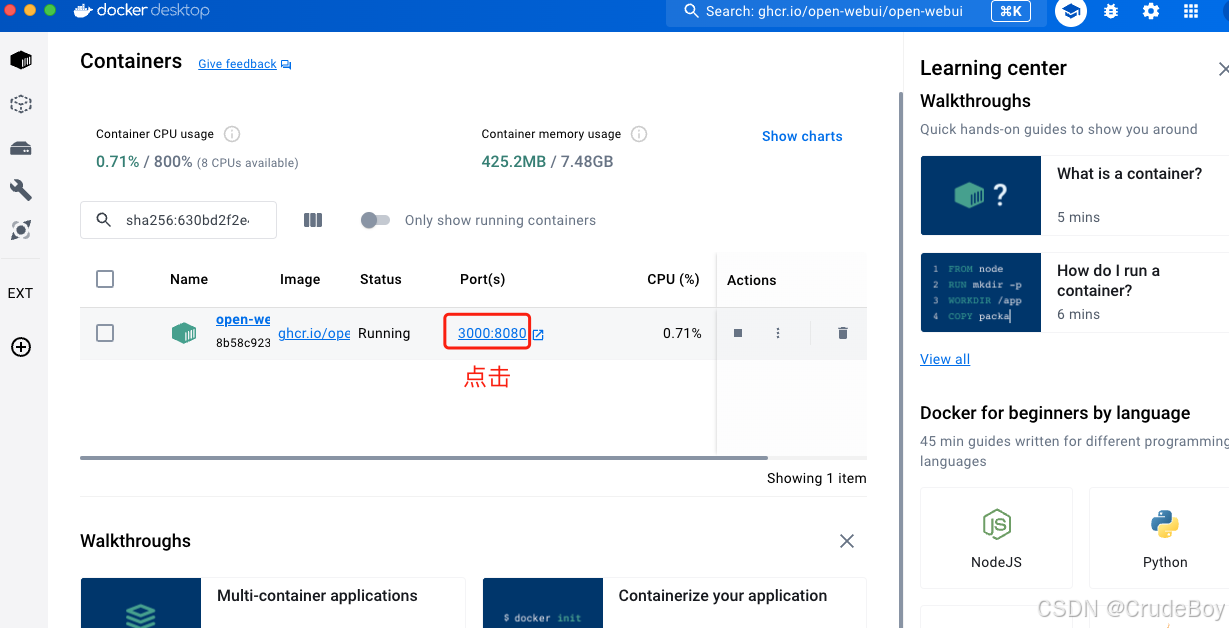

安装完成后页面输入:

或者docker中直接打开:

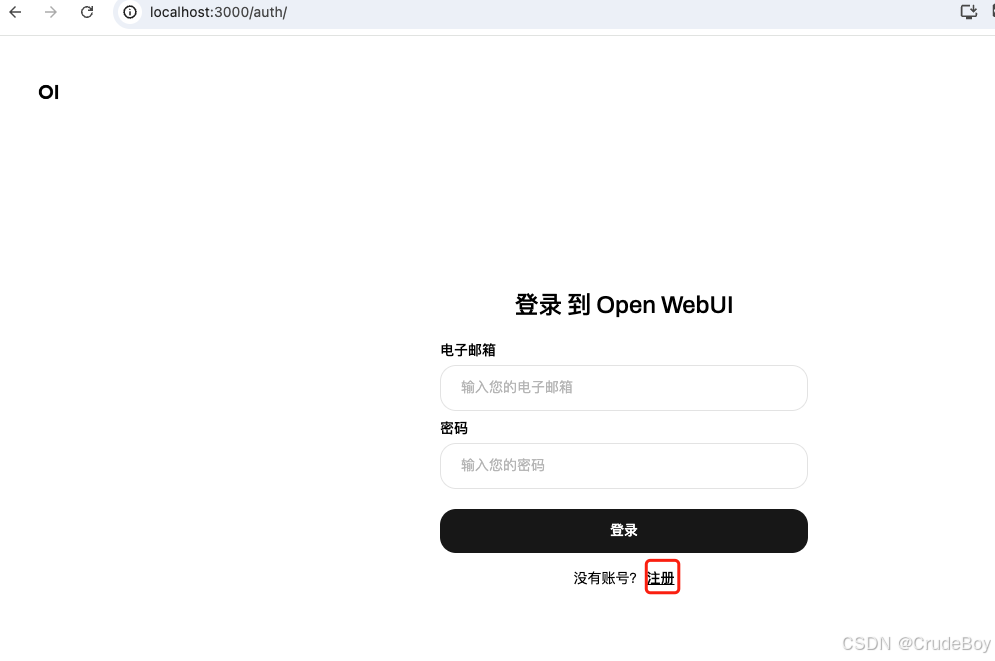

没有账号的注册一个即可:

---

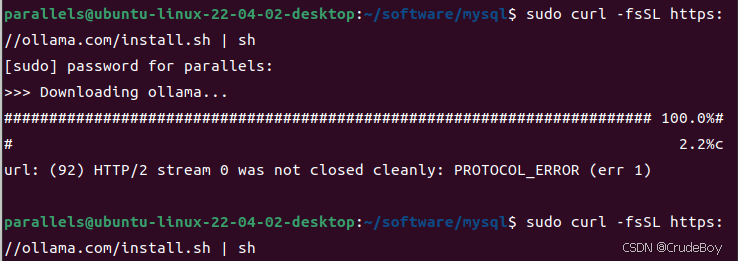

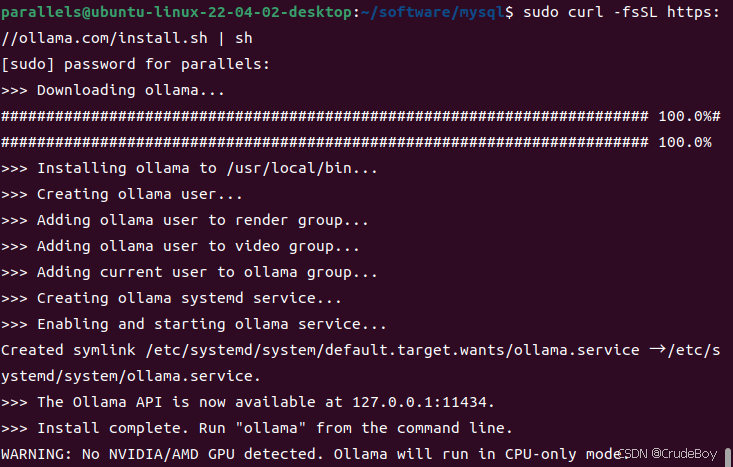

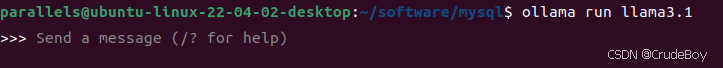

ubuntu:

可能需要多执行几次该脚本,我也是大晚上才成功的。

sudo curl -fsSL https://ollama.com/install.sh | sh

ollama run llama3.1

运行时内存至少5.6G。

我给了8个G的内存,但是生成答案时的速度真的很慢。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?